你是不是也被这种"AI智商税"折腾过?

花了半个月搭建AI测试助手,喂了几千条历史用例,结果AI生成的测试用例要么是去年的旧需求,要么就是完全不存在的功能。你怀疑人生:明明训练了这么多数据,为什么AI还是一问三不知?

或者,你尝试了RAG(检索增强生成),把所有文档塞进向量数据库,结果AI回答问题时,要么检索不到相关内容,要么检索到一堆八竿子打不着的历史文档,最后拼出来的答案驴唇不对马嘴。

这就是AI测试知识库构建中最让人纠结的选择题:RAG还是微调?

一个是"开卷考试",一个是"强化训练"。选错了,就是花钱买教训;选对了,AI秒变测试专家。

如果你也在这两条路线间摇摆不定,这篇文章就是你的"决策指南"。

🎯 本期重点:RAG vs 微调深度对比 + 测试场景最佳实践 + 混合方案终极解法 + 1分钟选型清单

一、真实翻车案例:选错路线的代价

案例背景:某互联网公司测试团队,想用AI自动生成接口测试用例。

方案A(纯微调路线):

数据准备:2000条历史测试用例 + 需求文档配对

训练成本:3万元GPU算力(示意成本)+ 2周工程师时间

预期效果:生成贴合公司业务的专业测试用例实际结果:AI确实学会了公司的测试用例格式,但是…

-

• 生成的用例都是半年前的旧接口,新功能一问三不知 -

• 想要更新知识,必须重新收集数据、重新训练,成本高到离谱 -

• 模型变成了"历史文物管理员",而不是"当前业务专家"

方案B(纯RAG路线):

数据准备:所有需求文档 + API文档向量化

部署成本:向量数据库 + 检索服务

预期效果:实时获取最新业务信息,回答任何问题实际结果:信息是最新的,但AI的回答质量…

-

• 检索到的文档片段语义不连贯,AI拼接出来的用例逻辑混乱 -

• 同一个问题,今天检索到A文档,明天检索到B文档,答案完全不一致 -

• AI不懂公司的测试规范,生成的用例格式五花八门

结论:单纯走一条路线,都有明显短板。

二、RAG:给AI的"开卷考试"

工作原理

RAG的核心思想很简单:不改变AI的"大脑",而是给它一个"外部记忆"。

# RAG流程伪代码

def rag_generate(query):

# 1. 向量检索相关文档

relevant_docs = vector_search(query, top_k=5)

# 2. 构建带上下文的提示词

context = "n".join(relevant_docs)

prompt = f"""

参考以下文档内容:

{context}

用户问题:{query}

请基于上述文档生成测试用例。

"""

# 3. 调用大模型生成

return llm.generate(prompt)优势与痛点

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

测试场景适用性

最适合RAG的场景:

-

• 需求文档解读:快速检索相关需求,生成测试要点 -

• API测试用例生成:基于Swagger文档自动生成接口测试 -

• 缺陷知识问答:检索历史bug信息,辅助定位问题

三、微调:对AI的"强化训练"

工作原理

微调是直接改造AI的"神经网络",让它从根本上学会你的业务逻辑。

# 微调流程伪代码

def fine_tune_model():

# 1. 准备训练数据

training_data = [

{"input": "登录接口需求", "output": "标准测试用例格式"},

{"input": "支付流程需求", "output": "标准测试用例格式"},

# ... 1000+条数据

]

# 2. 模型训练

model = load_base_model("可微调的开源/商用模型(如 Llama 3、Qwen2.5、Mistral 或供应商提供的可微调版本)")

fine_tuned_model = model.fine_tune(

data=training_data,

epochs=3,

learning_rate=1e-5

)

return fine_tuned_model优势与痛点

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

测试场景适用性

最适合微调的场景:

-

• 测试报告生成:学习公司特定的报告模板和风格 -

• 用例标准化:统一测试用例的格式和表达方式 -

• 特定领域测试:金融、医疗等有严格规范的行业

总结:

-

• RAG:效果强依赖文档颗粒度与切片策略(chunking)、检索器(BM25/向量/混合)和重排序; -

• 微调:微调适合固化风格与流程,不适合频繁变更的事实类知识。

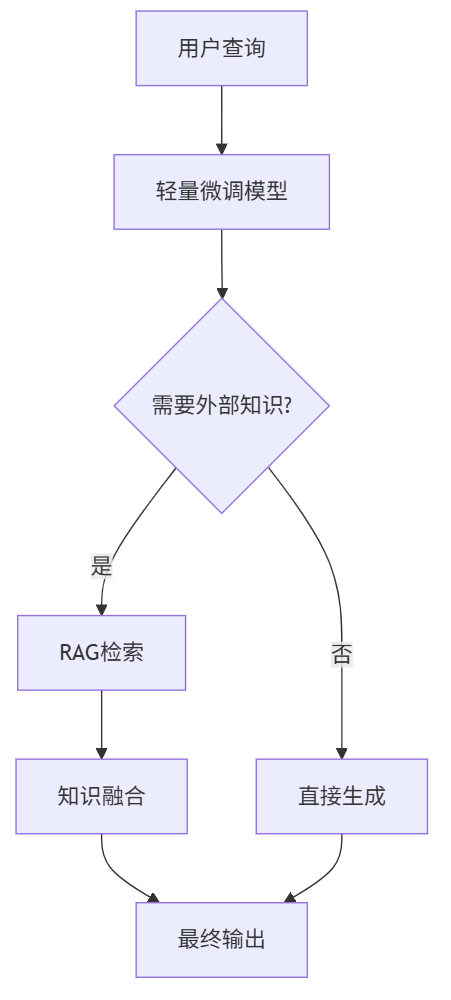

四、2025年的终极答案:RAG + 微调混合架构

经过一年的实践,业界已经达成共识:成年人不做选择题,RAG和微调我全都要。

黄金组合架构

核心思想:

-

• 微调负责"怎么说":学会公司的表达风格、格式规范、专业术语 -

• RAG负责"说什么":提供最新的业务信息、需求变更、接口定义

实际落地方案

Step 1:轻量化微调(教会AI"怎么说")

# 训练数据示例

training_examples = [

{

"input": "为XX接口生成测试用例",

"output": """

## 测试用例

**用例ID**: TC_001

**测试目标**: 验证XX接口正常流程

**前置条件**: 用户已登录

**测试步骤**:

1. 发送正确参数到接口

2. 验证返回状态码为200

**预期结果**: 返回正确的业务数据

"""

}

# 只需100-200条高质量示例即可

]Step 2:RAG检索增强(告诉AI"说什么")

def hybrid_generate(query):

# 1. RAG检索最新业务信息

latest_docs = rag_search(query)

# 2. 用微调模型生成,注入检索内容

prompt = f"""

最新业务信息:{latest_docs}

请基于以上信息,用标准格式生成测试用例:{query}

"""

return fine_tuned_model.generate(prompt)测试团队的黄金实践

-

1. 用微调规范输出格式

-

• 训练数据:公司测试用例模板 × 100条 -

• 目标:AI学会标准的测试用例写法

-

2. 用RAG注入最新业务 -

• 向量库:需求文档、API文档、配置文件 -

• 实时更新:文档变更自动重新索引 -

3. 按场景选择策略 -

• 标准化任务(报告、格式)→ 微调为主 -

• 知识问答任务(需求解读)→ RAG为主 -

• 创新任务(测试设计)→ 混合增强 -

• 业务需求变化频繁,文档经常更新 -

• 团队技术实力有限,缺乏模型训练经验 -

• 预算相对紧张,希望快速看到效果 -

• 主要任务是知识问答和信息检索 -

• 有稳定的业务规范,格式要求严格 -

• 拥有大量高质量的历史训练数据 -

• 团队有AI工程师,具备模型训练能力 -

• 主要任务是内容生成和格式标准化 -

• 既要最新信息,又要规范格式 -

• 团队有充足预算和技术实力 -

• 希望构建企业级AI测试平台 -

• 追求最佳效果,不在乎复杂度

安全与合规提示:注意对向量库做权限与数据分区,避免跨项目泄露。

五、1分钟选型清单:你该选哪条路?

对照以下清单,快速找到最适合你的方案:

优先选择RAG,如果你:

优先选择微调,如果你:

选择混合方案,如果你:

六、避坑指南:3个常见误区

误区1:以为RAG能解决所有问题

现实:RAG 是检索+生成的框架,本质是用外部知识约束生成,不能替代AI的理解和生成能力。

正解:RAG + 强大的基础模型 + 合理的prompt设计。

误区2:认为微调一定比RAG好

现实:微调的ROI(投资回报率)很难算清楚,失败率也不低。

正解:先用RAG验证可行性,再考虑微调优化。

误区3:混合方案一定最优

现实:复杂度会带来维护成本,小团队可能玩不转。

正解:根据团队实际情况,先从简单方案开始。

结语

RAG和微调的路线之争,本质上是关于如何让AI更好地服务测试业务。2025年的最佳答案已经清晰:根据具体场景选择合适的技术组合,而不是盲目追求最新最复杂的方案。

对于大多数测试团队而言,最务实的路径是:从RAG开始,解决知识获取问题;当RAG遇到瓶颈时,通过轻量化微调解决格式和风格问题。

记住:技术是手段,业务价值才是目标。选择能让你的测试团队更高效、更专业的那条路,就是最好的路。