点击下方“AINLPer“,添加关注

更多精彩内容->专注大模型、Agent、RAG等前沿分享!

引言

当前RAG技术应用非常广泛,但是由于涉及技术节点比较多,问题排查通用非常困难。为此,本文作者对RAG系统出现的错误进行了深入的分析,「引入充分上下文(Sufficient Context)的概念,指出RAG系统中的幻觉现象可能是由于上下文不足引起」,为此提出了选择性生成框架来提高RAG系统的准确性,实验结果表明该方法可让RAG系统准确率最高提升10%。 链接:https://arxiv.org/pdf/2411.06037

链接:https://arxiv.org/pdf/2411.06037

背景介绍

检索增强生成(Retrieval-Augmented Generation,RAG)是当前NLP领域中最重要的技术突破之一。它将大语言模型(LLMs)与动态信息检索机制相结合,有效解决了传统语言模型的三大核心问题:知识固化问题、事实性幻觉倾向,以及长尾知识覆盖不足的缺陷。这种方法在开源和商用应用中都非常广泛,如搜索问答、智能客服、医疗辅助诊断等。

尽管 RAG 在许多任务中表现优异,但仍经常出现“幻觉”(hallucination)现象,即模型在提供不完整或无关文档时依然自信地生成错误答案。此时你可能会想到:「这些错误究竟是因为检索系统未能提供足够信息,还是模型本身未能正确使用上下文?」

为了分析和解决这个问题,Google提出了“「充分上下文(Sufficient Context)」”的概念,并围绕这一概念展开了深入研究,旨在明确划分 RAG 系统错误的责任归属,并给出了几种提升RAG生成质量的策略。

上下文充分性评估工具

何为充分上下文(Sufficient Context)?作者给出的定义是:检索的内容中是否「能够具备支持正确答案的全部信息」。这一标准并不要求上下文中显式的包含答案,但应当使一个熟悉该任务的 LLM 能够基于其常识和推理能力,合理得出正确答案。

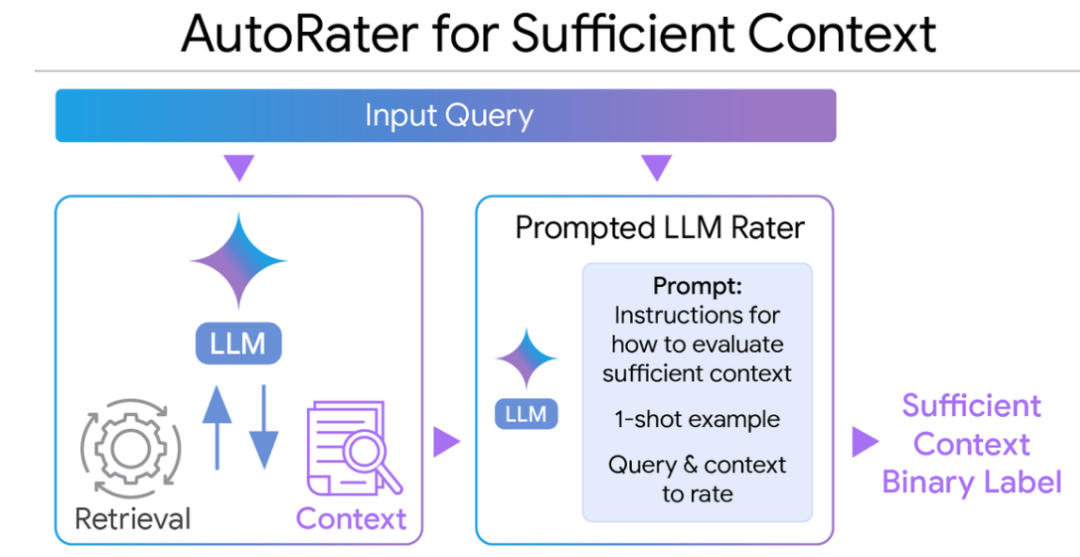

为了量化这个概念,作者构建了一个新的评估任务:「给定问题、答案与上下文,判定该上下文是否足够支持该答案」。简单来说:如果上下文包含所有必要信息,能够让大模型生成正确答案,则将其定义为“充分”;如果上下文缺乏必要信息、不完整、不确定或包含相互矛盾的信息,则定义为“不充分”。 基于以上定义,作者首先开发了一个基于大模型的 上下文充足评估器(这里大模型主要采用Gemini 1.5 Pro,通过构建提示词来实现),用于自动判断上下文是否充分。如果上下文充足,它会输出“真”,如果上下文不足,它会输出“假”。实验结果表明上下文充足评估器,1-shot 在评估上下文充分性方面达到高达 93% 的准确率。

基于以上定义,作者首先开发了一个基于大模型的 上下文充足评估器(这里大模型主要采用Gemini 1.5 Pro,通过构建提示词来实现),用于自动判断上下文是否充分。如果上下文充足,它会输出“真”,如果上下文不足,它会输出“假”。实验结果表明上下文充足评估器,1-shot 在评估上下文充分性方面达到高达 93% 的准确率。

RAG错误溯源分析

本文作者利用上下文充分性评估工具,分析了各种大型语言模型(LLMs)和数据集的性能,得出了以下几项关键发现:

-

最先进的大型模型(如Gemini、GPT和Claude)在提供足够上下文时通常能够出色地回答问题,但在上下文不足时无法识别并避免生成错误答案。

-

小型开源模型存在特定问题,即使在上下文足以正确回答问题的情况下,它们也容易出现幻觉。

-

有时即使上下文被评定为不足,模型仍能生成正确答案,这表明不足的上下文仍可能有用,例如它可以填补模型知识的空白或澄清查询中的歧义。

基于以上发现本文作者提出了改善RAG系统的建议,即「1)在生成之前增加一个充分性检查;2)检索更多上下文或重新排序检索到的上下文;3)根据置信度和上下文信号调整弃权阈值」。

评测基准的上下文充分性

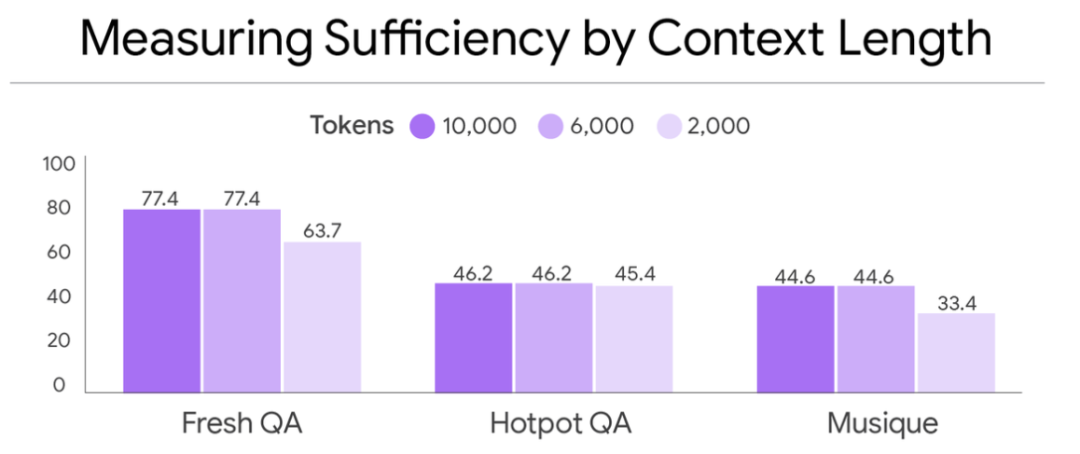

本文作者深入研究了充分上下文背后的相关情况。分析发现,多个标准基准数据集中存在大量上下文不足的案例。本文作者考虑了三个数据集:FreshQA、HotPotQA和MuSiQue。「那些上下文充足实例占比更高的数据集」,如FreshQA,往往是上下文来源于人工整理的支持性文档。

上下文导致幻觉

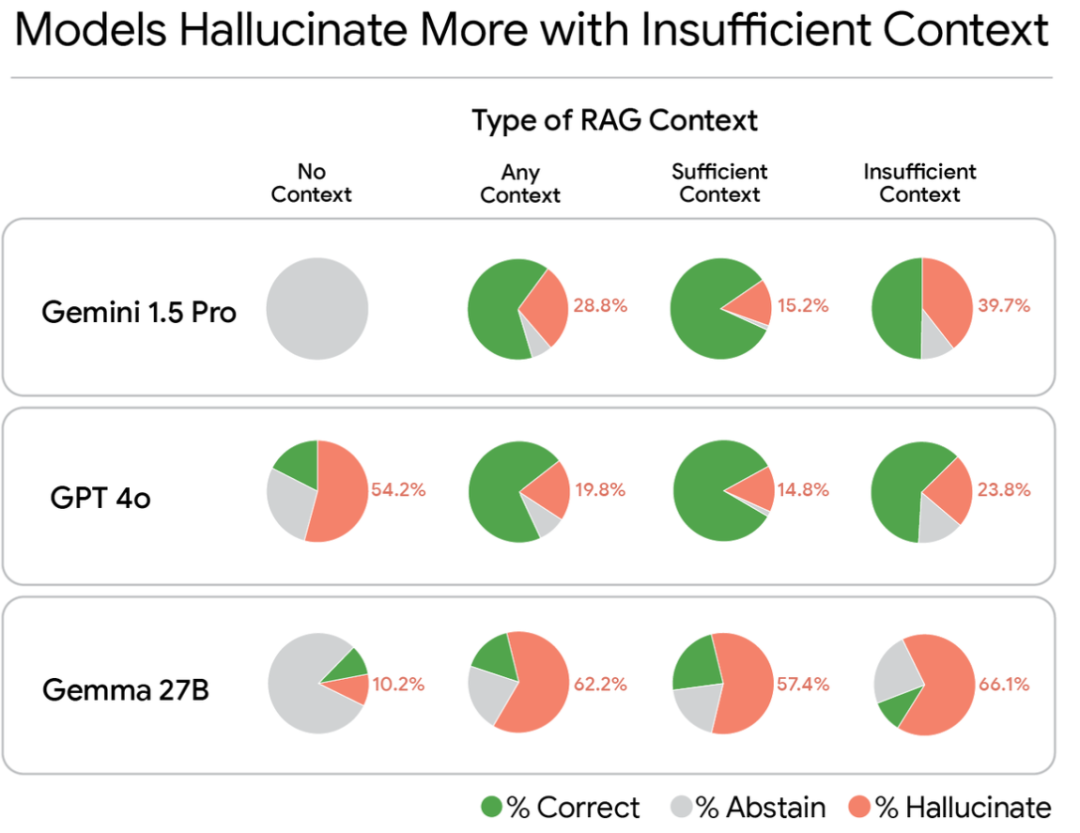

令人惊讶的是,尽管检索增强生成(RAG)通常能够提升整体性能,但它却降低了模型在合适时机选择不回答问题的能力。「引入额外上下文似乎会增加模型的自信,从而导致其更倾向于产生幻觉」。 为了理解这一点,本文作者利用Gemini来对每个模型的回答进行评级,将其与可能的真实答案进行比较。本文作者将每个回答分类为“正确”“幻觉”(即错误答案)或“弃权”(例如说“我不知道”)。通过这种方法,本文作者发现,例如,Gemma在没有上下文的情况下对10.2%的问题给出错误答案,而在使用不足上下文时,这一比例上升到了66.1%。

为了理解这一点,本文作者利用Gemini来对每个模型的回答进行评级,将其与可能的真实答案进行比较。本文作者将每个回答分类为“正确”“幻觉”(即错误答案)或“弃权”(例如说“我不知道”)。通过这种方法,本文作者发现,例如,Gemma在没有上下文的情况下对10.2%的问题给出错误答案,而在使用不足上下文时,这一比例上升到了66.1%。

选择性生成框架

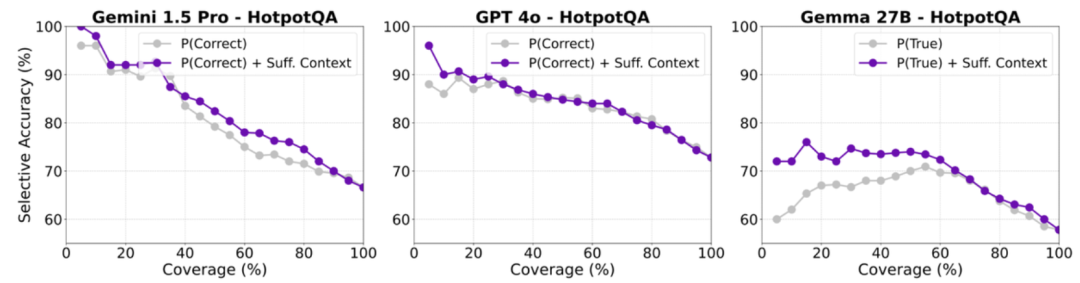

基于以上分析,本文作者提出了一种“选择性生成”框架,即利用充分上下文信息来指导弃权。作者考虑了以下指标:1)「选择性准确率」衡量模型在其回答的问题中正确答案的比例;2)「覆盖率」为回答问题的比例。

本文作者的选择性生成方法「将充分上下文信号与模型的自评置信度分数结合起来,以便就何时弃权做出明智的决策」。这比单纯在上下文不足时就弃权要更加精细,因为即使上下文有限,模型有时也能给出正确答案。本文作者利用这些信号来训练一个逻辑回归模型以预测幻觉。然后,本文作者设定一个覆盖率 – 准确率权衡阈值,确定模型何时应该放弃回答。

本文作者使用两种主要信号来决定是否弃权:

「自评置信度」 采用了两种策略:P(True)和P(Correct)。P(True)涉及多次采样答案,并提示模型将每个样本标记为正确或错误。P(Correct)用于那些大量查询成本高昂的模型,它涉及获取模型的回答及其对正确性的估计概率。

「充分上下文信号」 使用自评工具模型(FLAMe)的二元标签来指示上下文是否充分。至关重要的是,本文作者无需真实答案就能确定充分上下文标签,因此可以在回答问题时使用这一信号。 本文作者的研究结果表明,与仅使用模型置信度相比,这种方法能够实现更好的选择性准确率 – 覆盖率权衡。通过使用充分上下文标签,本文作者可以在模型回答的问题上提高准确率,有时甚至可以提高多达10%。

本文作者的研究结果表明,与仅使用模型置信度相比,这种方法能够实现更好的选择性准确率 – 覆盖率权衡。通过使用充分上下文标签,本文作者可以在模型回答的问题上提高准确率,有时甚至可以提高多达10%。

更多精彩内容–>专注大模型/AIGC、Agent、RAG等学术前沿分享!

推荐阅读

[1]Transformer|前馈神经网络(FFN)

[2]DeepSeek MLA,大量图解,非常详细!” data-itemshowtype=”0″ linktype=”text” data-linktype=”2″>Transformer|从MHA到DeepSeek MLA!

[3]Transformer|注意力机制Attention

[4]Transformer|MoE架构(含DeepSeek)

[5]Transformer|归一化(Normalization)

[6]Transformer|位置编码(DeepSeek位置编码)

欢迎投稿或寻求报道,联系:ainlperbot