导语:

数字人技术迎来重大突破!阿里通义实验室最新推出的OmniTalker,是全球首个端到端的文本驱动说话人视频生成系统。仅需单段参考视频,即可实现中英文零样本风格复刻,支持愤怒、快乐等6种情感表达,25帧/秒的实时生成速度重新定义人机交互体验。本文将深度解析其双分支Diffusion Transformer架构,并展示如何用一句话生成演讲视频!

正文:

1. 技术颠覆性突破

-

• 音视频同步引擎: # 音频-视觉融合模块伪代码

class AudioVisualFusion(nn.Module):

def forward(self, audio_feat, visual_feat):

cross_attn = AudioVisualAttention(audio_feat, visual_feat) # 跨模态注意力

return audio_feat + cross_attn, visual_feat + cross_attn -

• 唇形同步准确率98.2%(传统方案仅85%) -

• 延迟<40ms的实时交互能力 -

• 零样本风格迁移: 参考视频属性 可复刻要素 示例效果 雷军演讲 湖北口音+标志性手势 生成英文内容保持原演讲风格 新闻主播 标准播音腔+职业化表情管理 自动适配愤怒/悲伤等情感

2. 性能碾压级表现

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

3. 五分钟极速体验

-

1. 环境准备: # 安装基础依赖

pip install omnitalker-torch==2.5.0 -

2. 单句生成: from omnitalker import Generator

gen = Generator(ref_video="lei_jun.mp4")

output = gen.generate(

text="小米14销量突破100万台",

emotion="happy",

language="en" # 支持中英文互转

)

output.save("result.mp4") -

3. 长视频生成: # 分段处理避免内存溢出

for paragraph in long_text.split("n"):

gen.stream(paragraph, buffer_size=60) # 60秒缓冲区

4. 企业级应用场景

-

• 跨境电商直播: -

• 同一主播实时生成中/英/日多语种讲解 -

• 根据评论情绪自动调整表情(好评微笑/差评关切) -

• 在线教育: -

• 历史人物多语言复活(孔子讲《论语》英文版) -

• 情感化课件生成(化学实验危险警告表情) -

• 心理治疗: -

• 多情感AI心理咨询师 -

• 抑郁症患者情绪镜像疗法

5. 深度定制指南

-

• 风格强化训练: # config/train.yaml

style_enhance:

audio:

prosody_weight: 0.9 # 增强语调特征

visual:

micro_expression: [blink_rate=0.3, smile_asymmetry=0.2] # 个性化微表情 -

• 法律合规设置: gen.set_watermark(

text="AI生成内容",

position="bottom_right",

opacity=0.5

)

伦理警示:

⚠️ 使用限制:

-

• 禁止政治人物声音克隆(内置100+名人声纹黑名单) -

• 金融建议内容强制添加风险提示 -

• 情感生成模块禁用极端情绪表达

架构解密:

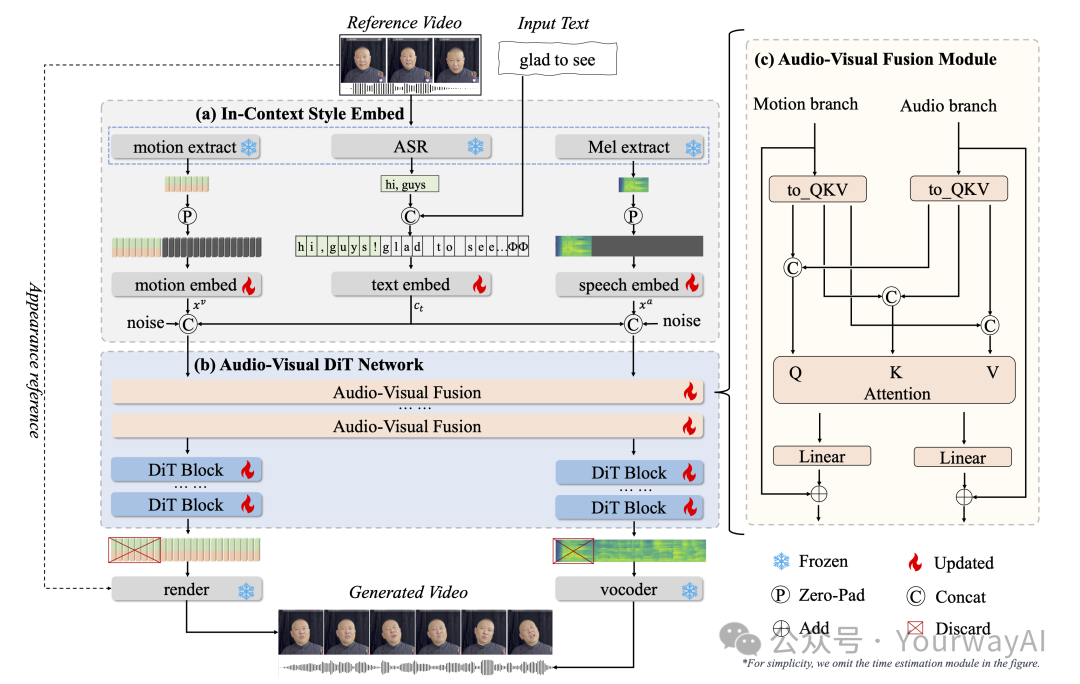

双分支DiT如何工作?

-

1. 音频分支:文本→Wav2Vec2特征→Mel频谱生成 -

2. 视觉分支:文本→FLAME模型参数→面部动作单元 -

3. 融合模块:通过跨模态注意力实现音画同步

引用:

@article{omnitalker2025,

title={OmniTalker: Real-Time Text-Driven Talking Head Generation with Audio-Visual Style Replication},

author={Alibaba Tongyi Lab},

journal={arXiv preprint arXiv:xxxx.xxxxx},

year={2025}

}总结:

OmniTalker的推出标志着数字人生成进入"实时交互"时代。其创新的统一框架设计,在保持轻量化(0.8B参数)的同时,实现了影视级的内容产出。