人工智能应用正在迅速超越简单的对话。为了有效地采取行动与获取最新数据,AI应用在需要访问外部数据、API、日历和代码库。工具调用是其中的一种解决办法,但是不同工具对外接口存在巨大差别,为了规范工具调用,模型上下文协议 (MCP)应运而生。

模型上下文协议 (MCP) 标准化了 AI 代理发现和使用外部服务器的方式。以前,您必须通过插件调用 MCP 工具。在最新的 dify 版本中,MCP 实现了双向构建,以便更快、更可靠的集成和更容易的功能扩展:

-

• 直接从 Dify 调用任何 MCP 服务器。 -

• 将您自己的 Dify 代理或工作流程作为 MCP 服务器公开给其他客户端。

一、在Dify中调用MCP服务器

1、将 MCP 服务器配置为工具

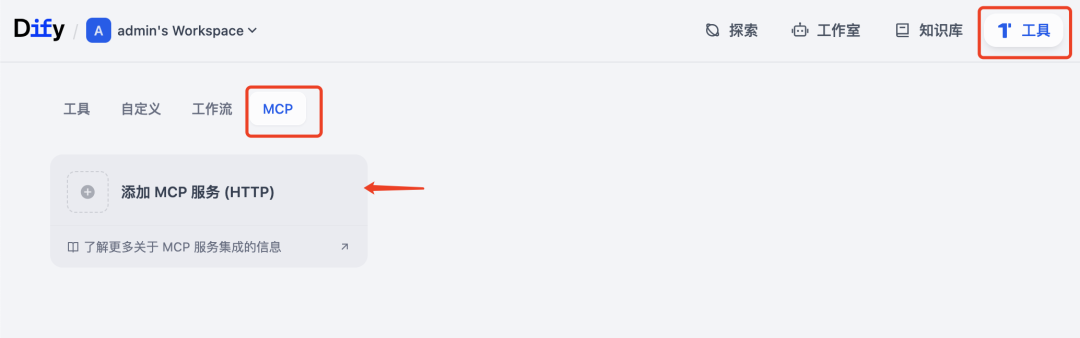

在“工具”页面上,选择 MCP,并添加服务器,例如Linear或Notion(原生 MCP 应用),或Zapier或Composio(集成平台)。一个 Zapier 配置即可解锁 8,000 多个授权应用。(注意:仅限基于 HTTP 的 MCP 服务器。)

1.1 Linear配置示例

-

• 1、工具 > MCP > 添加 MCP 服务器 -

-

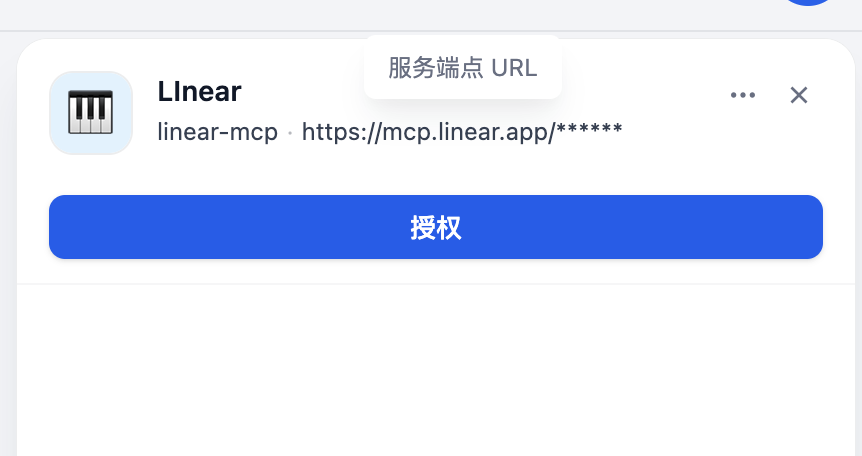

• 2、输入线性 MCP URL、显示名称和服务器标识符。 -

-

• 3、 完整授权。授权之后你将拥有 22 个 Linear 工具,可用于创建、更新和查询项目、问题、评论、文档、团队和用户。 -

2、智能地调用 MCP 工具

在提示词中定义代理的角色并接入Linear服务器,提示词如下:

“你是一个连接至Linear的代理,拥有22个API工具。请根据需要运用这些工具管理问题、项目及文档,并查询团队、用户与周期信息。”

当用户要求为研发团队创建事项时,代理将自动选取 get_team、get_user 和 create_issue 工具,完成任务的创建与分配。

3、在工作流中协调 MCP 工具

3.1 动态路径:代理节点

将“Linear”代理节点插入工作流。该代理会在运行时选择合适的线性工具。它非常适合处理复杂多样的任务,例如将用户反馈分类到三个专门的代理中:

-

• 正反馈代理→将亮点转发给市场营销。 -

• 技术问题代理→为支持创建错误任务。 -

• 产品建议代理→为产品生成结构化需求文档。

当反馈事项到达其专属客服人员时,客服人员会立即对内容进行排序,设置优先级,并使用 Linear 的 MCP API 在正确的团队项目中打开正确的问题。过去需要缓慢手动分类的工作现在只需几秒钟即可完成,因此每个部门都可以几乎实时地响应用户。

3.2 精准路径:独立 MCP 节点

将各个 MCP 工具添加为单独的工作流节点。您可以自行决定调用顺序,无需考虑 LLM 决策。此方法适用于:

-

• 标准化业务流程 -

• 严格排序的任务链 -

• 延迟或成本限制严格的情况

您可以通过添加知识库、通知插件或额外的 MCP 服务器来丰富工作流程,从而实现跨平台协作。

二、将DIFY工作流发布为MCP服务

在 Dify 应用的配置页面中,你可以找到 MCP 服务器的相关配置选项。该功能默认关闭,开启后,Dify 将为当前应用自动生成唯一的 MCP 服务器地址。此地址将作为外部工具访问你应用的专用接口。

任何 Dify 代理或工作流都可以作为标准 MCP 端点公开:

-

• 服务描述:简明说明工作流程的作用,以便外部 LLM 知道何时调用它。 -

• 参数说明:记录Start节点上的每个输入,以确保客户端传递正确的值。 -

完成这两个字段后,Dify 会发出一个服务器 URL。从该地址开始,您的工作流程将成为一个可重复使用的 MCP 标准服务器,Claude、Cursor 等工具或任何其他 MCP 客户端都可以直接调用。

三、结束语

原生 MCP 集成不仅仅是一项功能,更是对开放标准的承诺。您今天构建的应用程序已为未来互联的 AI 生态系统做好了准备。

建议在可能的情况下,尽快升级到 Dify v1.6.0 ,以便体验其双向MCP等新功能。

——正文结束——