本文介绍一种基于Ollama[1]部署的本地大模型和AnyCAD三维图形平台[2]开发交互式CAD智能助手的方法,实现基于大模型辅助建立二维、三维几何模型的功能;主要内容包括Ollama本地大模型部署,基于WebSocket实现AnyCAD与Ollama交互,基于模型上下文协议(MCP)实现模型交互。

1 简介

1.1 Ollama本地大模型部署

Ollama是一个高性能的大规模机器学习模型框架,支持在本地环境中的部署。

为了在本地环境中部署Ollama,首先需要确保你的服务器或工作站满足Ollama运行的硬件要求。本文使用i9-13900K + 64GB内存 + 4080S16G,基于qwen2.5 14b大模型。

Ollama安装和部署qwen2.5略。

1.2 模型上下文协议MCP

模型上下文协议(Model Context Protocol, MCP)定义了如何在应用程序和机器学习模型之间传递信息的标准格式。它使得不同来源的数据能够以统一的方式被理解,从而简化了模型的应用过程。

1.3 AnyCAD图形平台

AnyCAD图形平台提供C++、.NET、Python、Java等API,可以方便的开发CAD/CAE/CAM应用程序,其简洁的API[3],非常适合AI大模型调用。在gitee上提供了丰富的示例[4],可快速上手。AnyCAD .NET SDK[5]在nuget上累计下载超过30W次。

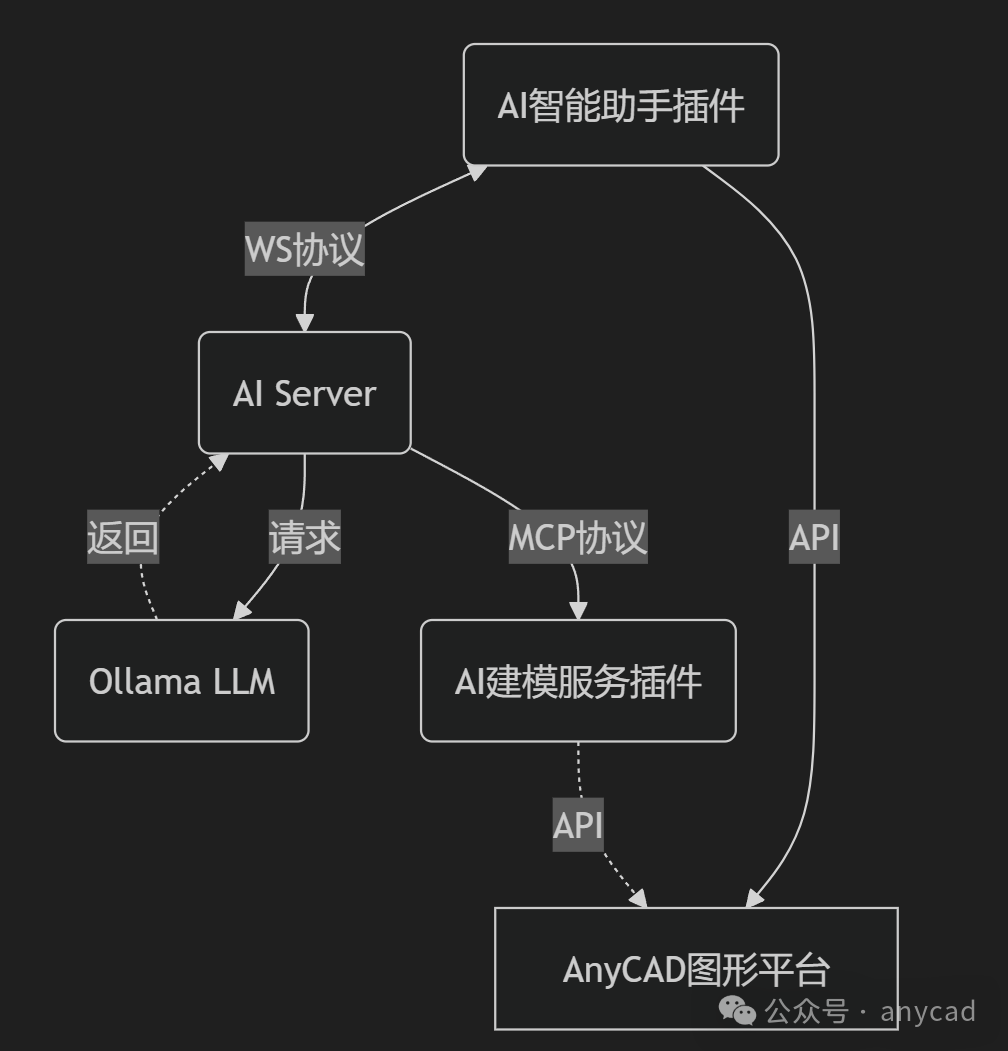

2 整体架构

系统整体架构如下图所示:

其中:

-

• AI智能助手

基于AnyCAD图形平台API,实现智能助手的客户端插件,主要与AI Server通过WebSocket协议进行通信。

-

• AI建模服务插件

基于AnyCAD图形平台API,实现智能助手的插件,实现MCP协议。

-

• AI Server

通过Ollama提供的API与LLM交互,通过WebSocket接收AI智能助手的请求并返回AI模型响应。

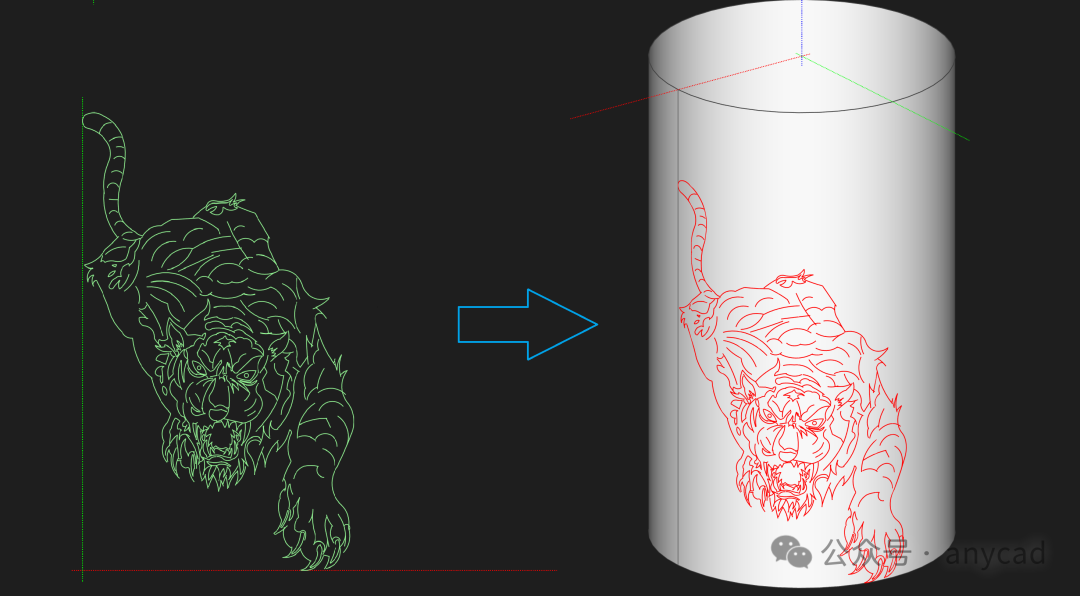

3 效果展示

• AI助手二维绘图

4 小结

通过简单的验证,走通了开发AI智能助手的流程。但要应用于工程应用还需要做更多的工作和深入的优化才能实现更智能的CAD智能助手。