用Qwen-7B做Agent,本来信心满满,结果MCP一跑,选工具选不对、参数填得稀巴烂,准确率惨不忍睹,最高也就60%徘徊。

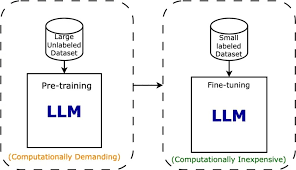

后来我发现:普通LoRA根本救不了复杂工具调用。

真正能救命的,是2026年最火的解耦微调(Decoupled Fine-Tuning)。

一句话总结它的核心:

把“选工具”和“填参数”彻底拆开,分别训练两个LoRA,谁也别干扰谁。

只用3步,就能让你的模型起飞

第一步:拆任务,造数据不再一股脑丢给模型全部轨迹,而是切成两份干净的数据集:

-

数据集A(工具选择):历史对话 → 只输出工具名字 -

数据集B(参数生成):历史 + “已选工具:xxx” → 只输出JSON参数

用Claude/GPT批量生成,1个工具300-800条,10个工具也就几千条,成本不高。

第二步:分别训两个LoRA

-

第一个LoRA:只负责选工具(共享一个适配器) -

每个工具再训一个专属LoRA:只负责生成该工具的参数

用QLoRA + LLaMA-Factory或者HuggingFace PEFT,单张4090或A100就能跑,3个epoch几小时搞定。

第三步:推理时动态拼装对话来了 → 先加载选工具LoRA → 得到工具名 再加载对应工具的参生成LoRA → 拿到完美JSON 执行 → 循环

实测效果我之前MCP准确率60%出头,用解耦微调后直接冲到92-95%,幻觉和格式错误几乎消失,Agent终于能稳定干活了。

想立刻上手?

最快路径:

-

克隆 LLaMA-Factory 或用 unsloth 加速 -

先把工具列表写成OpenAI schema -

用强模型批量生成拆分好的数据集 -

分别训 selection 和 per-tool argument LoRA -

vLLM + LoRAX 动态加载推理

一句话总结别再死磕一个LoRA包打天下了。工具调用任务,解耦才是王道。

2026年做Agent的人,谁先掌握解耦微调,谁就能领先一步。