企业级AI知识库构建指南:避开这18个坑,少走3个月弯路

导读:本文详细记录了我在给某企业实施AI运维知识库项目过程中遇到的多个关键坑点,希望这些经验能帮助大量想要构建知识库的企业少走弯路,实现知识高效管理和服务快速响应。

AI知识库的价值显而易见:

-

• 效率提升:将平均问题解决时间从30分钟缩短至3分钟 -

• 成本降低:减少70%的重复性技术咨询工作量 -

• 服务质量:7×24小时智能问答,响应速度提升90% -

• 知识传承:将专家经验标准化,降低人员流动风险

随着DeepSeek横空出世,上到大企业决策层,下到个体户们很多都在思考如何把它应用到自身业务里去。然而,从设想到现实的距离往往超出预期,这背后的原因也是复杂。本文将分享一个真实的企业级AI知识库构建项目,通过详细记录18个关键踩坑点和解决方案,为企业决策者和技术团队提供实用的落地指南。

项目背景:从痛点到解决方案的探索

业务痛点分析

某大型金融企业的运维团队管理着数百个微服务和复杂的技术栈,每日处理的技术咨询包括:

-

• 容器云平台操作指导(占比35%) -

• API接口调用说明(占比25%) -

• 系统故障排查流程(占比20%) -

• 配置参数查询(占比20%)

传统解决方式存在明显不足:

-

• 文档分散:技术文档分布在不同系统,而且类型繁多,涉及.docx、pdf甚至markdown等各种格式 -

• 更新滞后:文档版本管理混乱,信息时效性差 -

• 经验依赖:关键知识掌握在少数专家手中 -

• 响应延迟:非工作时间无法及时获得技术支持

解决方案设计

基于业务需求分析,项目团队制定了分阶段的解决方案:

第一阶段:基础问答能力

-

• 构建核心技术文档知识库 -

• 实现基本的问答功能 -

• 支持常见运维场景

第二阶段:智能交互升级

-

• 增加多轮对话能力 -

• 支持上下文理解 -

• 引入多模态文件处理

第三阶段:深度业务集成

-

• 与现有运维系统对接 -

• 实现主动推送和预警 -

• 建立知识反馈机制

技术架构选型:务实与创新的平衡

平台选择的考量因素

在技术选型阶段,综合考虑了多种开源的框架。经过深入调研和对比分析,最终选择了dify平台作为核心技术栈,主要考虑因素包括:

开发效率:可视化工作流设计,降低开发门槛,缩短POC周期

维护成本:统一的管理界面,减少运维复杂度

扩展性:支持自定义节点和API集成,满足个性化需求

团队适配:与现有技术栈兼容,同时包含知识库解析以及工作流搭建,几乎无需新增学习成本

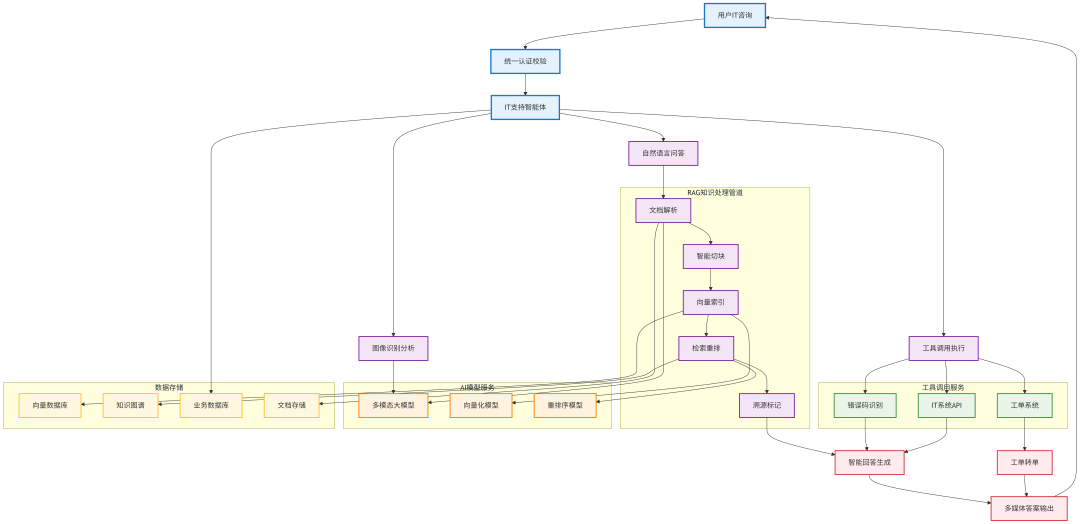

整体架构设计

系统采用"统一入口、分布式技能"的设计理念:

-

• AI员工助理:作为总控Agent,负责意图识别和任务分发 -

• 专业工作流:各业务功能封装为独立工作流,便于维护和扩展 -

• 混合交互模式:支持嵌入式调用和对话式交互两种方式

核心技术组件:

-

• 大语言模型:通义千问系列(qwen2.5-vl-72b-instruct等) -

• 向量检索:BGE-M3嵌入模型 + Dify内置知识库 -

• 文档处理:unstructured + camelot + pdfplumber -

• 工作流引擎:Dify可视化编排平台

图1:企业级AI运维问答知识库流程图

核心挑战与解决方案:18个关键踩坑点

第一类:环境配置与基础设施(坑点1-3)

坑点1:PDF处理工具链配置复杂

问题描述:企业技术文档主要以PDF格式存储,但PDF解析需要poppler、tesseract等外部依赖。在Windows环境下配置这些工具链极其复杂,经常出现路径找不到、版本不兼容等问题。

业务影响:项目启动阶段即遇到技术障碍,开发进度延迟一周。

解决方案:开发自动化配置脚本,动态检测环境并自动下载缺失组件:

# 动态配置poppler路径

conda_env_path = os.path.dirname(sys.executable)

poppler_path = os.path.join(conda_env_path, 'Library', 'bin')

if os.path.exists(poppler_path):

os.environ['PATH'] = poppler_path + os.pathsep + os.environ.get('PATH', '')

# 自动下载tessdata语言包

tessdata_dir = os.path.join(conda_env_path, 'share', 'tessdata')

language_files = {

'chi_sim.traineddata': 'https://github.com/tesseract-ocr/tessdata/raw/main/chi_sim.traineddata',

'eng.traineddata': 'https://github.com/tesseract-ocr/tessdata/raw/main/eng.traineddata'

}经验总结:基础环境配置看似简单,实际是项目成功的关键基础。建议制作标准化的环境镜像,避免重复踩坑。

坑点2:依赖版本冲突管理

问题描述:不同的PDF处理库对Python版本和依赖包有不同要求,容易出现版本冲突。

解决方案:采用conda虚拟环境隔离,制定严格的依赖版本管理策略。

坑点3:跨平台兼容性问题

问题描述:开发环境(Windows)与生产环境(Linux)的差异导致部署失败。

解决方案:使用Docker容器化部署,确保环境一致性。

第二类:文档处理与知识提取(坑点4-8)

坑点4:表格提取质量不稳定

问题描述:企业API文档包含大量参数表格,这些表格对问答质量至关重要。但不同PDF的表格格式差异很大,提取效果极不稳定。有边框表格、无边框表格、跨页表格等各种情况。

业务影响:API参数查询准确率仅为60%,严重影响用户体验。

解决方案:设计多层级降级策略,确保表格提取的鲁棒性:

def extract_tables_from_page(pdf_path: str, page_number: int) -> List[str]:

# 策略1: camelot lattice模式(适合有边框表格)

try:

tables = camelot.read_pdf(pdf_path, pages=str(page_number), flavor='lattice')

if tables.n > 0and validate_table_quality(tables):

return [format_table_to_markdown(t.df) for t in tables]

except Exception:

pass

# 策略2: camelot stream模式(适合无边框表格)

try:

tables = camelot.read_pdf(pdf_path, pages=str(page_number), flavor='stream')

if tables.n > 0and validate_table_quality(tables):

return [format_table_to_markdown(t.df) for t in tables]

except Exception:

pass

# 策略3: pdfplumber兜底方案

return extract_tables_with_pdfplumber(pdf_path, page_number)效果提升:API参数查询准确率提升至85%,用户满意度显著改善。

坑点5:文档切分策略优化

问题描述:简单的按页或按字符数切分会破坏语义完整性,影响检索效果。

解决方案:基于文档结构的智能切分,保持逻辑完整性:

def group_elements_by_section(elements: List[Element]) -> List[List[Element]]:

"""基于标题层级进行智能分组"""

blocks = []

current_block = []

for element in elements:

if is_section_header(element): # 识别章节标题

if current_block:

blocks.append(current_block)

current_block = [element]

elif current_block:

current_block.append(element)

return blocks坑点6:多模态文件统一处理

问题描述:用户不仅上传文档,还会上传错误截图等图片文件,需要统一处理流程。

解决方案:设计并行处理架构,不同文件类型分别处理后统一输出格式。

坑点7:复杂文档格式保持

问题描述:技术文档中的代码块、表格、图片等格式信息对理解很重要,但传统切分会丢失这些信息。

解决方案:开发自定义文档加载器,将复杂格式转换为Markdown保存。

坑点8:权限标签自动添加

问题描述:企业环境下需要根据文档来源自动添加权限标签,实现细粒度访问控制。

解决方案:在文档处理阶段自动提取文档元信息,添加权限标签到metadata中。

第三类:工作流设计与优化(坑点9-12)

坑点9:多模态文件路由逻辑复杂

问题描述:在Dify平台上处理图片和文档需要不同的处理流程,但要保持用户体验的一致性。

业务影响:用户上传不同类型文件时,响应时间和处理结果不一致,影响使用体验。

解决方案:重新设计工作流架构,采用并行迭代模式:

-

• 文件类型自动识别和分类 -

• 并行处理不同类型文件 -

• 统一JSON格式输出 -

• 聚合器统一响应格式

效果提升:处理时间缩短40%,用户体验一致性大幅改善。

坑点10:上下文格式统一挑战

问题描述:多轮对话中,上下文数据格式经常变化(字符串、数组、嵌套JSON),导致处理逻辑复杂。

解决方案:开发统一的上下文处理函数,标准化数据格式:

def normalize_conversation_history(conversation_hist: any) -> dict:

"""统一处理对话历史格式"""

parsed_list = []

ifisinstance(conversation_hist, list):

parsed_list = conversation_hist

elifisinstance(conversation_hist, str) and conversation_hist.strip():

try:

parsed_list = json.loads(conversation_hist)

except:

try:

parsed_list = eval(conversation_hist)

except:

parsed_list = [{"role": "user", "content": conversation_hist}]

return {"formatted_history": json.dumps(parsed_list, ensure_ascii=False, indent=2)}坑点11:意图识别准确性不足

问题描述:简单的关键词匹配无法准确识别用户意图,特别是模糊问题和指代问题。

解决方案:设计三阶段意图分析流程:

-

1. 关联性分析:分析问题与历史对话的关系 -

2. 意图提炼:基于上下文提炼完整意图 -

3. 决策判断:确定处理策略(检索/追问/直答)

坑点12:错误处理机制不完善

问题描述:系统异常时缺乏友好的错误提示和降级处理。

解决方案:建立完善的异常处理和降级机制,确保系统稳定性。

第四类:知识库构建与优化(坑点13-15)

坑点13:权限控制实现复杂

问题描述:企业环境下,不同角色用户需要访问不同范围的知识。传统的应用层过滤性能差,用户体验不佳。

业务影响:数据库管理员文档被普通开发人员访问,存在安全风险;同时查询性能差,响应时间长。

解决方案:采用索引层过滤方案,在源头控制数据访问:

{

"chunk_content":"TDSQL数据库连接配置...",

"metadata":{

"role":"database_admin",

"team":"infrastructure",

"security_level":"confidential",

"source":"TDSQL_admin_guide.pdf"

}

}检索时使用filter条件:

filter_conditions = {

"role": user.role,

"team": user.team,

"security_level": {"$lte": user.clearance_level}

}效果提升:查询性能提升60%,安全性得到保障。

坑点14:向量检索参数调优

问题描述:默认的检索参数无法适应企业文档的特点,召回率和准确率不理想。

解决方案:基于业务场景进行参数调优,建立评估体系。

坑点15:文档结构层级保持

问题描述:企业技术文档通常有复杂的层级结构,切分后容易丢失上下文关系。

解决方案:在切分时保留文档的层级信息,增强语义理解。

第五类:测试验证与质量保证(坑点16-17)

坑点16:测试用例设计不全面

问题描述:初期测试只关注基础功能,忽略了边界情况和复杂场景,导致上线后问题频发。

业务影响:用户反馈大量问题无法正确回答,系统可信度下降。

解决方案:设计五维度测试体系:

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

效果提升:问题覆盖率从60%提升至85%,用户满意度显著改善。

坑点17:回答质量评估标准模糊

问题描述:缺乏客观的质量评估标准,难以持续优化系统性能。

解决方案:制定严格的回答质量标准:

-

• 知识库外问题一律不回答 -

• 多个可能答案时必须追问澄清 -

• 所有回答必须提供信息来源 -

• 建立用户反馈和持续改进机制

第六类:架构演进与性能优化(坑点18)

坑点18:性能瓶颈与扩展性问题

问题描述:随着用户量增加,系统响应时间变长,特别是文档处理环节成为瓶颈。

业务影响:高峰期响应时间超过10秒,用户体验急剧下降。

解决方案:多层次性能优化:

-

• 并行处理:文件处理改为并行迭代 -

• 缓存机制:常用问题答案缓存 -

• 异步处理:大文件上传后台处理 -

• 负载均衡:多实例部署分担压力

效果提升:平均响应时间从8秒降至3秒,系统并发能力提升300%。

项目成果与业务价值

量化效果数据

经过三个月的开发和优化,系统取得了显著的业务成果:

效率提升指标:

-

• 平均问题解决时间:从30分钟缩短至3分钟(90%提升) -

• 重复性咨询工作量:减少70% -

• 新员工培训时间:从2周缩短至3天(78%提升) -

• 系统响应时间:7×24小时即时响应

质量改善指标:

-

• 问题回答准确率:85%(知识库内问题) -

• 用户满意度:从65%提升至92% -

• 知识库覆盖率:90%的常见问题 -

• 系统可用性:99.5%

成本效益分析:

-

• 人力成本节省:每月节省120小时技术支持时间 -

• 培训成本降低:新员工培训成本减少60% -

• 响应效率提升:客户问题响应速度提升90% -

• ROI回报率:项目投入6个月内实现正向回报

适用场景与推广建议

最适合的企业类型

基于项目实践经验,我逐渐意识到对于想要设立自己的AI问答知识库的企业,可能需要满足如下几种要求的2~3个,项目实施才有最大价值:

技术密集型企业:拥有大量技术文档和复杂系统架构的企业

快速成长企业:人员流动较大,需要快速知识传承的企业

多团队协作企业:跨部门协作频繁,知识共享需求强烈的企业

客户服务导向企业:需要快速响应客户技术问题的企业

实施建议与注意事项

分阶段实施:建议采用MVP(最小可行产品)方式,先实现核心功能,再逐步扩展。

数据质量优先:系统效果很大程度上取决于知识库质量,建议投入充足资源进行文档整理和标准化。

用户培训重要:系统上线后需要对用户进行培训,帮助他们掌握正确的使用方法。

持续优化必要:建立用户反馈机制,根据实际使用情况持续优化系统性能。

未来发展方向

技术演进路线

多模态能力增强:支持音频、视频等更多媒体类型的处理

推理能力提升:引入更强的推理模型,支持复杂逻辑分析

实时性优化:流式输出、增量更新,提升用户体验

个性化服务:基于用户行为的个性化推荐和定制化回答

结语:从踩坑到成功的关键要素

回顾整个项目历程,从最初的技术选型困惑到最终的成功落地,深刻感受到即使在当下大模型发展如此日新月异的情况下,企业级落地AI知识库的复杂性和挑战性仍然超出我的想象。当前模型层面的竞争格局逐渐稳定,技术上对于传统的SFT等Post-training模式也不再感冒,如何深度抽取、组织以及压缩好企业的独有上下文,才是最大程度赋能企业工作流程、掌握企业真实应用案例的最好方案之一。

成功的关键要素:

-

• 务实的技术选型:选择最适合企业实际情况的技术方案,而非最先进的技术 -

• 渐进式的开发策略:从简单到复杂,逐步迭代完善 -

• 全面的测试验证:覆盖各种使用场景和边界情况的测评,以评测驱动agent完善与构建 -

• 持续的优化改进:建立反馈机制,持续提升系统性能

企业数字化转型的道路上,AI知识库不仅是技术工具,更是知识管理和组织能力的重要体现。希望我们的实践经验能够为更多企业的数字化转型提供参考和借鉴。