目录:

01 引言

02 API 网关的相关概念

03 API 网关的演进历程和分类

04 API 网关的核心能力和应用场景

05 如何使用阿里云云原生 API 网关接入 DeepSeek

引言

Cloud Native

API 网关作为管理 API 的核心组件,在整个架构体系中扮演着至关重要的角色,它就像是一个智能的交通枢纽,负责协调和管理各种 API 请求,确保请求的安全和稳定,实现高效和丝滑的响应。大模型应用的很多刚性诉求正在通过 API 网关来满足,例如:

-

后端接多个大模型,这即是产品体验考虑,也是稳定性的考虑,已是大模型应用的标配,无论是对话型应用,还是代码类应用。 -

是否具备联网搜索,大模型的生成质量相差很大,前端要透出联网搜索能力的选项。 -

内容输出安全和合规,在内容生成前进行管控。 -

语义缓存,将 API 的响应结果临时存储在缓存服务器中,当有相同的请求再次到来时,直接从缓存中获取响应结果,降低官方 API 的调用成本。 -

调用方配额限速,对每个调用方(如用户、应用程序、IP 地址等)在一定时间内对 API 的调用次数、流量大小或资源使用量进行限制的机制。 -

后端保护式限流,对 API 的访问流量进行管理和控制,确保 API 能够稳定、高效地运行,包括负载均衡、限流、降级、熔断等能力。

API 网关的相关概念

Cloud Native

-

HTTP API:基于 HTTP 协议的接口,以路由为中心。适用于适用于对接口没有统一规范约束的场景,例如 K8s Ingress、微服务架构、AI(SSE)等场景,实现服务的对外快速暴露。 -

REST API:RESTful 风格的 HTTP接 口,以资源为导向,通过标准 HTTP 方法(如 GET、POST 等)对资源进行操作,所有接口遵循统一的 OpenAPI 规范,适用于 API First、跨团队协作、API 精细化管控等场景。 -

WebSocket 协议接口:适用于双向实时通讯,如 AI、IoT、即时通讯等。相比 HTTP API,WebSocket 提供了实时数据传输能力,内置长连接相关默认配置。 -

AI API:针对 AI 网关优化的 API 类型,提供更友好的 AI 网关配置和调试能力,并预置 AI 代理、AI 观测、消费者鉴权、内容安全防护等插件能力。

API 网关(即 API Gateway,简写:APIG)是一种提供 API 托管服务的中间件。它处于客户端和后端服务之间,是客户端访问后端服务的唯一入口。所有来自客户端的请求都首先经过 API 网关,然后由 API 网关将请求路由到后端的服务。它就像一个门卫,负责对请求进行身份验证、权限检查、流量控制等操作,确保 API 请求的安全和稳定。

-

域名:浏览器里的地址,客户端请求的开始,即 www.xxx.com。 -

DNS:域名系统,将域名地址解析位对应的 IP 地址,用于计算机在网络上的互相识别和通信。 -

IP 地址:为互联网上的每个设备(如计算机、手机、路由器等)提供了一个逻辑地址,确保数据包可以准确地从源设备发送到目标设备。 -

路由:指在网络中,数据包从源地址到目的地址传输过程中所经过的路径选择过程。创建路由过程中,可以定义请求的路径、方法、参数等规则,将请求分发到对应的后端服务。 -

来源和服务:请求到了 API 网关后,通过动态获取后端服务列表才能继续访问服务,需要支持容器服务、Nacos、固定地址、DNS 域名和 Serverless 计算等多种形式,来添加服务。 -

环境:定义了 API 生命周期管理过程中的不同状态,API 可以被发布到不同的自定义环境中,如开发环境、测试环境、生产环境等,以便在不同阶段对 API 进行测试和管理。 -

API 分组:是同一种业务 API 的集合,可视为一种服务,如征信查询服务。API 开发者以 API 分组为单位,管理分组内的所有 API,方便对同类业务的 API 进行统一管理和维护。 -

消费者:是客户端访问 API 的凭证。启用消费者,需要在对应接口/路由中开启消费者认证,并创建消费者与接口/路由的授权关系。开启消费者认证后,只有被消费者授权的接口/路由,才可使用对应凭证访问。

API 网关的演进历程和分类

Cloud Native

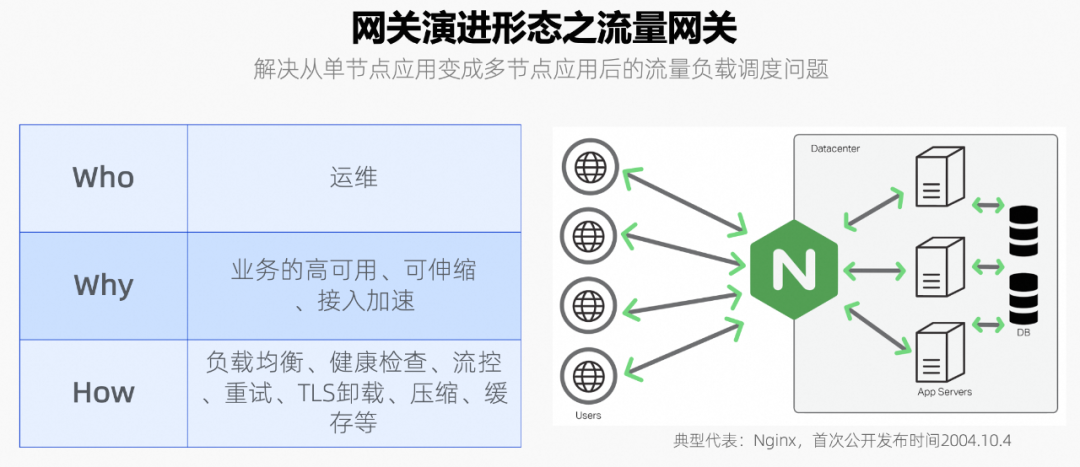

负责管理和优化数据流量,以提升业务的可伸缩性和高可用性。Nginx 作为流量网关的代表性软件,以其高效的性能和灵活的配置广受欢迎。流量网关的核心目的是解决多业务节点的流量负载均衡问题,通过智能调度将客户请求分配到不同的服务器上,从而均匀分摊负载,避免单点故障,确保服务的稳定性和连续性。

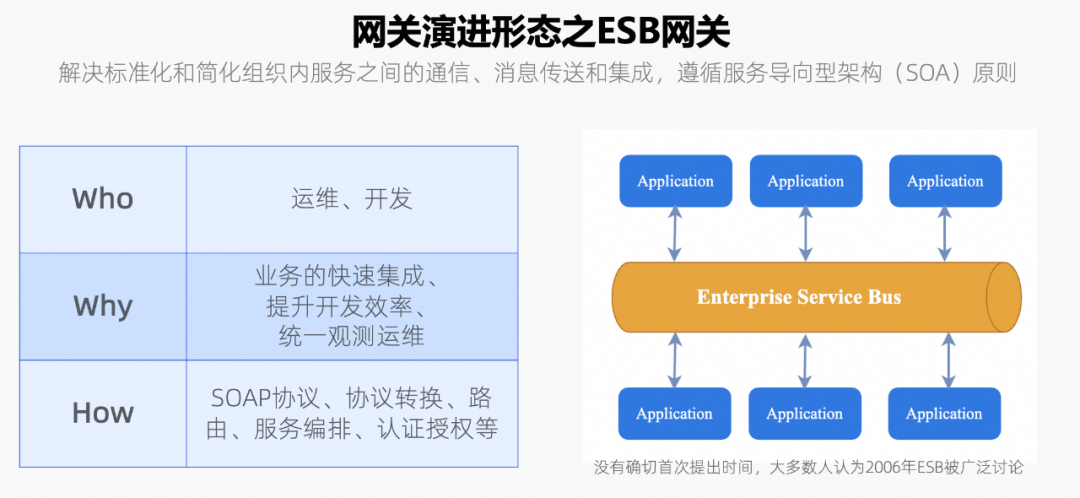

专为企业设计的关键集成解决方案,旨在标准化和简化不同系统和服务之间的通信与消息传送。遵循服务导向型架构(SOA)原则,ESB 通过集中管理消息路由、转换和安全,实现服务的快速部署和高效运作。

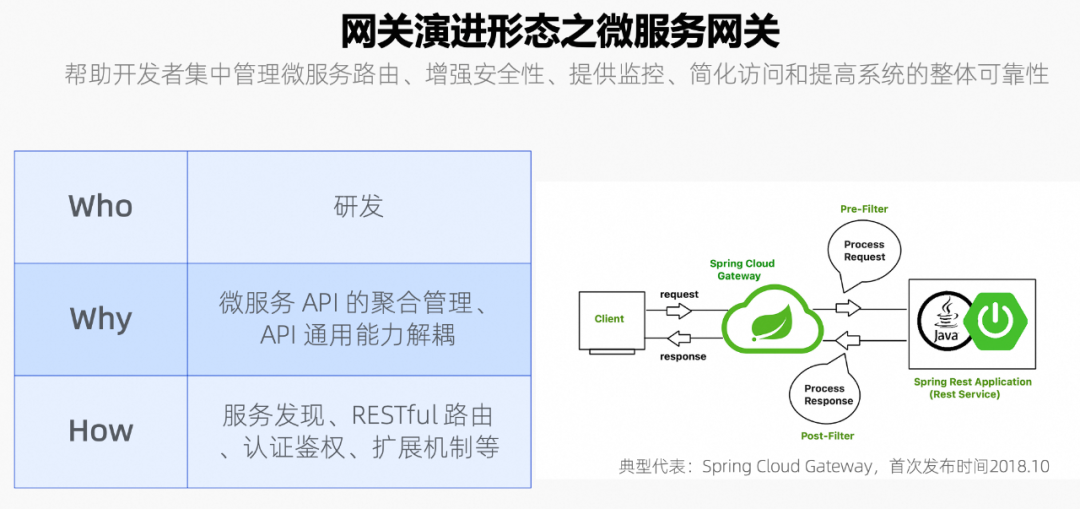

负责集中管理微服务的路由规则,增强系统安全性,提供性能监控,并简化访问流程,从而提高整个系统的可靠性。微服务网关可以实现负载均衡、限流、熔断、身份验证等功能,通过统一入口管理和优化各微服务间的交互。此举不仅简化了客户端与微服务的通信复杂性,还为系统安全提供了额外的保护,Spring Cloud Gateway 是一个广泛应用的微服务网关,它基于 Spring 生态系统,易于与 Spring Boot 项目集成,因其灵活、高效和可扩展性受到了开发者的青睐。

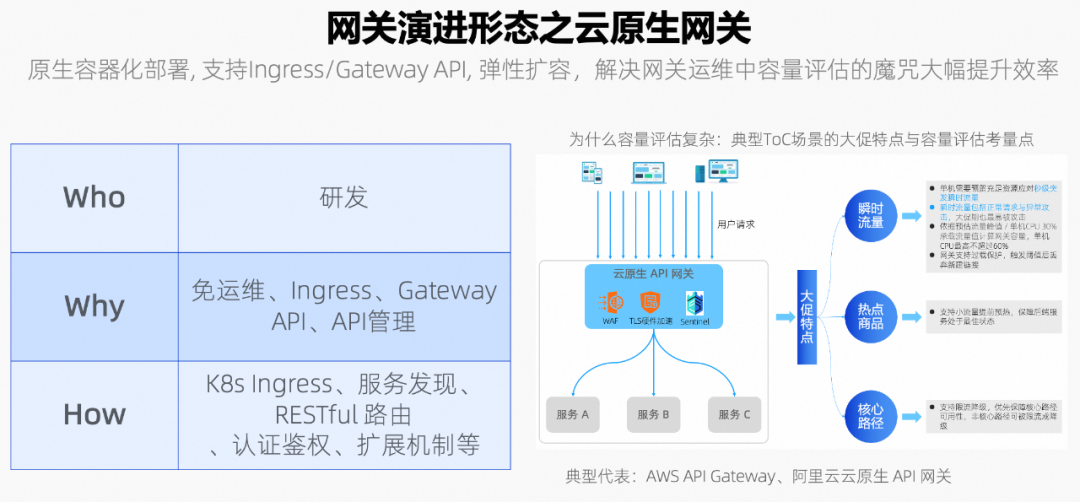

伴随 K8s 的广泛应用而诞生的一种创新网关,K8s 集群内外网络天然隔离的特性要求通过网关来将外部请求转发给集群内部服务,K8s 采用 Ingress/Gateway API 来统一网关的配置方式,同时 K8s 提供了弹性扩缩容来帮助用户解决应用容量调度问题,基于此用户对网关产生了新的诉求:期望网关既能有流量网关的特性来处理海量请求,又具备微服务网关的特性来做服务发现与服务治理,同时要求网关也具备弹性扩缩容能力解决容量调度问题,例如 Envoy 和 Higress 是典型的开源云原生网关。

我们认为,AI 网关并不是独立于云原生网关的新形态,本质上也可以称之为云原生网关,区别在于针对 AI 场景的新需求专门做了扩展,例如提供多模型灵活切换&兜底重试、大模型内容安全和合规、语义化缓存、多 API Key 均衡、Token 配额管理和限流、大模型流量灰度、调用成本审计等能力。业内,Higress 和 Kong 在云原生网关的基础上,演进出了专门面向 AI 场景的能力,此外,还有 Traefix、Cloudflare 均设计了 AI 网关的产品和服务。关于 AI 网关的核心能力,可以参考我们之前的文章《AI 网关需要具备的 10 大基本能力》。

API 网关的核心能力

Cloud Native

由于围绕 API 提供的网关能力繁多,涉及的角色众多,我们将所有能力基于使用方进行分类,包括研发、供应和消费三类场景,分别对应 API 接口的研发团队、API 平台的研发和运维团队、API 平台的外部调用方。

API First 是先定义好 API 规范,再 code。不同于不定义 API,直接 coding,API First 强调的是在构建应用程序之前优先设计和开发 API 接口,将 API 视为系统的核心架构组件,通过定义良好的接口规范实现模块化。例如公共云的云产品都提供了 API 的调用方式,微信小程序、钉钉开放平台也面向开发者提供了 API 接口,类似乐高积木的模块化系统,通过标准接口实现服务间的灵活组合,提升系统的可扩展性和维护性,从而提升生态效率。在研发场景下,API 网关可以覆盖 API 的设计、开发、测试、发布、售卖、运维监测、安全管控、下线等围绕 API 的各个生命周期。

-

API 安全:保护 API 免受各种安全威胁,确保只有经过授权的用户、应用程序能够访问 API,并保障数据在传输和存储过程中的保密性、完整性和可用性。例如身份验证、授权管理、数据加解密、防攻击机制。 -

灰度:是一种在生产环境中逐步引入新 API 版本或功能的策略,允许将一部分用户或请求流量导向新版本的 API,同时将其余部分仍保持在旧版本上,从而在不影响整体系统稳定性和用户体验的前提下,对新 API 进行测试和验证。 -

缓存:指将 API 的响应结果临时存储在缓存服务器中,当有相同的请求再次到来时,直接从缓存中获取响应结果,而无需再次访问后端服务器,从而提高 API 的响应速度和系统的性能。

-

调用审计:对 API 的调用活动进行全面记录、监控和分析的过程。它会详细记录每一次 API 调用的相关信息,包括调用时间、调用方身份、调用的 API 接口、请求参数、响应结果、响应时间等。 -

调用方配额限速:指 API 网关根据预先设定的规则,对每个调用方(如用户、应用程序、IP 地址等)在一定时间内对 API 的调用次数、流量大小或资源使用量进行限制的机制。 -

后端保护式限流:对 API 的访问流量进行管理和控制,确保 API 能够稳定、高效地运行,避免因流量过大或异常流量导致的系统崩溃和性能下降,包括负载均衡、限流、降级、熔断等能力。

如何使用阿里云云原生

API 网关接入 DeepSeek

Cloud Native

-

专有网络 VPC 已创建公网 NAT 网关,并绑定公网弹性 IP,具体操作见创建和管理专有网络[1]、使用公网 NAT 网关 SNAT 功能访问互联网[2]。 -

基于上述 VPC,创建云原生 API 网关实例,具体操作请参见创建网关实例 [3]。

-

已集成模型接入 AI 网关 -

通用模型接入 AI 网关 -

AI 网关实现多模型代理

配置 AI 服务

1. 登录云原生 API 网关控制台。

2. 在左侧导航栏,选择实例,并在顶部菜单栏选择地域。

3. 在实例页面,单击目标网关实例名称。

4. 在左侧导航栏,选择服务,并单击服务页签。

5. 单击创建服务,在创建服务面板,参考如下信息配置 AI 服务:

-

服务来源:AI 服务。 -

大模型供应商:填写对应的模型供应商。 -

服务地址:使用默认配置。 -

API-KEY:填写模型供应商获取的请求凭证 API-KEY。 -

阿里云百炼配置示例: -

大模型供应商:阿里云百炼。 -

服务地址:https://dashscope.aliyuncs.com/compatible-model/v1 -

API-KEY:填写阿里云百炼获得的 API-KEY。

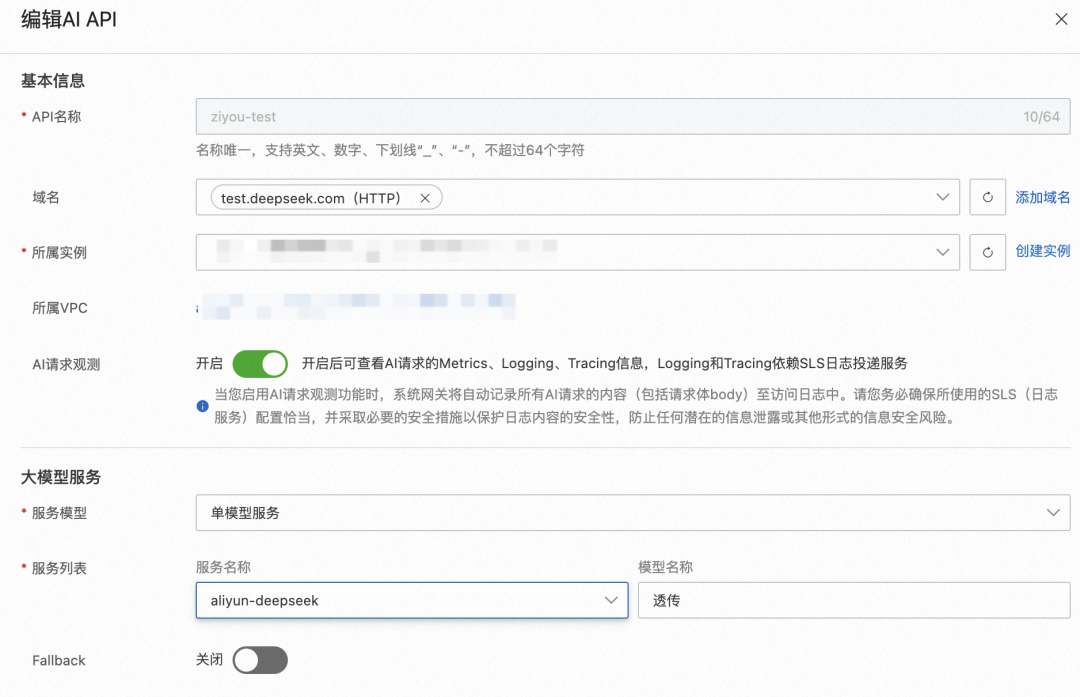

配置 AI API

1. 返回云原生 API 网关控制台首页,在左侧导航栏,选择 API。

-

域名:建议配置域名(使用默认环境域名下存在限流) -

所属实例:选择创建的实例 -

AI 请求观测:开启 -

服务模型:单模型服务 -

服务列表:点击添加,添加下列服务。并选择上一步中配置的阿里云百炼 DeepSeek 服务,模型名称配置为透传

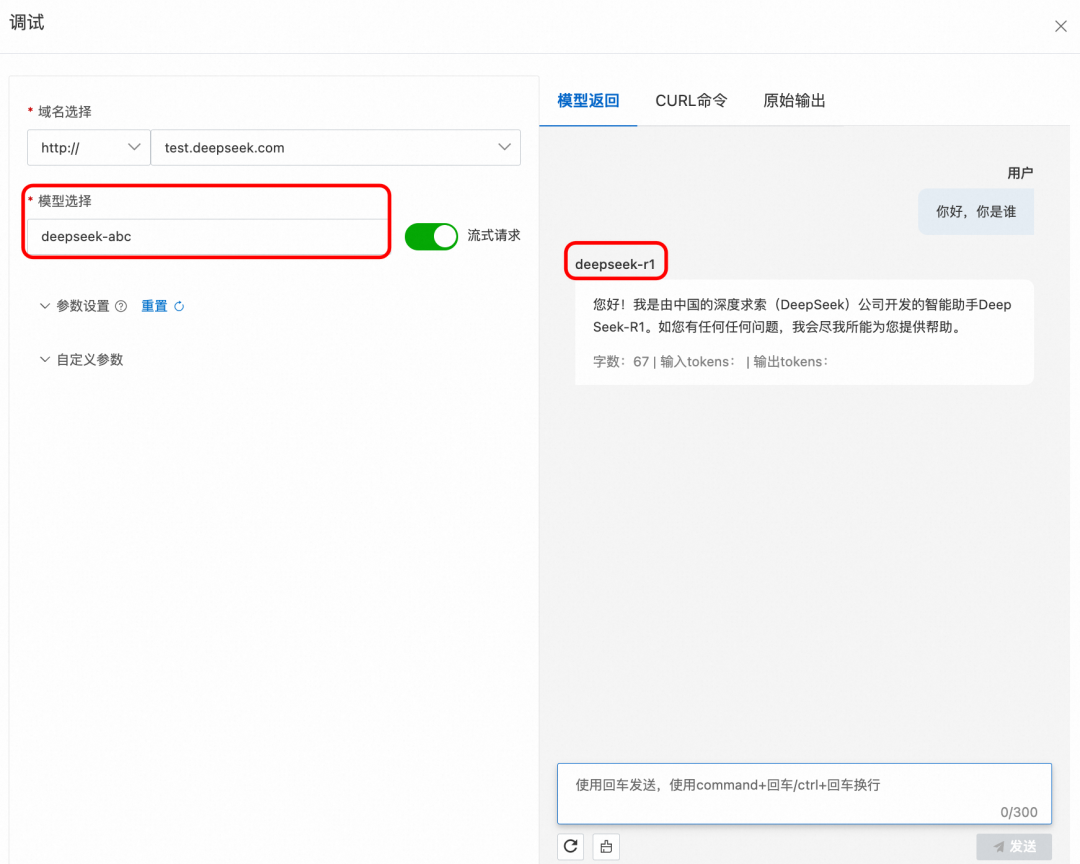

调试 AI API

-

对于云原生 API 网关中未集成大模型供应商,且该模型支持 OpenAI 协议。 -

对于通过在阿里云 PAI 或者 FC 等方式部署的 DeepSeek 服务。

本场景中,可直接参考 PAI 部署模型接入 AI 网关[4]方式中的进行接入。

配置 AI API

2. 在 AI API 创建时(或进入编辑态),按照以下方式配置大模型服务:

-

服务模型:多模型服务(按模型名称) -

服务列表:点击添加,添加下列多个服务。 -

选择上一步中配置的 PAI DeepSeek 服务,模型名称匹配规则配置为 DeepSeek-* -

选择上一步中配置的火山引擎 DeepSeek 服务,模型名称匹配规则配置为 ep-*

-

Fallback:开启 -

Fallback 列表:点击添加,添加下列服务。

-

选择上一步中配置的阿里云百炼 DeepSeek 服务,模型名称配置为 deepseek-r1

如图所示的配置会按照下列规则执行:

-

模型为 DeepSeek-* 时调用 PAI DeepSeek -

模型为 ep-* 时调用火山引擎 DeepSeek; -

在出错或限流场景下调用阿里云 DeepSeek。(如配置多个 Fallback,则按顺序调用)

调试 AI API