-

实测Grok3效果到底如何!发现中文好像蒸馏了Qwen!

首先说一下,我并不觉得Grok3有网友说的那么差,同时Grok3的中文能力支持的很好。当然可能是因为榜单效果超好的原因,所以大家觉得。。。。但实测速度真是特别快,让我觉得有种测试7B模型的感觉,不愧是有20w块GPU的男人!但确实是限时免费了,我遇到了普通版繁忙的情况,然后think也是24小时限制10次。为了测试think,写这篇文章,我又注册了3个账号,甩测!因为有普通版和think版,所以都…- 0

- 0

-

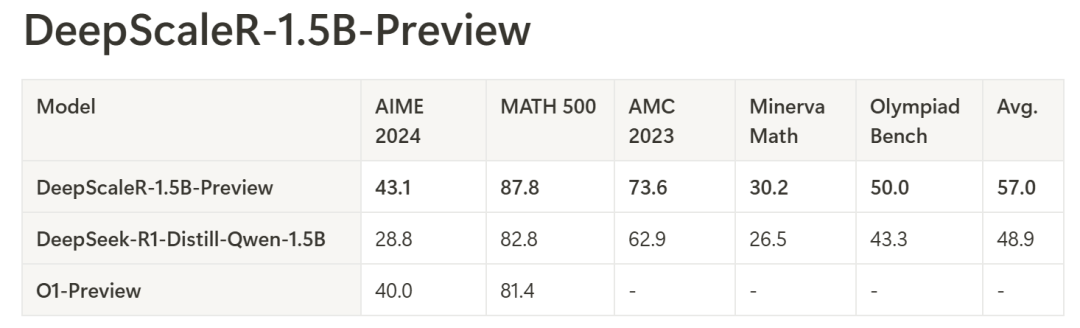

1.5B小模型逆袭!DeepScaleR如何用强化学习颠覆AI数学竞赛规则

大规模模型的训练常常需要庞大的计算资源和高昂的成本。然而,近日,来自加州大学伯克利分校的研究团队以一款1.5B参数的DeepScaleR模型,通过强化学习(RL)微调,成功超越了OpenAI的o1-preview,在AIME 2024等数学竞赛中展现出了强大的推理能力。这个令人震撼的突破让AI领域再次掀起了对小型模型的热议。突破性成就:1.5B小模型挑战大模型在AI界,许多人认为,要在数学推理和复…- 0

- 0

-

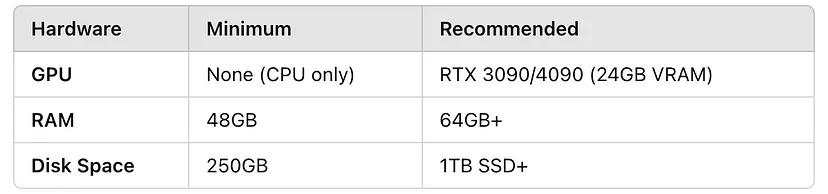

实战教程:用一张4090显卡+512GB内存部署671B的Deepseek大模型

近日,清华大学MADSys团队正式开源了面向资源受限环境的KTransformers算法框架。基于该框架的技术特性,用户可以在一张4090显卡的设备中部署满血671B的Deepseek。老王看到这个消息非常兴奋,因为这意味着只需要几万块钱就可以实现原本需要百万才能实现的“满血梦”。 老王在工作之余,赶紧找了一台设备,实际操练一下,先…- 0

- 0

-

DeepSeek-R1微调指南

DeepSeek-R1微调指南在这篇博文中,我们将逐步指导你在消费级 GPU 上使用 LoRA(低秩自适应)和 Unsloth 对 DeepSeek-R1 进行微调。关于LangChatLangChat 是Java生态下企业级AIGC项目解决方案,集成RBAC和AIGC大模型能力,帮助企业快速定制AI知识库、企业AI机器人。支持的AI大模型: Gitee AI / 阿里通义 /…- 0

- 0

-

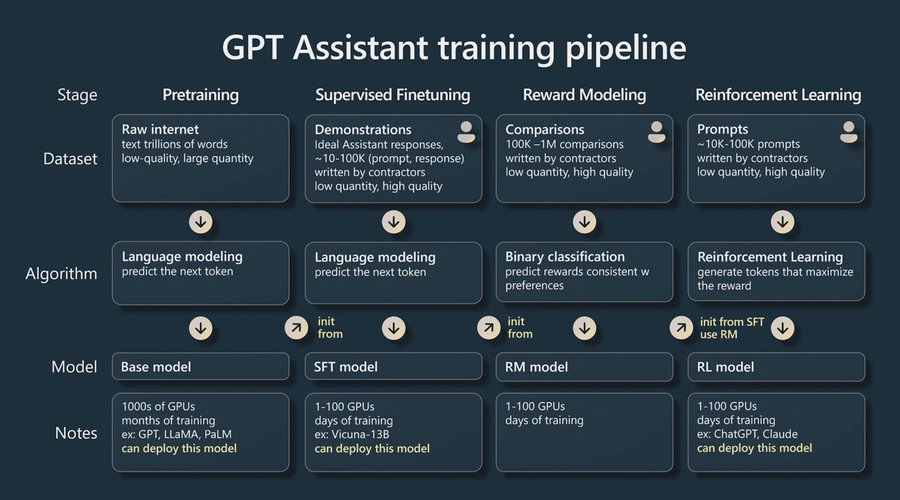

一文详解大模型训练全过程

本文将详细梳理从零开始训练大语言模型的全过程,包括预训练阶段、指令微调、奖励模型和强化学习的实现方式。一、预训练阶段(Pretraining)大模型的预训练是现代自然语言处理(NLP)技术中的核心步骤,特别是在基于Transformer架构的模型(如GPT系列、BERT等)中。预训练的目标是让模型能够从大量的无监督文本数据中学习语言的统计规律、语法结构、语义关系等,以便后续可以迁移到具体的下游任务…- 0

- 0

-

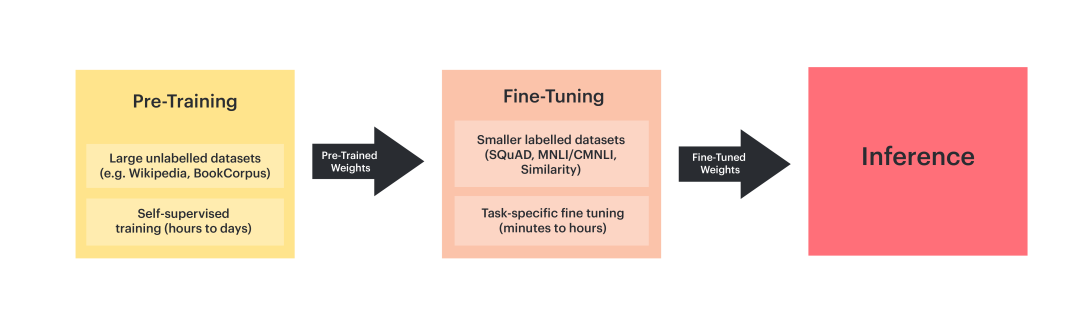

一文说清楚什么是预训练(Pre-Training)、微调(Fine-Tuning)

-正文-预训练和微调是现代AI模型的核心技术,通过两者的结合,机器能够在处理复杂任务时表现得更为高效和精准。预训练为模型提供了广泛的语言能力,而微调则确保了模型能够根据特定任务进行细化和优化。1. 什么是预训练?1.1 预训练的关键点1.2 通俗类比2. 什么是微调?2.1 微调中的关键点2.2 通俗类比3. 预训练与微调的区别4. 总结-- 领取学习资料大礼包,见文末近年来,人工智能(AI)在各…- 0

- 0

-

DeepSeek 本地部署——蒸馏版、量化版和满血版实测效果对比

引言随着 DeepSeek 受到世界范围广泛关注,官网服务经常不可用,除了调用第三方提供的 API 之外,本地部署也成为替代方案之一。本文将介绍本地部署 DeepSeek 的三种不同类型模型:满血版,1.58 bit 量化版和蒸馏版(Qwen 1.5B),使用同一代码生成问题进行效果评测,最后给出实际部署建议。硬件需求模型参数量最低硬件需求满血版671B16 卡 H100 或 8 卡 H2001.…- 0

- 0

-

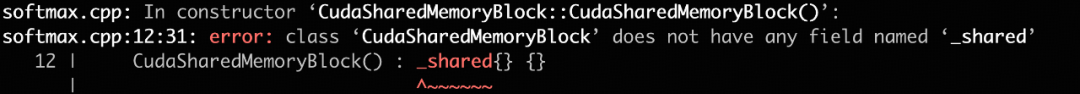

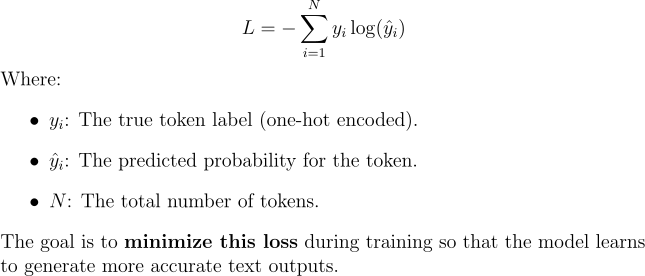

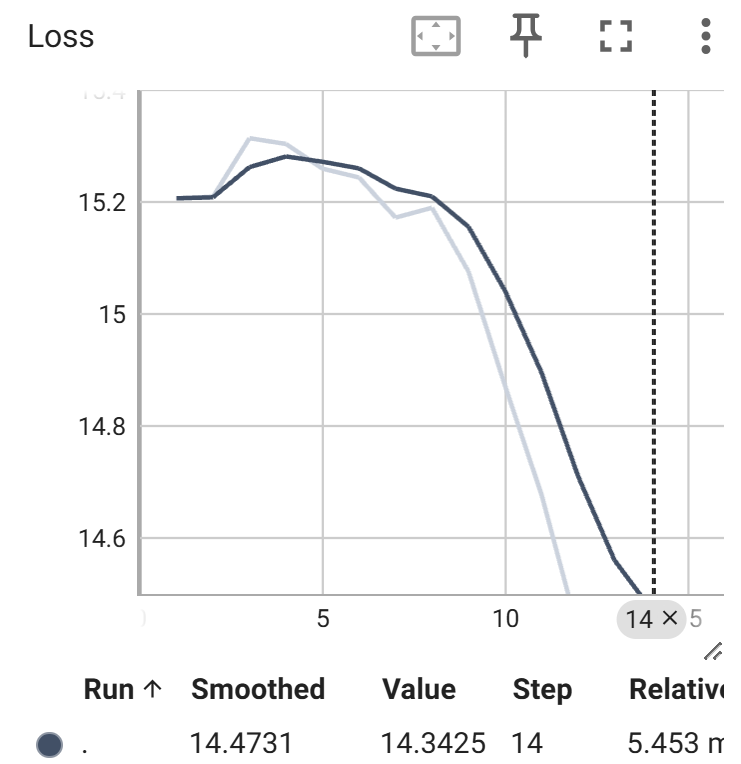

满足个性化需求,手把手教你微调DeepSeek大模型

DeepSeek LLM 微调全攻略。1 引言DeepSeek LLM性能强大,但要在特定场景发挥最大效能,微调是必不可少的。本文详细讲解如何用Hugging Face数据集和监督微调技术(SFT)对其微调,提供代码实操步骤;还会探讨损失函数、数据子集、低秩适应(LoRA)技术等要点。实操可借助Google Colab平台:colab.research.google.com 。2 监督微调(SFT…- 0

- 0

-

DeepSeek V3+R1满血微调工具上线!一键启动,硬件要求降10倍

DeepSeek V3/ R1 火爆全网,基于原始模型的解决方案和 API 服务已随处可见,陷入低价和免费内卷。如何站在巨人肩膀上,通过后训练(post-training)结合专业领域数据,低成本打造高质量私有模型,提升业务竞争力与价值?已收获近 4 万 GitHub Star 的 Colossal-AI,发布开源大模型后训练工具箱,包含:DeepSeek V3/ R1 满血 671B LoRA …- 0

- 0

-

DeepSeek R1 671B 完整版本地部署教程来了!!!

过年这几天,DeepSeek 算是彻底破圈了,火遍大江南北,火到人尽皆知。虽然网络版和 APP 版已经足够好用,但把模型部署到本地,才能真正实现独家定制,让 DeepSeek R1 的深度思考「以你为主,为你所用」。关于本地部署,大多数人使用的是蒸馏后的8B/32B/70B版本,本质是微调后的Llama或Qwen模型,并不能完全发挥出DeepSeek R1的实力。模型选择原版 …- 0

- 0

-

昇腾 910B 部署满血 DeepSeek-R1

春节前打印了 R1 的论文准备细看,打包时候忘记收拾没带回老家,但架不住假日期间 DeepSeek 的热度旱地拔葱,相关技术文章被推送了不少,总算是弥补缺憾。节后上班第一天上午大家忙于排队领红包,下午就都开始讨论起了这个模型,都有尝鲜的需求,最终大佬们拍板决定在 910B 16卡训练机器上来部署满血 R1 模型。于是当晚下载好了模型文件,第二天正式开搞。总体方案R1 模型发布的权重是 FP8 的,…- 0

- 0

-

如何训练LLMs像DeepSeek-R1“思考”

DeepSeek-R1(Paper Review: DeepSeek-R1——强化学习驱动的大语言模型推理能力提升)作为近期崭露头角的LLM,其在数学、编程、推理等多个领域展现出了强大的性能,特别是其“思考”能力,引起了业界的广泛关注。本文将深入探讨如何训练LLMs,使它们能够像DeepSeek-R1一样“思考”,从基础原理到具体训练方法,为AI研究者提供全面的指导。一、LLM训练的基础原理LLM…- 0

- 0

-

7G显存,训练你自己的DeepSeek-R1

用DeepSeek的方法做微调,可以显著提升传统模型的思考能力。这是我训练好的模型文件,已经传到Hugging Face上了,大家自取。它是基于Qwen2.5 3B,通过微调加强了数学能力,最后生成了Q4、Q5和Q8三个版本。咱们来对比一下Q4精度的效果。我问一个经典问题:9.9和9.11这两个数字,哪个更大?先来看原版的回答。不仅答案错了,而且给的理由也是完全混乱的——什么叫“小数部分相同,唯一…- 0

- 0

-

DeepSeek-R1 如何通过知识蒸馏将推理能力传递给 Qwen

DeepSeek-R1(深度解析 DeepSeek R1:强化学习与知识蒸馏的协同力量),作为一个通过大规模强化学习训练出的强大推理模型,在数学、编程等推理任务上达到了与OpenAI-o1相当的性能水平。然而,如此强大的模型如何能够在资源受限的设备上运行,成为了一个亟待解决的问题。DeepSeek团队通过创新的知识蒸馏技术,成功地将DeepSeek-R1的推理能力传递给了参数量更小的Qwen系列模…- 0

- 0

-

飞书多维表格+Deepseek王炸组合,最强AI agent工具

表格是咱们上班族使用最多的工具,表格+AI必须是工具中的王炸组合,也是最强的AI Agents 工具。 话不多说咱们直接奔入主题。小红书平台文案生成:输入文案之后自动生成小红书文案小红书文案生成功能这个操作非常简单,主要用到Deepseek R1 的处理,附带加了如何用表单页减少输入成本和如何在处理完成后给自己的飞书群发消息提醒。 首先我们去飞书文档页面新建一个多维表格,然后把多出来的几…- 0

- 0

-

谷歌 AI Agent 白皮书 3/3

本篇对应原白皮书以下章节:3. 通过针对性学习提升模型性能?现实场景通常需要超出训练数据的知识,有以下几种方法帮助模型/agent 获取这些知识:在推理时通过提示词提供示例基于检索的上下文学习 (RAG):提供外部知识库基于 Fine-tune 的学习:使用特定数据微调有效使用模型的关键之一是它们在生成输出时能够选择合适的工具,特别是在生产环境中大规模使用工具时。虽然一般的训练有助于模型发展这一技…- 0

- 0

-

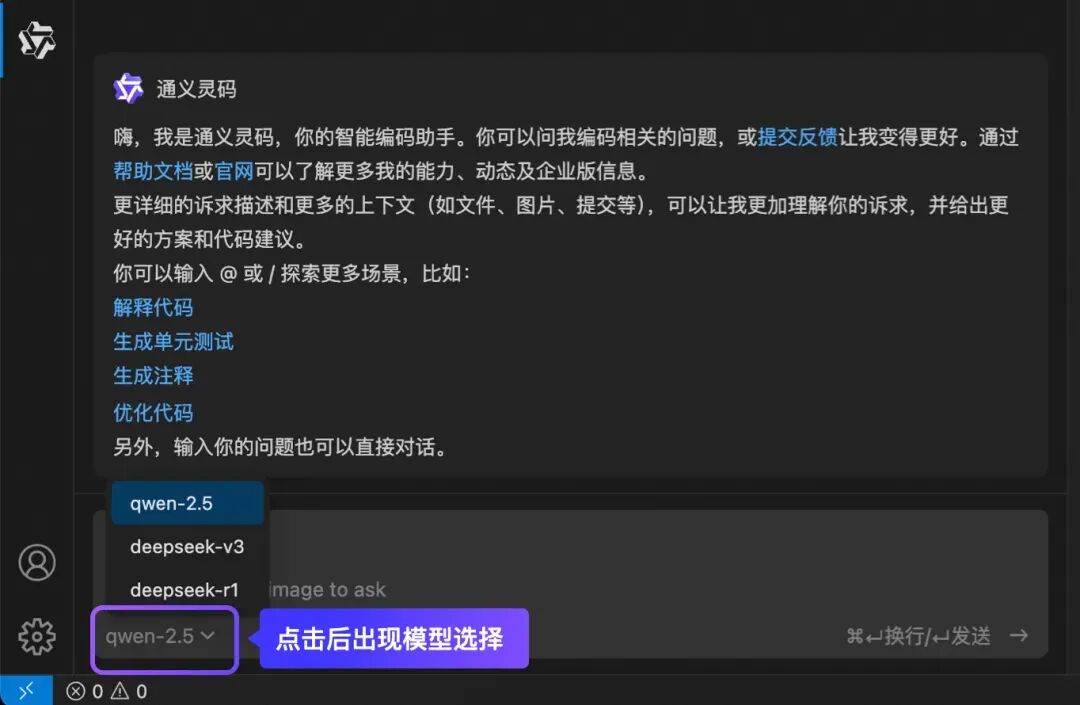

如何在通义灵码里用上 DeepSeek-V3 和 DeepSeek-R1 满血版 671B 模型?

通义灵码是阿里云与通义实验室联合打造的智能编码辅助工具,基于通义大模型技术,为开发者提供多种编程辅助功能。它支持多种编程语言,包括 Java、Python、Go、TypeScript、JavaScript、C/C++、PHP、C#、Ruby 等 200 多种编码语言。近期,阿里云百炼平台重磅推出 DeepSeek-V3、DeepSeek-R1、DeepSeek-R1-Distill-Qwen-32…- 0

- 0

-

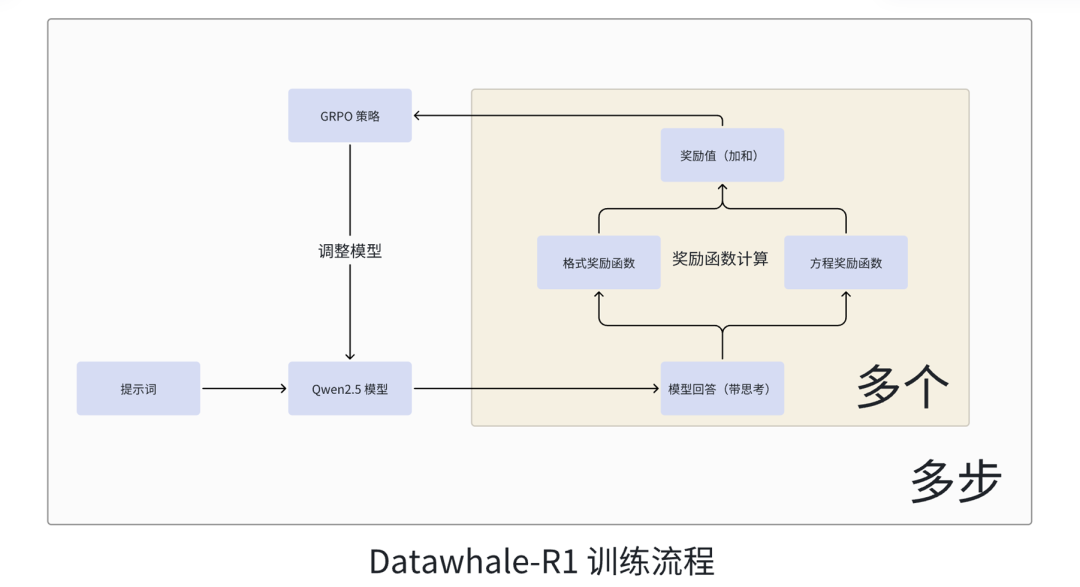

单卡复现 DeepSeek R1 Zero教程来了!

之前有同学问:主播主播,你们团队的复现的 R1 Zero 确实很强,但是还是太耗算力资源,没 3 张 A800 啊,还有没有更经济更简单的方式来学习 R1 Zero 的复现呢? 有的,兄弟,有的有的,像这样的方案还有九个(开玩笑)。今天我们来介绍一个有趣的方法,能够让你在单卡复现 DeepSeek R1 Zero,甚至只用一块 4090 显卡也能轻松实现! 为什么单卡就能复现?你可能会问…- 0

- 0

-

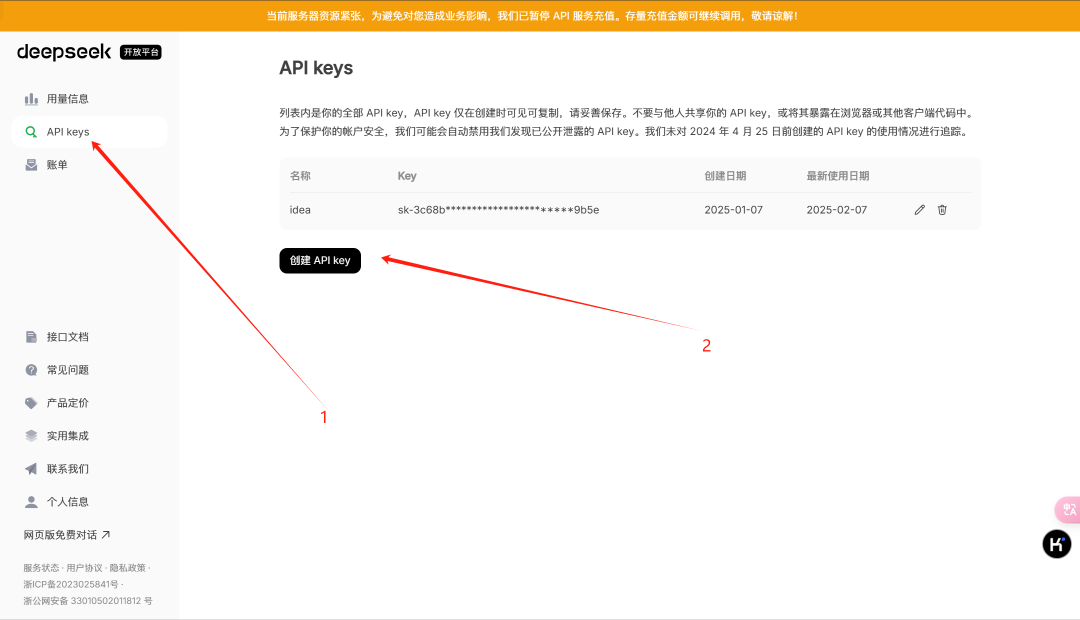

申请API-KEY,通过接口使用DeepSeek服务

-正文-一般大家使用语言模型都是一个直接可用的聊天界面,而 API Key 允许开发者将 GPT 模型集成到自己的应用、网站或服务中,比如:智能客服系统自动化办公工具AI 生成内容(如文章、代码)一些依赖大模型的工具,如“沉浸式翻译”相关阅读:只需一键,翻译从繁琐到简单,AI翻译沉浸式体验竟能如此轻松!API Key(应用程序编程接口密钥)是一串独特的密钥,用于验证用户或应用程…- 0

- 0

-

DeepSeek零门槛三步极速部署指南,注册秒过,对话零延迟!

最新数据,DeepSeek 上线 19 天,日活达到 1909 万。已经超过 ChatGPT,成为全球增速最快的 AI 应用。在后台留言看到,很多家人还是没能体验上 DeepSeek。前几天我写过一篇替代方案,但现在有了更稳定、更高速的方案。欧巴实测成功后立马来分享给大家,只需 3 步,零门槛部署,非常简单。这套方案的背后是经过华为云、硅基流动以及 DeepSeek 三个团队多日来的加班攻坚,创造…- 0

- 0

-

大模型应用部署过程中流量管控的常见需求和应对方案

01背景目前,和 DeepSeek 相关的需求总结为两类:因官方 APP/Web 服务经常无法返回结果,各类云厂商、硬件或软件企业提供满血版或蒸馏版的 API + 算力服务,还有不少基于开源+家用计算和存储设备的本地部署方案,以分担 DeepSeek 官方的服务压力。各行各业开始调用 DeepSeek API 来设计大模型应用,服务于企业内外部,关注应用的构建效率和稳定性。此前,我们已…- 0

- 0

-

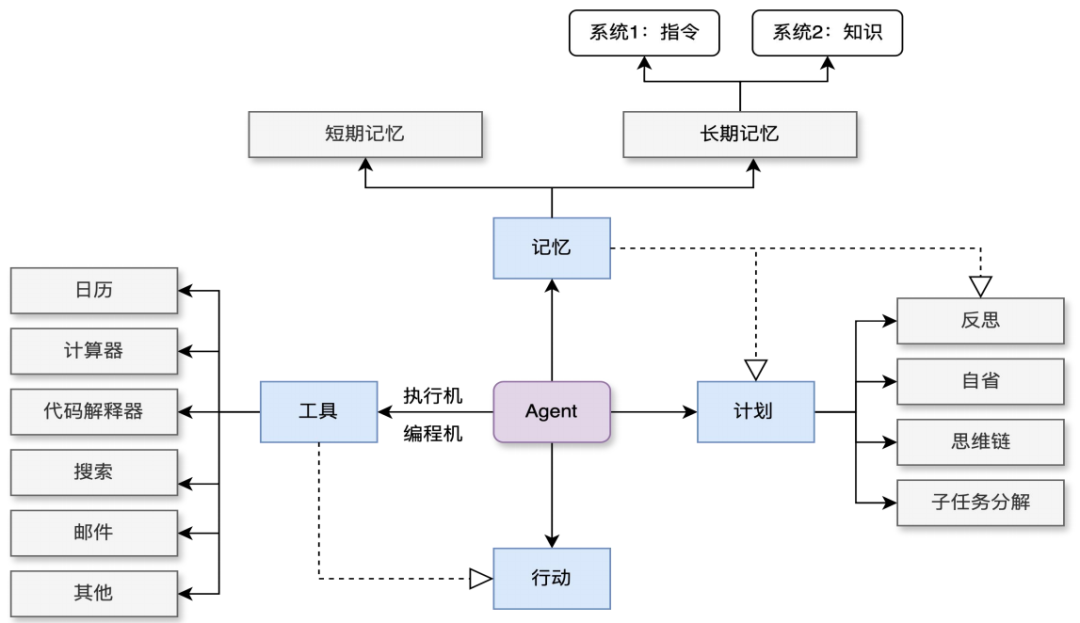

AI应用开发先了解这些概念:智能体、LLM、RAG、提示词工程

什么是智能体 (Agent) 一种基于LLM(LargeLanguage Model)的能够感知环境、做出决策并执行行动以实现特定目标的自主系统。与传统人工智能不同,Al Agent 模仿人类行为模式解决问题,通过独立思考和调用工具逐步完成给定目标,实现自主操作。通用智能体平台 以Agent为核心技术驱动,构建通用智能体平台,通过在智能体感知、记…- 0

- 0

-

腾讯云TI平台和HAI部署DeepSeek的步骤及其区别

腾讯云作为国内领先的云服务提供商,提供了TI平台和HAI平台两大工具,帮助开发者轻松部署和使用DeepSeek模型。本文将详细介绍在这两个平台上部署DeepSeek的步骤,并探讨它们的使用区别。一、腾讯云TI平台部署DeepSeek腾讯云TI平台是一个综合性的AI开发和管理平台,提供了从数据处理、模型训练到模型部署的全方位服务。以下是在TI平台上部署DeepSeek模型的详细步骤:1. 注册并登录…- 0

- 0

-

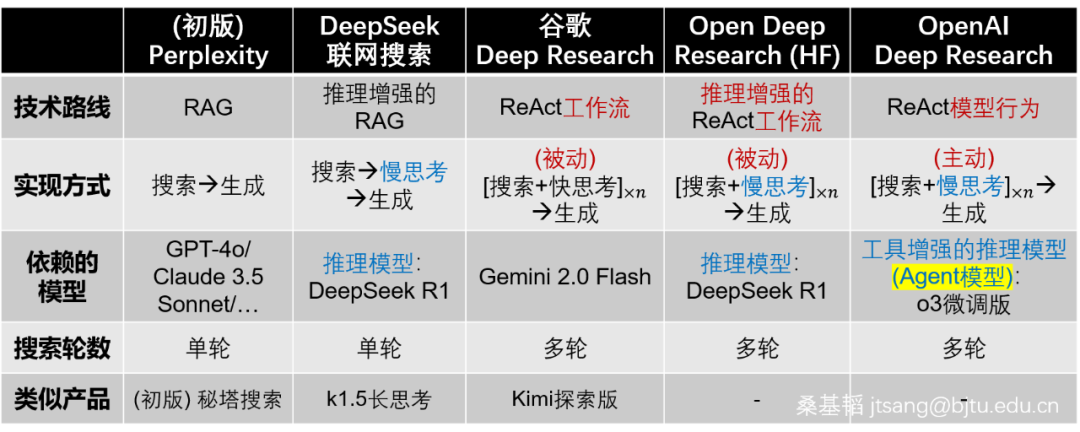

Chain-of-Action (行动链):从Agent工作流到Agent模型

OpenAI的Deep Research功能推出后,开源社区出现了很多复现工作。比较有代表性的Hugging Face官方的Open DeepResearch,通过代码规划行动步骤,实现了思考(thought)和行动(action)交互的ReAct工作流。它同时支持后台接入系统一模型(如DeepSeek-V3)和系统二推理模型(如DeepSeek-R1)。将之前总结的表格作更新。要注意的是,表中第…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!