-

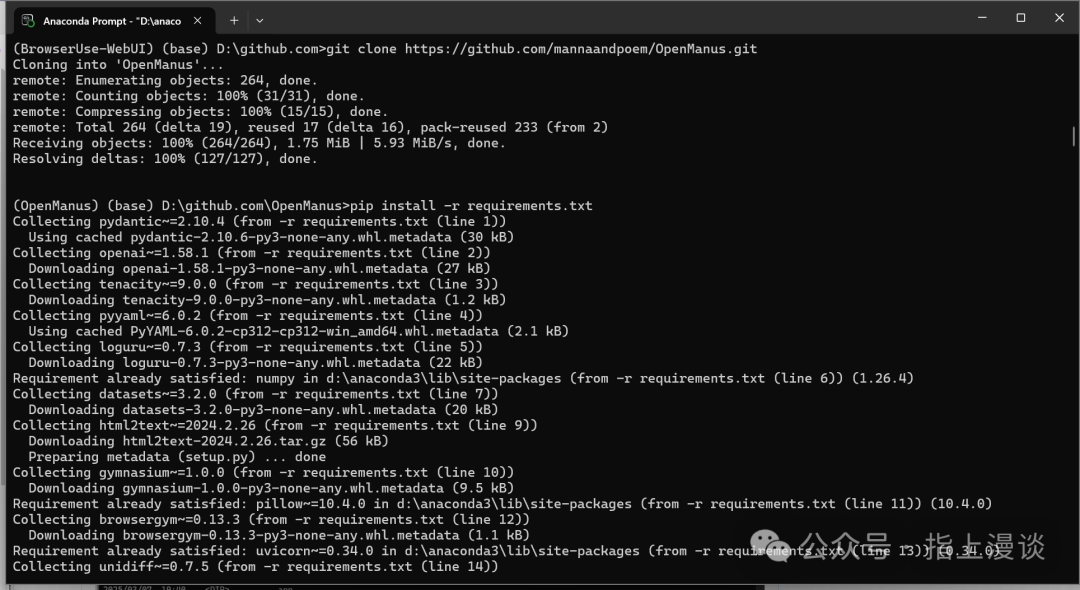

Windows下0到1成功安装OpenManus体验社区版Manus

下载源码git clone https://github.com/mannaandpoem/OpenManus.git创建Python虚拟环境 第一次顺着 browser use web ui 项目用 uv 命令创建,安装依赖包时提示有冲突。 第二次按官方用 …- 0

- 0

-

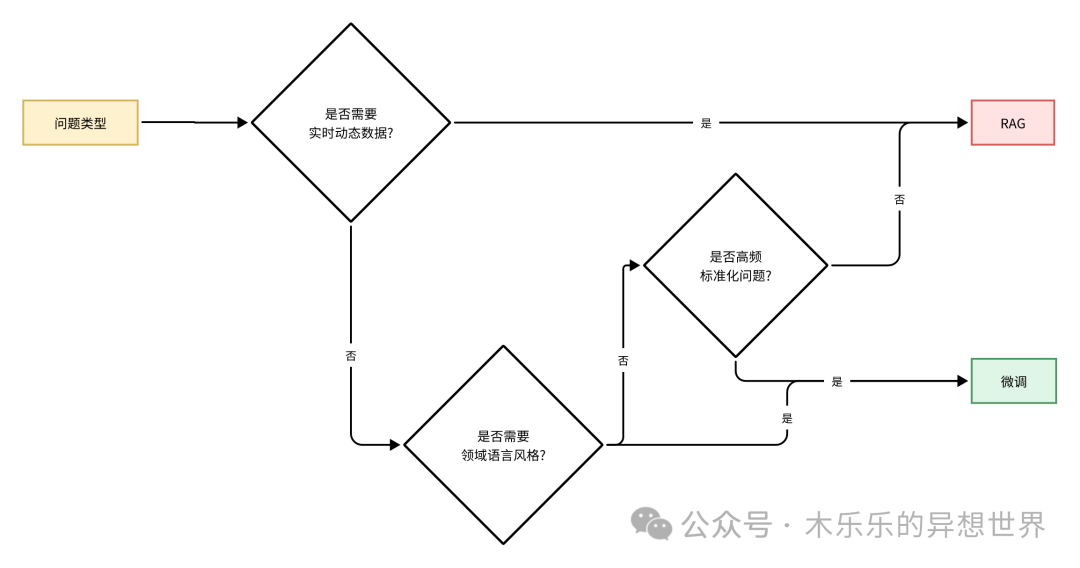

汽车行业智能助手开发:模型微调 vs RAG技术的优缺点对比

“在大模型智能助手开发中,选择合适的技术路径至关重要。 面对模型微调与RAG(Retrieval-Augmented Generation)技术这两种主流方法,你是否正在为它们的优缺点而犹豫不决?” 本文将深入分析两种技术的核心特点、适用场景及其潜在挑战,帮助你在实际应用中做出明智的选择。无论你是开发者、数据科学家还是技术决策者,这篇文章都将为你提供实用的见解,助你在汽车智能化浪潮中抢占先机。 …- 0

- 0

-

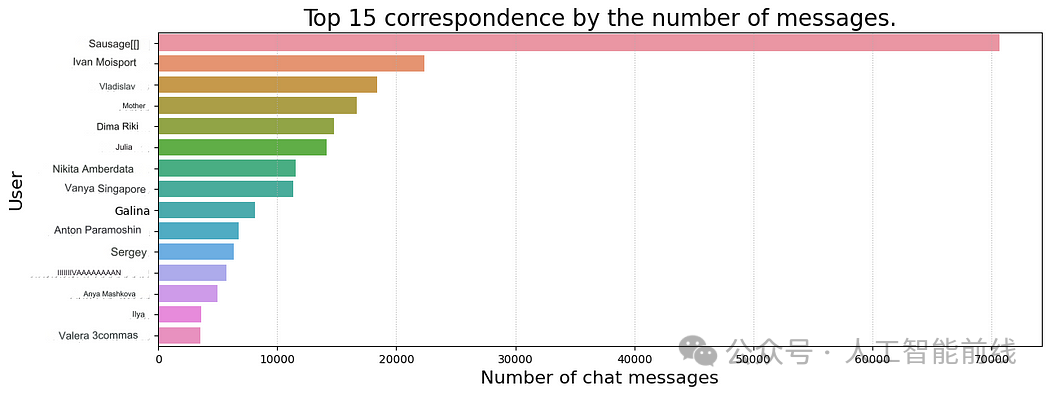

通过微调大模型克隆一个你自己:释放你的数字孪生体

本文旨在阐述如何在自定义数据集上高效且经济地微调一个性能卓越的大语言模型。我们将探索如何使用 Lit-GPT,结合 LoRA 适配器来运用 Falcon-7B 模型。你是否曾想过拥有一个数字孪生体会是什么样的呢?一个能与人交谈、学习,甚至能反映你想法的虚拟的自己?人工智能(AI)领域的最新进展让这个曾经看似只存在于未来的想法变为了现实。人工智能社区的努力促成了许多高质量开源大语言模型的开发,其中包…- 0

- 0

-

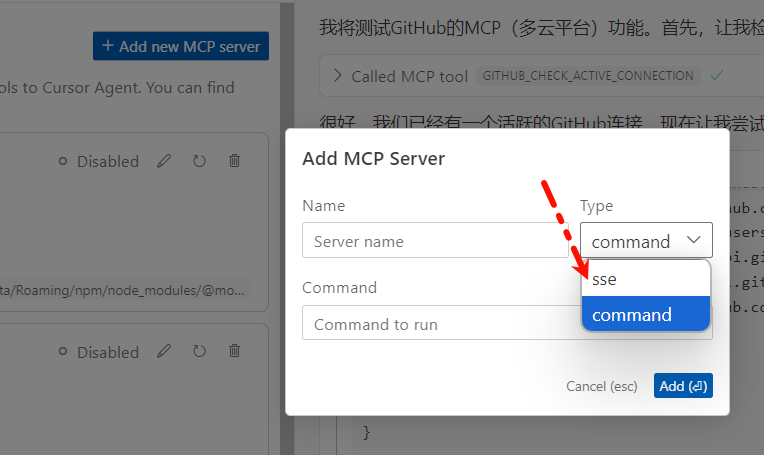

最新MCP托管平台:让Cursor秒变数据库专家,一键对接Github,开发效率暴增!

我们今天介绍一个MCP托管服务平台 —— Composio。什么东西?还记得配置MCP的两种方式之一的sse吗?不了解的话请看下图:是的,Composio 就是一个最新的MCP托管服务商。他给你提供一个链接,输进去之后你的MCP就配置好了。所以通过这种方式,我们今天来演示三个实用的MCP工具,分别是:Github、Supbase、Neon。先说说这两个数据库MCP —— Supbase、…- 0

- 0

-

消费级显卡微调工业级大模型!仅需20G显存,QwQ-32B高效微调实战!

一、DeepSeek R1低成本本地部署方案介绍1. KTransformer与Unsloth动态量化方案介绍截至目前,DeepSeek R1模型本地部署最具性价比的方案就是清华大学团队提出的KTransformer方案和Unsloth动态量化方案,两套方案都是借助CPU+GPU混合推理,来降低GPU购买的硬件成本,并且底层CPU推理实现也都是基于llama.cpp。· ktransfo…- 0

- 0

-

基于 mcphost 的智能体开发实战指南

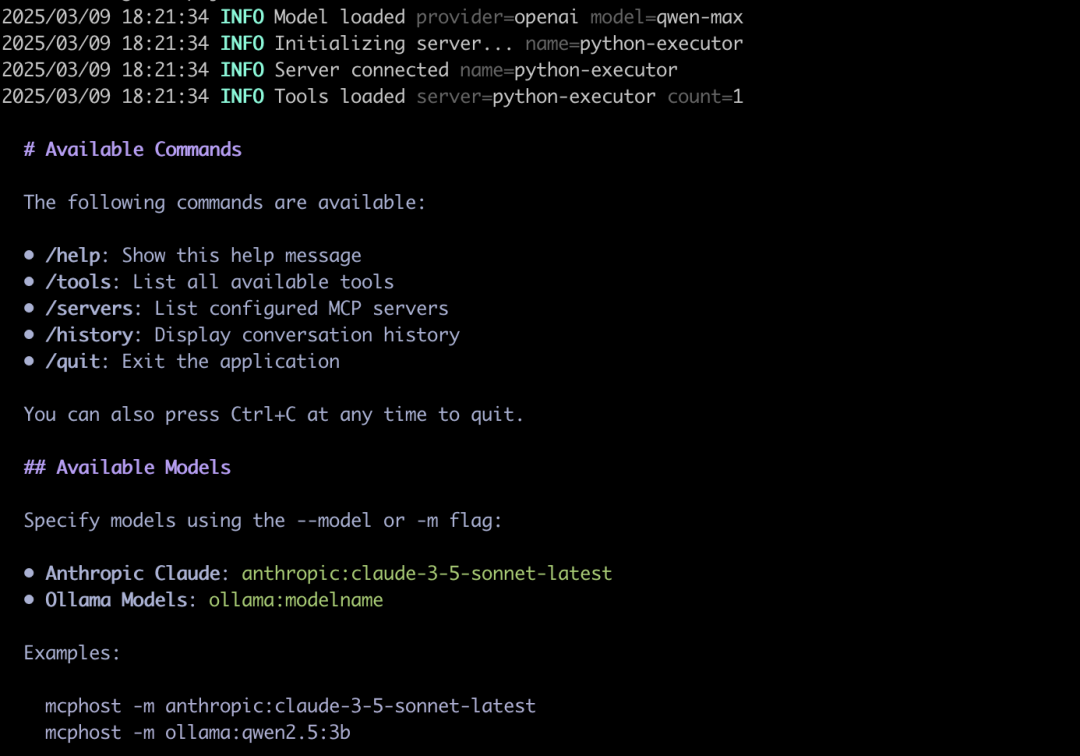

在 MCP Server 开发调试过程中,除了图形化工具 MCP Host,我更推荐使用轻量化CLI工具 mcphost(项目地址:mark3labs/mcphost)。这款仅 5MB 的零依赖工具支持 Anthropic、Ollama、OpenAI 三大模型平台,为开发者提供灵活的选择。配置和基本使用例如我这里使用阿里的千问大模型,其命令大致为export OPENAI_API_KEY…- 0

- 0

-

谷歌Gemma 3 27b 到底能不能打,写个游戏测试下?

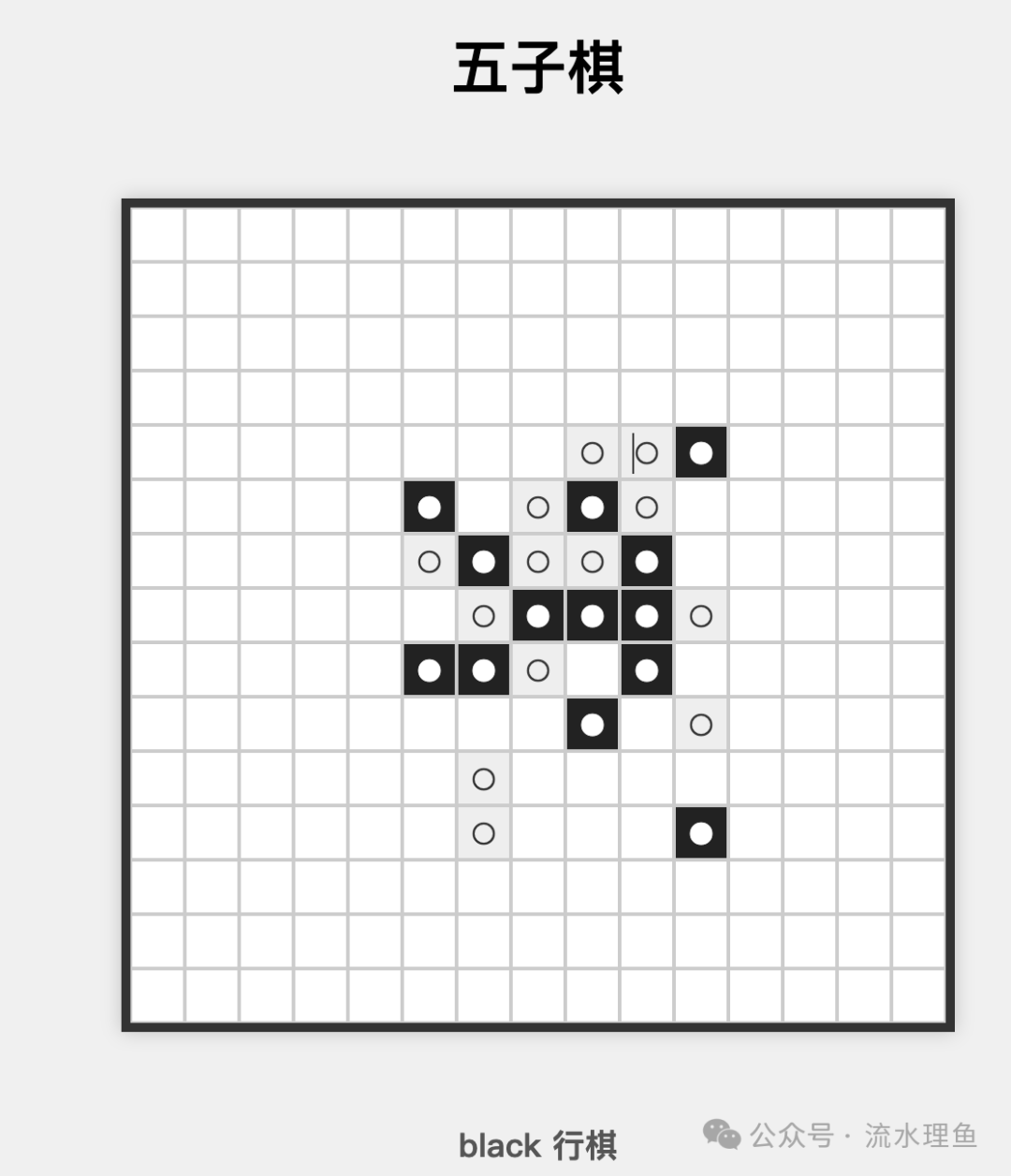

27b大小的模型是用户端侧的重点战场。 前有deepseek-r1的千问量化,后有 qwq 32b。今天又有gemma3考虑到咱们程序员体质,那么必须安排编程考题。题目就编写五子棋网页游戏模型参数Gemma 3 有不同的规模可供选择,分别是 10 亿参数(1B)、40 亿参数(4B)、120 亿参数(12B)和 270 亿参数(27B)。项目地址:https://ollama.com/librar…- 0

- 0

-

强化学习(RL)是什么? 它和微调有什么区别?

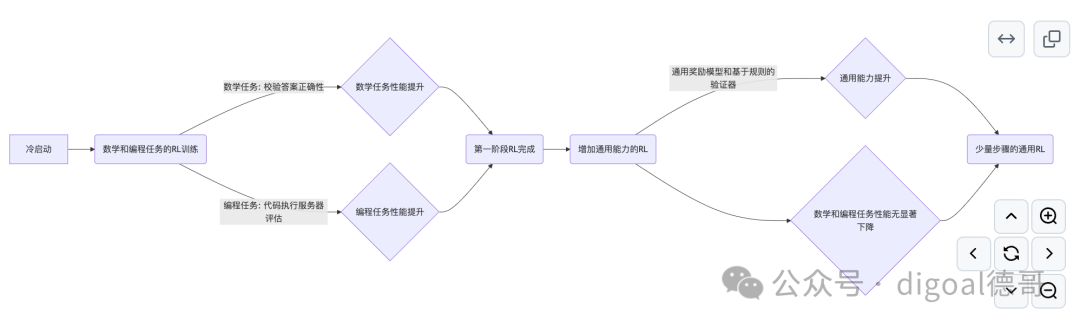

QwQ 32B打平DeepSeek-R1 671B的关键技术: 强化学习(RL)是什么? 它和微调有什么区别?QwQ开源的32b版本, 从效果数据来看, 仅用20分之一的参数就追平了DeepSeek-R1 671B. 从其官网发布的消息, 背后的关键可能是强化学习.https://qwenlm.github.io/zh/blog/qwq-32b/以下是原文:大规模强化学习(RL)有潜力超越传统的预…- 0

- 0

-

一体机,阻碍DeepSeek性能的最大绊脚石!

一体机是DeepSeek交付的最佳方式吗?恰恰相反,一体机是阻碍DeepSeek提升推理性能的最大绊脚石。为啥?只因DeepSeek这个模型有点特殊,它是个高稀疏度的MoE模型。MoE这种混合专家模型,设计的初衷是通过“激活一堆专家中的少量专家”,来达到减少计算量、提升推理效率的目标。举个例子,MoE模型好比是一个超级大饭店的后厨,这个后厨里有几百个大厨,每个大厨擅长做不同菜系川菜厨子、鲁菜厨子、…- 0

- 0

-

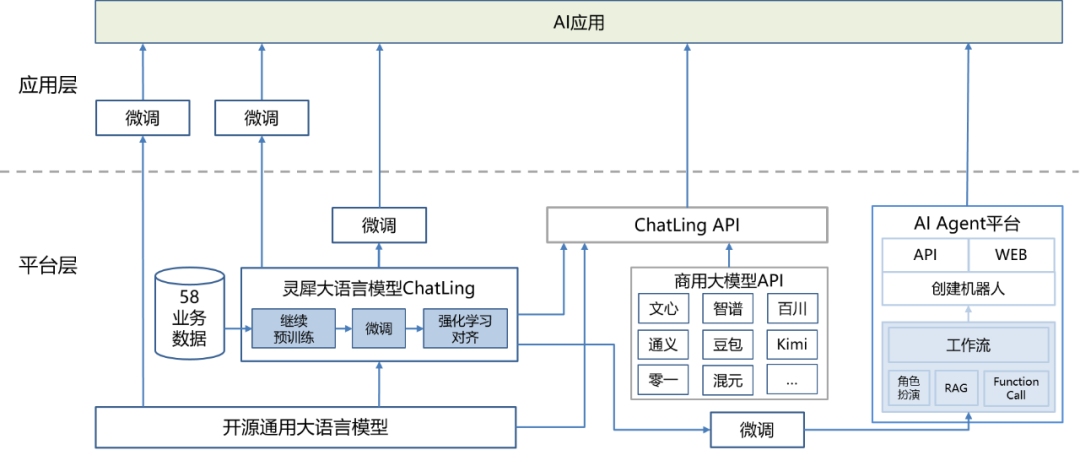

大模型参数高效微调(PEFT)技术解析及微调加速实践

2023年,大模型如雨后春笋般爆发,58同城TEG-AI Lab作为AI平台部门,紧跟大语言模型技术发展步伐,打造了大语言模型平台,支持大语言模型训练和推理部署,并基于大语言模型平台构建了58同城生活服务领域(房产、招聘、汽车、黄页)垂类大模型灵犀大语言模型(ChatLing),支撑了业务方大模型应用的探索落地。灵犀大语言模型在公开评测集和实际应用场景下,效果均优于开源通用大语言模型以及商用通用大…- 0

- 0

-

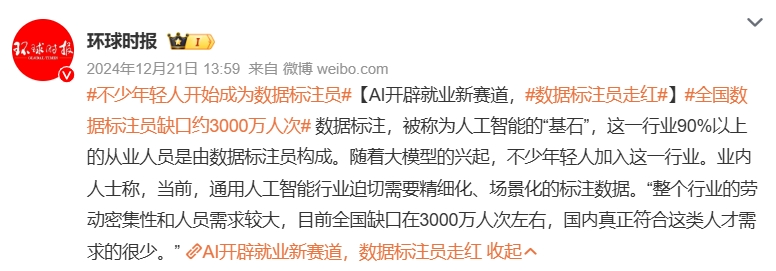

我在县城“驯化”AI:有多少“人工”才有多少“智能”

“人工智能并不像大多数人希望的或害怕的那样聪明,它对世界的渊博知识必须靠人类补充。”这是一位美国人类学家在《幽灵工作》一书中说的,网友也给了这句学术描述一个很直白的翻译,“人工智能,有多少智能就有多少人工。”GPT刚火的时候大家在讨论的是自己的工作还保不保得住,到现在,大家讨论的是,因AI创造的工作自己能不能去做。人工智能爆火三年,从企业到人才市场都发生了趋势性的变化。种种变化也给一些职场人带来了…- 0

- 0

-

用极小模型复现R1思维链的失败感悟

前言投完ICML之后火急火燎的入门RL,花了一些时间把RLHF学了。后来在知乎上看到了很多优秀的开源R1复现项目,于是手痒痒啃了下比较火的两个开源项目准备自己实践一下,一个是Huggingface的Open-R1,一个是Logic-RL。由于Logic-RL基于Verl,模型推理和训练过程都是shard到不同显卡上的,Huggingface的GRPOTrainer是单独用一张显卡做vllm推理,所…- 0

- 0

-

使用vLLM部署工具加速QWQ,推理速度比ollama更快、并发更高

与传统的HuggingFace Transformers相比,vLLM的吞吐量高达24倍,且无需改变模型架构,它采用创新的PagedAttention算法,优化了注意力键和值的管理,从而提升了推理速度,并且其能够有效地利用多核CPU和GPU资源,显著提升LLM的推理速度。相比于ollama,vllm输出的速度更快,支持的并发更高,目前也没有遇到安全问题,稳定性非常好,更适合作为服务器的接口服务来部…- 0

- 0

-

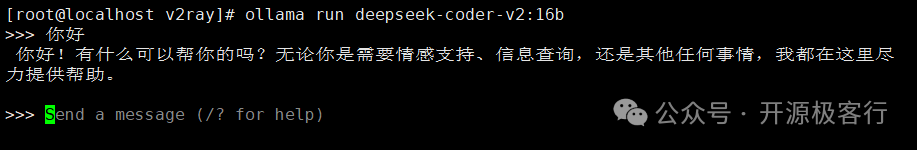

企业级私有化部署:基于 Ollama 实现 DeepSeek 大模型

引言在当今数据驱动的时代,企业对于数据安全和隐私保护的需求日益增长。为了满足这一需求,越来越多的企业选择将大模型私有化部署在本地环境中,以确保数据的安全性和可控性。本文将详细介绍如何基于Ollama实现DeepSeek大模型的本地化部署,帮助企业构建一个安全、高效的大模型应用环境1. 为什么选择私有化部署?1.1 数据安全 私有化部署确保所有数据都在企业内部网络中处理,避免了数据外泄的风…- 0

- 0

-

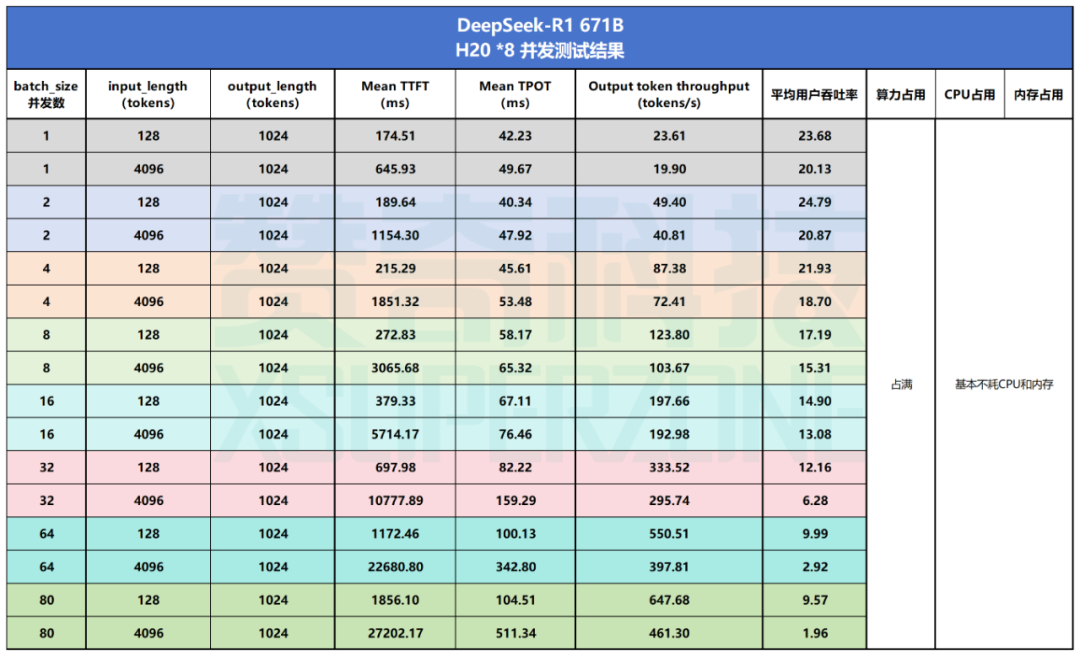

DeepSeek 满血版 8卡 H20 141GB 并发压力测试,体验极致性能!

前段时间技术同事完成了对中小模型的测试验证。分别测试了 RTX 5000 Ada和RTX 5880 Ada 显卡运行 DeepSeek 7B/14B/32B 等模型的并发性能与部署效率。近期我们针对 DeepSeek 满血版 671B 进行了并发性能的测试,搭载的是 8张 NVIDIA H20(单卡显存141GB)的服务器,我们…- 0

- 0

-

Cursor 新版本要来了!释放Claude 3.7全部潜力,估值百亿引热议,前Apple工程师:招人要会用AI。

Cursor v0.47要给Sonnet 3.7带来升级。本周,Cursor 团队成员 Eric Zakariasson表示:新版本让AI能处理更复杂的任务,支持长时间工作和深度思考。并释放模型 3.7 的全部潜力,优化了异步工作模式,更适合任务委托。编程任务有两种模式:自己动手的同步工作,委托给AI的异步工作。早期Cursor针对同步工作优化。但3.7模型会带来更强的异步能力,原有工作…- 0

- 0

-

vLLM 私有化部署满血版 DeepSeek-R1-671B 模型

服务器环境准备硬件配置:16 * H800,多机多卡,bfloat16 + FP8量化的混合精度推理,输出效率3秒/1token。安装Miniconda下载 Miniconda 安装脚本打开终端,使用 wget 命令下载最新版本的 Miniconda 安装脚本:wget https://repo.anaconda.com/miniconda/Miniconda3-la…- 0

- 0

-

从DeepSeek到Manus:如何实现本地LLM微调+联网开发?

目录1 LLaMA-Factory本地大模型微调2 本地大模型联网功能开发3 业务场景探索4 未来展望与实践建议从 ChatGPT 到 DeepSeek 再到最近大热的 Manus,AI 技术从模型端的破圈进一步扩展到了 Agent 方向。拥有一个定制化的、能够理解你业务需求的 AI 助手不再是科幻,而是触手可及的现实。然而,市面上的通用大模型往往难以深入理解特定领域知识,更不用说完全掌控数据隐私…- 0

- 0

-

从零开始的DeepSeek微调训练实战(SFT)

前言本文重点介绍使用微调框架unsloth,围绕DeepSeek R1 Distill 7B模型进行高效微调,并介绍用于推理大模型高效微调的COT数据集的创建和使用方法,并在一个medical-o1-reasoning-SFT数据集上完成高效微调实战,并最终达到问答风格优化&知识灌注目的。你能收获什么:亲手完成DeepSeek R1蒸馏模型的微调实战对模型微调、推理数据集等知识有一定了解对…- 0

- 0

-

DeepSeek-R1 671B + KTransformer部署服务器配置&万元复现方案

一、Inter平台1,四代/五代处理器 + DDR5说明:4代/5代金牌处理器 + DDR5内存,跑deepseek-r1 671b Q4可达13+tps,输出体验已经很丝滑了,土豪选择2,三代处理器及以下 + DDR4说明:3代处理器 + DDR4内存,跑deepseek-r1 671b Q2.51实测速度可稳定 7.5~8tps,e5处理器也可以跑出5~6tps还是比较意外# 万元以下配置参考…- 0

- 0

-

Ollama之服务监测程序

Ollama之服务监测程序背景描述最近deepseek-r1大火,有个业务系统,需要在本地接入deepseek-r1,这位客户私有化部署的需求,同时闲置了一张3090卡。给他用Ollma拉取deepseek-r1:32b的模型。一开始都很顺利,谁知道,服务运行一段时间,就莫名奇妙卡死了,试了很多种方法,仍然没找到原因,所以就写了如下的监测程序监控服务,原理很简单,就是定时调用Ollam…- 0

- 0

-

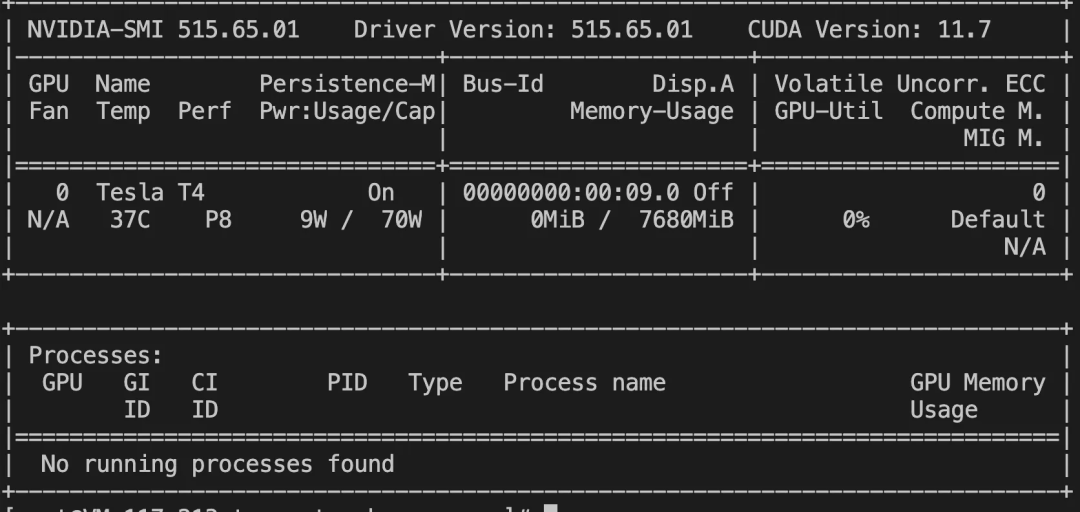

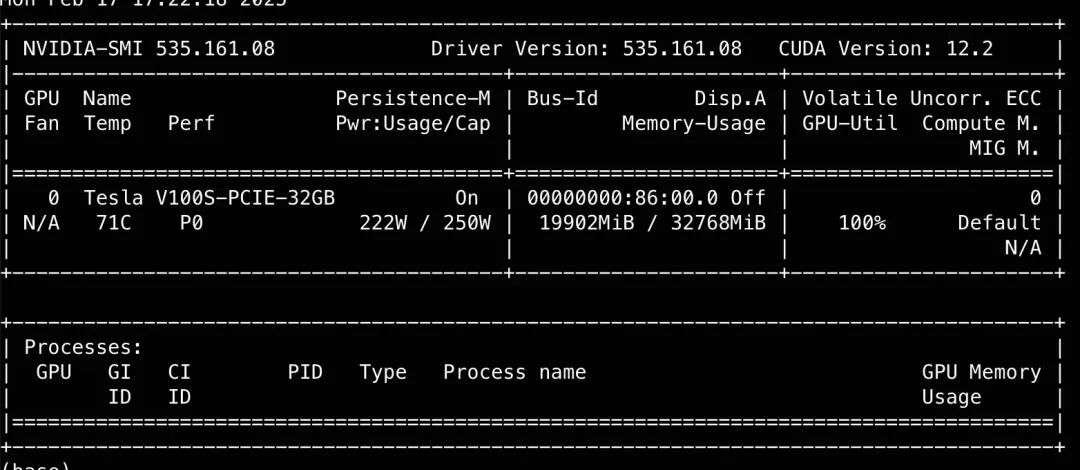

「古董」GPU也能跑DeepSeek同款GRPO!显存只需1/10,上下文爆涨10倍

开源微调神器Unsloth带着黑科技又来了:上次更新把GRPO需要的内存见到了7GB,这次只需要5GB的VRAM,就能训练自己的推理模型Qwen2.5(1.5B),比上次要少2GB。这次彻底把推理模型训练显存打下来了!这次把GRPO训练推理模型的上下文变长10倍,同时需要的显存少了90%。使用最新的Unsloth,只要5GB显存就能训练自己的推理模型,而且Qwen2.5-1.5B不会损失准确率。5…- 0

- 0

-

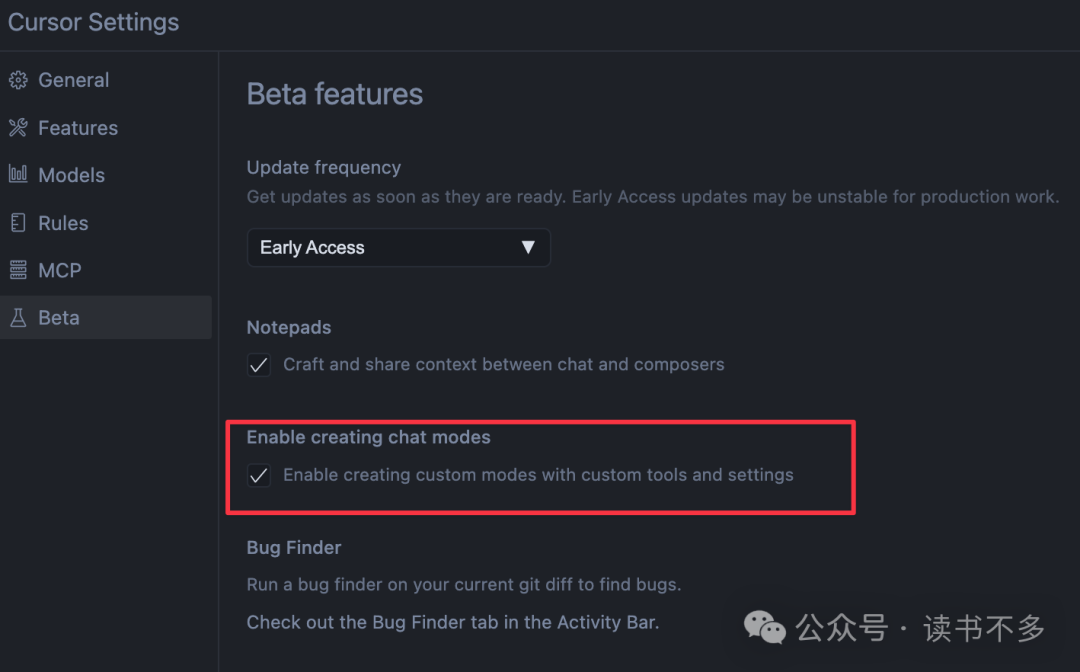

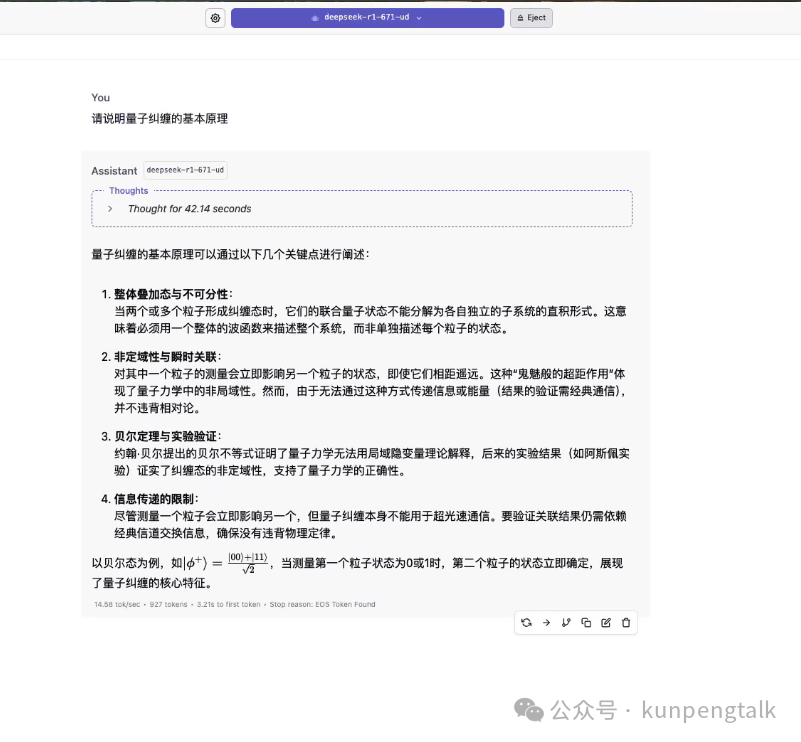

Cursor 0.47 自定义 Agent 来了

最大的改进 自定义 AgentCursor Setting - Beta 中 增加了选项: 启用带有自定义工具和设置的自定义模式。比较绕口,这里可以看图:当你勾上了这个模式之后,能够看到区别是增加一个设置选项:Add custom mode当你选择添加自定义模式的时候,可以添加的功能有很多:自定义图标,模式的名称,模式的快捷键自定义模型,可以设置自动选择,也可以选择某个模型。这里只是切…- 0

- 0

-

基于 Apple Silicon 架构的Mac部署DeepSeek-R1-671B 模型本地化指南

本文针对大语言模型本地部署的显存瓶颈问题,提出基于 Apple Silicon 芯片的创新型解决方案。通过量化压缩与内存优化技术,实现在配备 192GB 统一内存的 M2 Ultra 设备上完整运行 670 亿参数 DeepSeek-r1 模型。相较传统 GPU 集群方案,本方案在保持 90%以上模型性能的前提下,将硬件成本降低两个数量级。 先来看看全参数 DeepSeek-R1-671B 模型本…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!