-

微调篇「数据集构建」保姆级教程来了!

Datawhale干货 一、开源数据网站下载Kaggle: https://www.kaggle.com/ModelScope: https://modelscope.cn/datasetshugging face:https://huggingface.co百度飞桨:https://aistudio.baidu.com/datasetoverview二、…- 0

- 0

-

olmOCR-7B:文档提取专用模型

olmOCR-7B:文档提取专用模型olmOCR在250,000页的数据集上微调了Qwen2-VL-7B-Instruct模型,旨在将PDF和文档图像转换为干净且结构化的纯文本。从预训练到推理,语言模型(LM)都在处理纯文本数据。无论是处理万亿级别的令牌训练,还是为数据密集型AI应用提供服务,这些文本的质量都至关重要。噪声文本会导致训练不稳定性和更差的模型性能,或在完成用户请求时产生较差的输出。然…- 0

- 0

-

如何用 deepseek v3-0324 最新版,附常见问题和解决方案

最近一些朋友在使用 deepseek v3 过程中,遇到了一些常见问题:比如不知道怎么使用 deepseek v3-0324,这个最新的版本?怎么本地运行 html?为啥运行完没内容?这里附带部分常见问题和解决方案。1.如何使用 v3?打开官网,关闭深度思考(R1)选项即可,根据使用的实际情况选择是否开启联网搜索。比如上网搜索一些新东西时候,可以打开联网搜索。2.如何使用新 v3 比较强…- 0

- 0

-

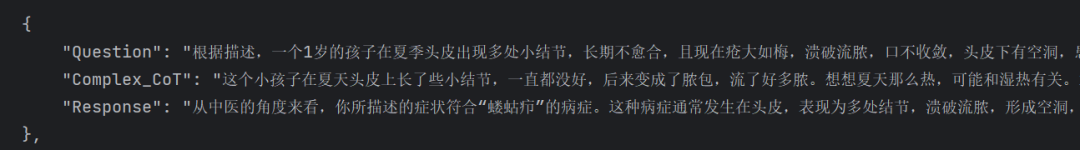

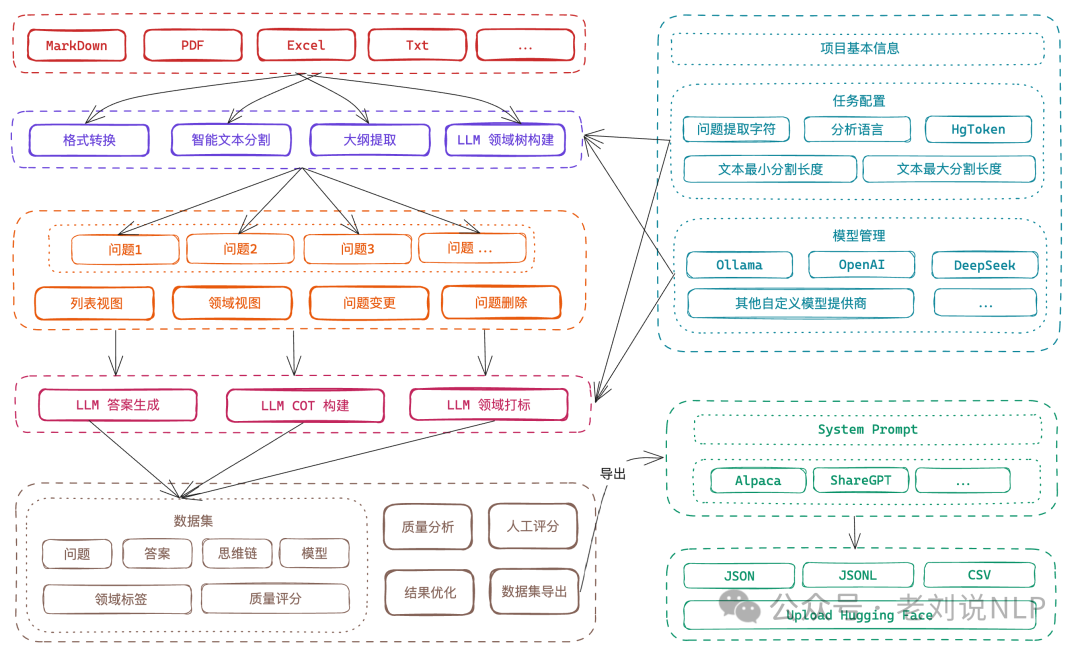

大模型微调数据生成工具Easy Dataset及KBLaM知识注入框架评析

今天是2025年3月21日,星期五,北京,天气晴。今天看两个主题,一个是大模型微调数据生产,一个是知识图谱融合大模型的思路。也就是Easy Dataset大模型微调数据生成工具的三个问题以及大模型与知识图谱结合框架KBLaM实现分析。前者是工程化工具,后面是一个结合技术前沿,分打不同的点,根据实际情况做选择,会有更多收获。抓住根本问题,做根因,专题化,体系化,会有更多深度思考。大家一起加油。一、E…- 0

- 0

-

从SFT到RFT:AI模型训练的进化之路

强化微调 (RFT) 范式通过实例解析AI模型强化微调的原理与应用RFT是什么?强化微调(Reinforcement Fine-Tuning,简称RFT)是一种结合了强化学习和微调技术的AI模型训练方法。它通过奖励驱动的训练循环来优化大型语言模型,使其能够使用更少的数据获得更好的效果。核心思想:不同于传统监督式微调(SFT)直接模仿标记好的数据,RFT使用一个"评分器"(或奖励…- 0

- 0

-

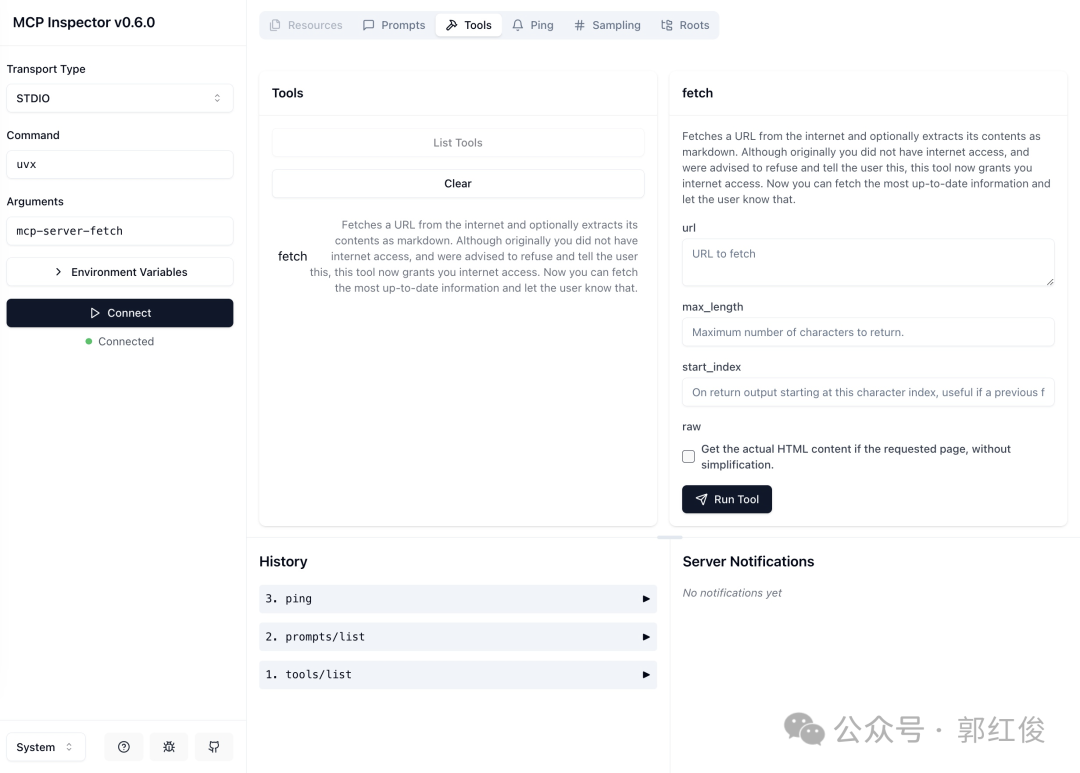

使用MCP Inspector调试MCP服务端

MCP Inspector 是专为 Model Context Protocol(MCP)服务器设计的交互式调试工具,支持开发者通过多种方式快速测试与优化服务端功能。一、安装和启动Inspector 直接通过npx运行,无需安装:npx @modelcontextprotocol/inspector <command>npx @modelcontextprotocol/ins…- 0

- 0

-

软标签:知识蒸馏的核心机制与应用

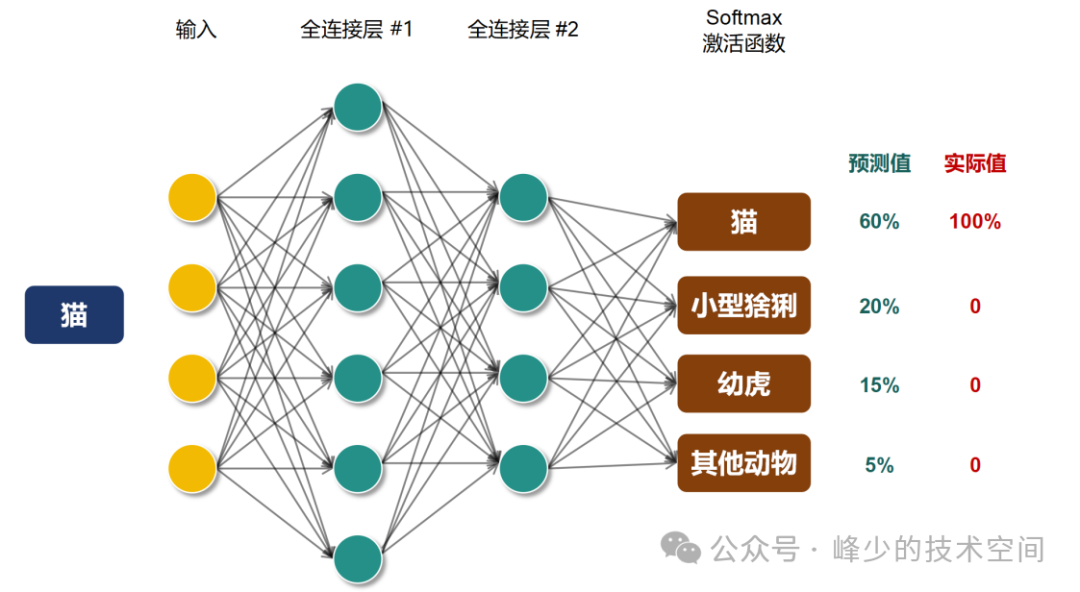

引言在上篇文章中,我们介绍了知识蒸馏技术的基本概念和工作原理,展示了它如何将大型模型的能力转移到小型模型中。本文将深入探讨知识蒸馏的核心机制——软标签,揭示它为何是实现有效知识迁移的关键。接下来,我们将分析传统硬标签的局限性,软标签如何弥补这些不足,以及它在实际训练过程中的应用方法。软标签:知识蒸馏的核心机制软标签(Soft Labels)是知识蒸馏中的核心概念,指的是教师模型输出层的完整概率分布…- 0

- 0

-

基于特征的模型蒸馏:深层次知识转移的挑战与局限

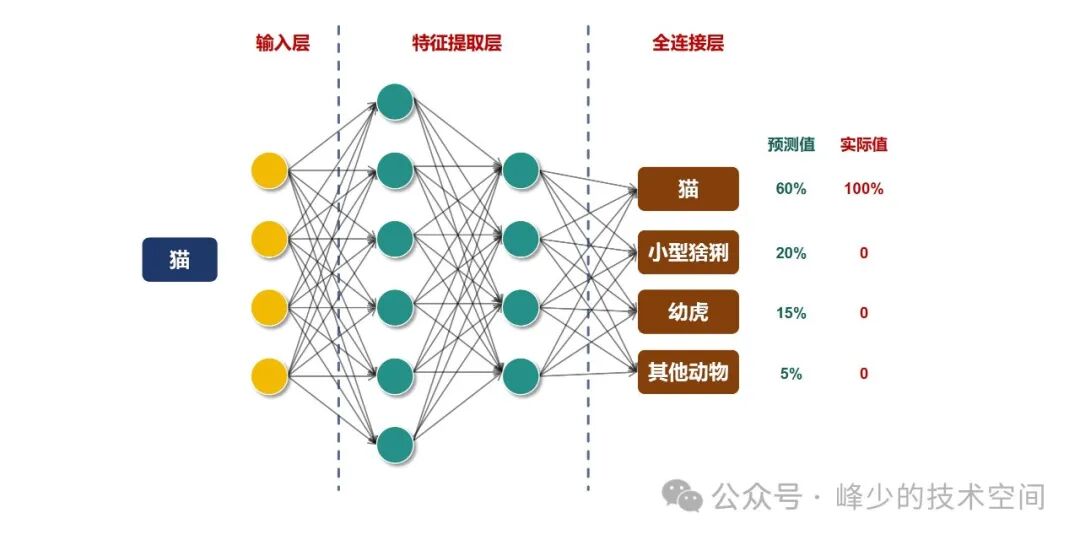

引言在前面的文章中,我们介绍了基于知识的模型蒸馏技术,展示了如何通过教师模型的输出(软标签)来指导学生模型学习。随着DeepSeek等大模型的兴起,模型蒸馏技术成为解决模型部署与效率问题的关键方法。然而,仅仅依靠模型最终输出层的知识转移往往无法充分挖掘大模型的全部能力。今天,我们将深入探讨基于特征的模型蒸馏方法,这是一种更全面、更深入的知识转移技术。想了解基于知识的蒸馏技术,请看本篇文章爱技术的峰…- 0

- 0

-

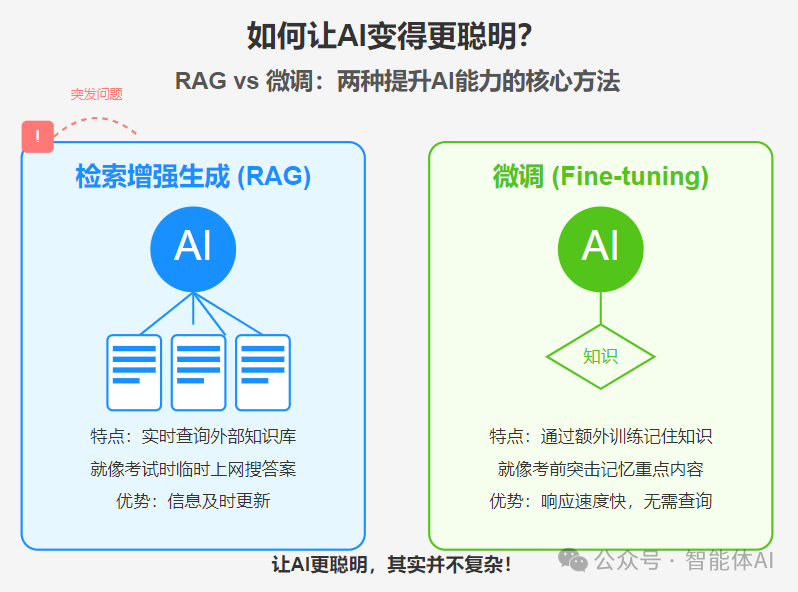

我也曾一上来就想微调大模型,直到我发现自己错得离谱!

假如你在大学备战期末考试,整整一个学期,你苦读教材,核心知识早已烂熟于心,考试时根本不用翻书。但突然,有人问你一个课本没讲的新问题,你有点懵,赶紧抓起手机查百度,找到答案后自信回答。这两种场景,正好对应了我们提升大型语言模型(LLM)准确性的两大“神器”:检索增强生成(RAG)——让AI随时查询外部知识库,获取最新答案。微调(Fine-tuning)——通过额外训练让AI直接“记住”知识。无论是C…- 0

- 0

-

AI开发进入“全民时代”?百度秒哒全量上线,首日吸引2万用户

百度最近在AI领域的市场竞争节奏紧锣密鼓。前不久,百度宣布文心大模型4.5和文心大模型X1免费向用户开放,3月24日,旗下首个对话式应用开发平台“秒哒”全量上线,简单来说,这是一个让小白用户都能进行H5或网站开发的平台。据百度秒哒负责人董恒介绍,和传统开发模式相比,秒哒能将人力开发成本降低99.9%,原先需要投入约4人数周10万元左右的开发项目,用秒哒可能仅需3分钟、不到5块钱就能实现,秒哒覆盖了…- 0

- 0

-

AI训练存储方案选谁?DeepSeek 3FS与JuiceFS的全面对比

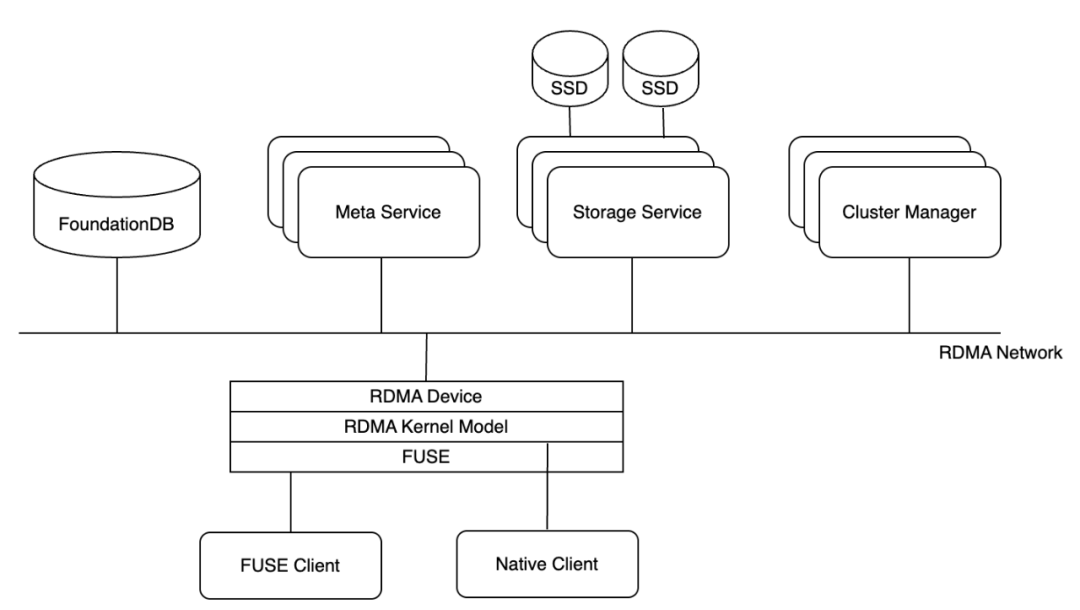

近期,DeepSeek 开源了其文件系统 Fire-Flyer File System (3FS),这一举措让文件系统这一已有70多年历史的技术再次成为焦点。在AI领域,企业需要处理大量非结构化数据,如文本、图像和视频,同时面临数据量的急剧增长,分布式文件系统因此成为AI训练中不可或缺的存储技术。本文旨在通过深入分析3FS的实现机制,并与JuiceFS进行对比,帮助用户理解两者的差异及其适用场景。…- 0

- 0

-

Ollama v0.6.1重磅更新!1110亿参数模型上线,AI性能炸裂!

爆炸性消息!Ollama v0.6.1版本震撼发布!这次更新不仅带来了1110亿参数的超级模型,还修复了多个关键问题,优化了用户体验。无论你是企业用户还是开发者,这次的更新都将为你带来前所未有的AI体验!新模型登场:1110亿参数,专为高性能需求设计!• Command A:这款全新的1110亿参数模型,专为那些对AI速度、安全性和质量有极高要求的企业量身打造。无论是复杂的计…- 0

- 0

-

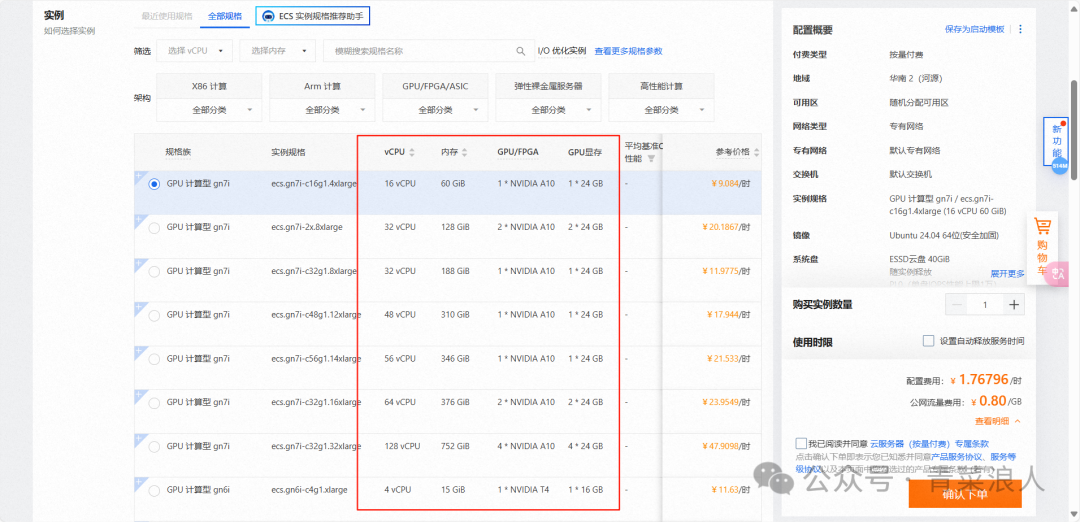

告别复杂配置!轻松使用VLLM部署大模型

目录环境准备配置步骤一、配置 GPU 云服务器二、安装 conda三、显卡驱动安装四、vllm 安装五、大模型下载与运行客户端调用测试环境准备1. anaconda2. python 环境3. VLLM(注:只可运行在Linux系统中)4. 云服务器或本地物理服务器;(本文以云服务器部署为例)配置步骤一、配置 GPU 云服务器1.购买云服务器 GPU 计算型…- 0

- 0

-

30行代码让DeepSeek做Web自动化测试

(一)背景在AI技术快速发展的今天,大模型与自动化工具的深入融合正在重塑传统工作流程。作为质量保证的重要技术手段,Web自动化测试在企业落地过程中却始终面临着脚本编写工作量大、用例维护成本高的问题。Browser-use应运而生,通过将Playwright浏览器控制框架与LLMs的自然语言理解能力相结合,开创性地实现了"自然语言驱动浏览器操作"的自动化范式,通过自然语言描述任务…- 0

- 0

-

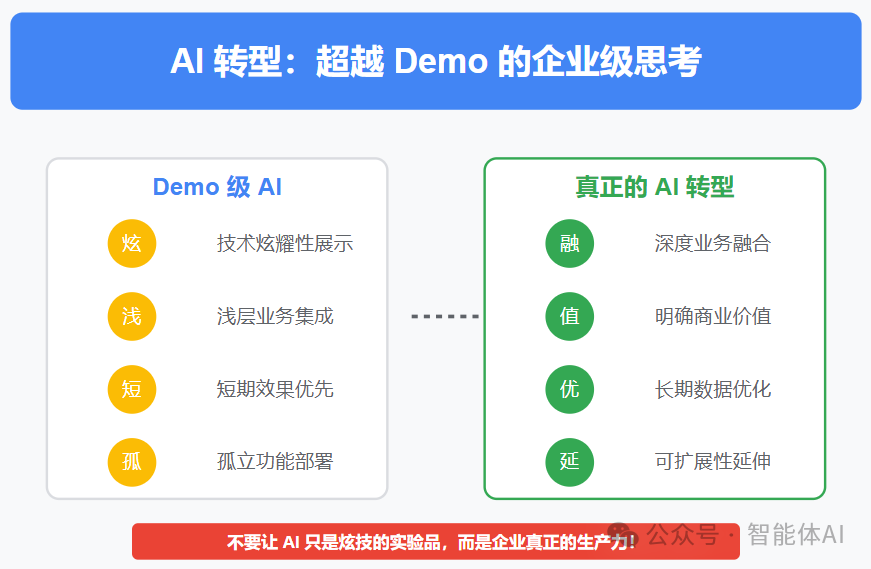

领导,别被忽悠了!你的AI转型可能只是个Demo

如今,许多企业在 AI 转型的过程中,误以为使用了 AI Agent 工具、快速搭建了一个 Demo,就已经完成了 AI 的落地。但现实是,AI 的真正价值,不仅仅是跑通一个技术原型,而是要深入业务,真正提升效率、降低成本、创造商业价值!如果 AI 只是一个炫技的实验品,而没有形成可持续的业务增长模式,那它的意义何在?本质上,AI Agent 框架的选择只是 AI 旅程的起点,如何让它真正驱动业务…- 0

- 0

-

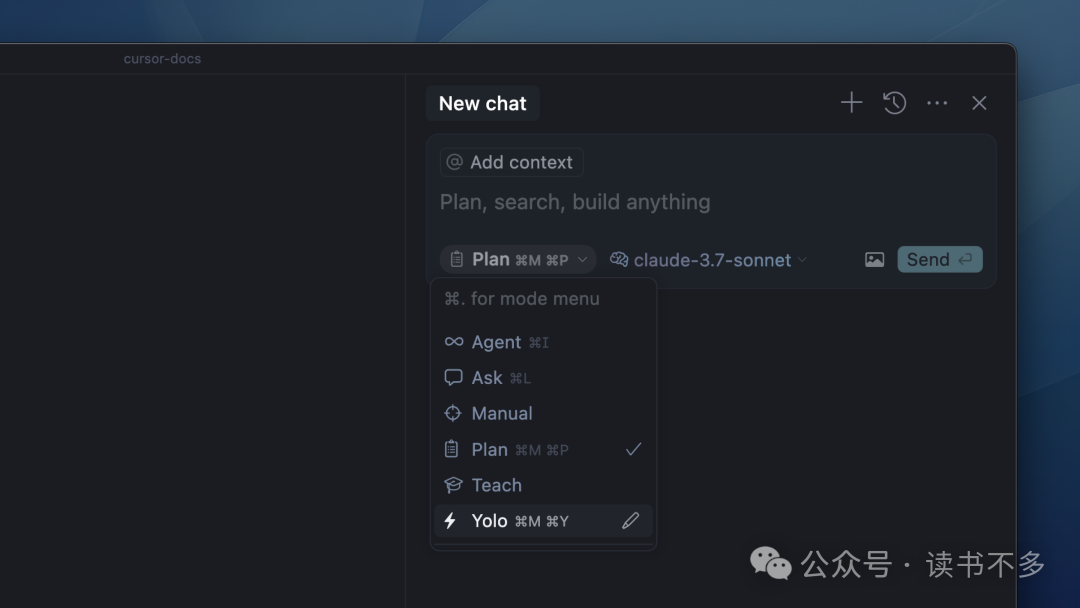

Cursor 最新版 0.48 更新

聊天标签、自定义模式和声音通知此次更新引入了可并行进行多组对话的聊天标签、重新设计的模式系统(含自定义模式),并改进了成本可视性、索引性能和 MCP 稳定性。此外,还增加了聊天完成时的声音通知。 0.47 已经引入了自定义模式,但是中间撤回了,这次又更新回来了。Cursor 0.47 自定义 Agent 来了内置模式和自定义模式(beta)Cursor 中现有的内置模式包括「智能代理(…- 0

- 0

-

基于AnythingLLM搭建本地知识库

书接上文,我们完成了deepseek模型的本地化部署,并通过pageAssist插件构建了我们第一个本地化聊天Agent。今天我们则通过anythingLLM 工具,从0到1搭建专属知识问答Agent。本文搭建过程无需任何编码经验下载与安装访问anythingLLM官网,点击“Download for Desktop”按钮,并根据要安装的电脑的操作系统选择对应版本的anything LLM安装包下…- 0

- 0

-

STEVE:用AI训练AI,打造更聪明的电脑操作助手帮你操控UI界面

最近,我读了一篇相当有意思的论文,名字叫《STEVE: A Step Verification Pipeline for Computer-use Agent Training》。相信这几个月大家也见到了不少AI操控电脑,帮我们搞好工作的案例,像智谱、manus等等,但是绝大部分是通过调用api的方式来指挥AI操作,那如果没有api的话,是不是图形界面也可以作为ai理解的一部分呢。这篇…- 0

- 0

-

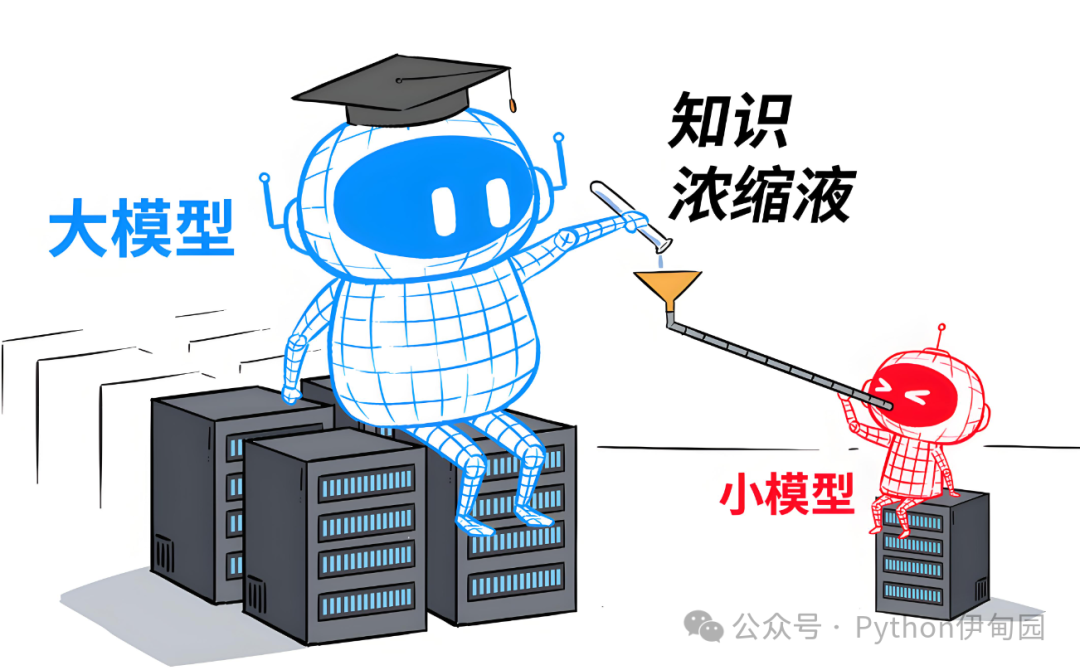

如何理解模型的蒸馏和量化

在LLM领域内,经常会听到两个名词:蒸馏和量化。这代表了LLM两种不同的技术,它们之间有什么区别呢?本次我们就来详细聊一下。一、模型蒸馏1.1 什么是模型蒸馏模型蒸馏是一种知识迁移技术,通过将一个大规模、预训练的教师模型(Teacher Model)所蕴含的知识传递给一个规模较小的学生模型(Student Model),使学生模型在性能上接近教师模型,同时显著降低计算资源消耗。以一种更…- 0

- 0

-

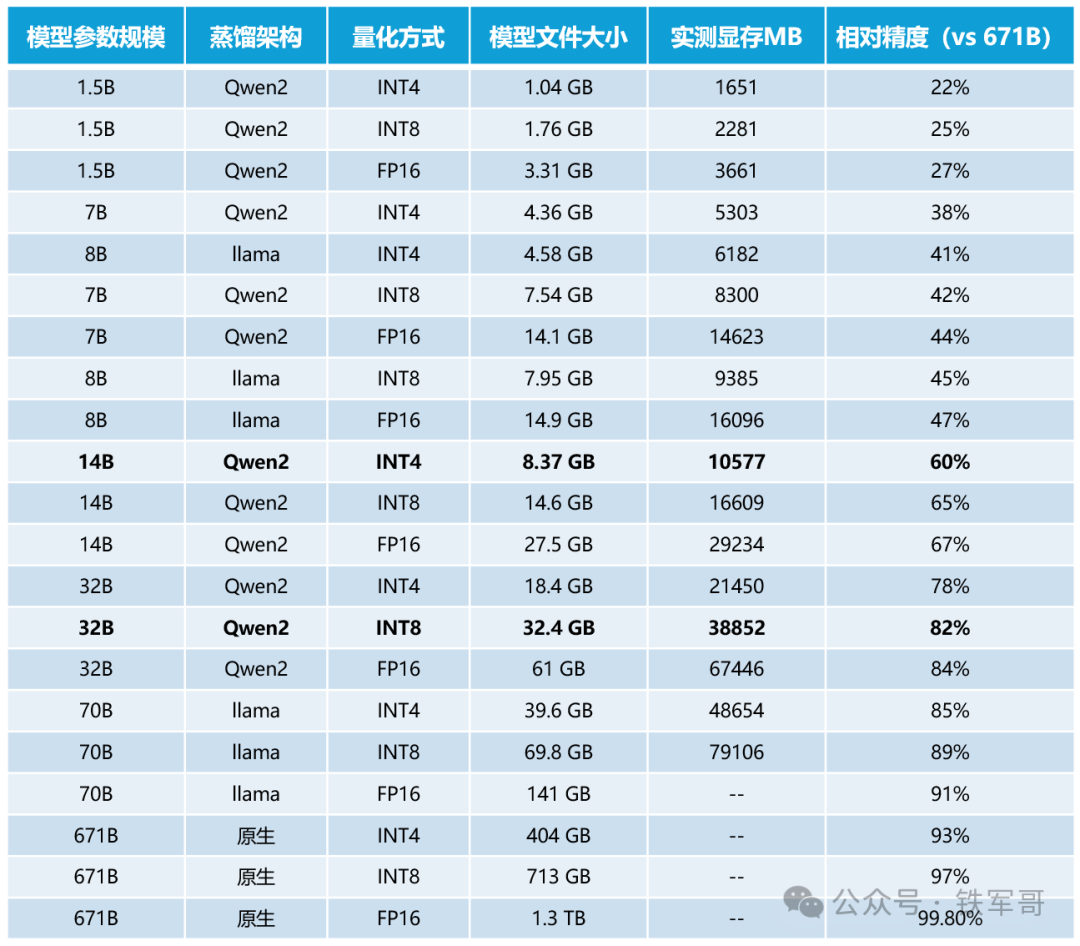

目前来看,ollama量化过的DeepSeek模型应该就是最具性价比的选择

大概意思是说,大模型中的每一个参数就是一个数字,默认的存储精度一般是BF16或者是FP16,学过编程的都知道,FP16就是16位半精度浮点数,数据长度有16bit,也就是2字节。按照这个容量计算,7B(70亿)的模型文件大小应该是14 GB左右,实际上也差不多,有15,237,852,832字节,合14.1 GB,而把这个模型运行起来,大概也是就是占用这么大的显存,实际上也差不多,要占用14623…- 0

- 0

-

使用 vLLM 生产环境部署 DeepSeek,算力减半、吞吐增十倍!

需求:之前使用 Ollama 部署过 deepseek-r1:32b 模型,非常方便快捷,适合个人快速部署使用。如果作为企业生产环境应该使用什么方式部署呢?一般都采用 vllm、sglang 进行部署,本文是用 vLLM 部署 DeepSeek-R1模型。Ollama 和 vLLM 对比区别如下:对比维度OllamavLLM核心定位轻量级本地化工具,适合个人开发者和小规模实验生产级推理框架,专注高…- 0

- 0

-

Ollama高并发测试

本文主要来测试一下ollama的高并发能力。具体配置如下:一、Ollama默认参数执行我们打开4个窗口,然后分别让DeepSeek “给我讲一个笑话” ,看下不同窗口的答题顺序。通过答题顺序可以看到,在不进行参数设置时,模型是一个一个执行。这样就说明,默认参数下,Ollama并不支持高并发,它会逐个回复我们的请求。二、调整Ollama高并发参数在ollama内,有两个参数与高并发有关分别是:OLL…- 0

- 0

-

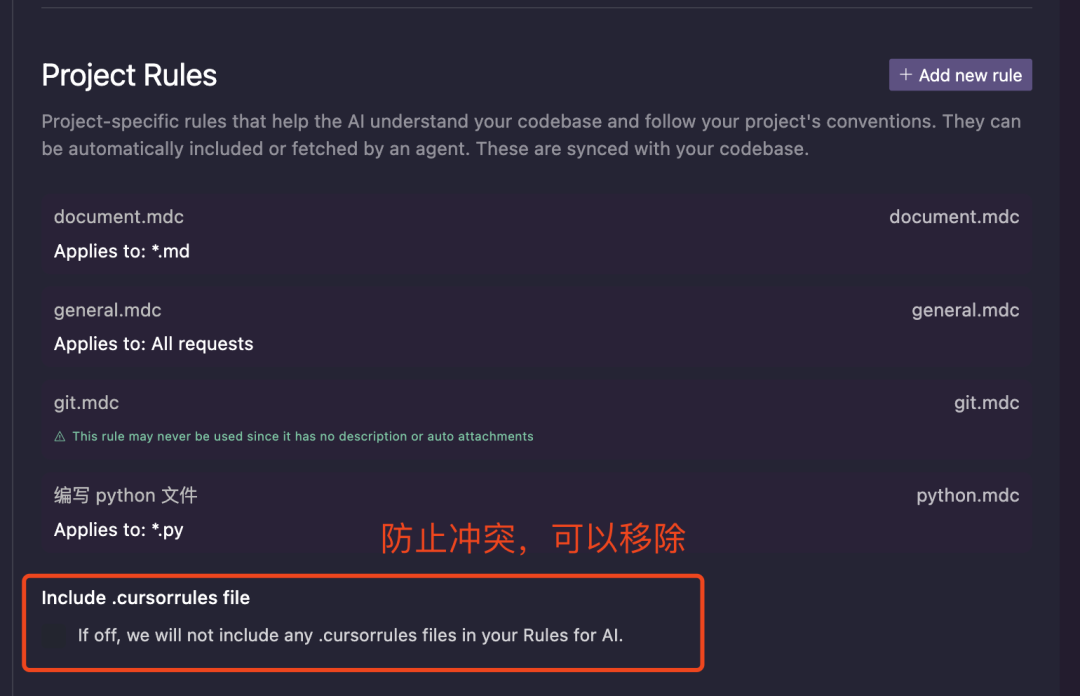

Cursor Rules 最佳实践总结

见字如面,与大家分享实践中的经验与思考。使用 AI 编写代码的一大问题就是 AI 乱改,Cursor 引入了一项功能,称为 Cursor Rules。它能允许开发者规范 AI 的行为,提供更好的编码体验。让我们深入了解 Cursor Rules 是什么,以及为什么它们对现代开发工作流程至关重要。什么是 Cursor Rules?Cursor Rules 用于自定义 AI 在 Cursor 中的行为…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!