-

微调大模型!ModelScope 算力,实现Qwen2.5微调模型

一、什么是微调(Fine-tuning)?微调(Fine-tuning)是机器学习中的迁移学习技术,指在大规模预训练模型(如Qwen2.5)基础上,使用特定任务的数据进行进一步训练,使模型适应新任务或领域。其核心目的是复用预训练模型的通用知识,同时通过少量数据调整模型参数以优化特定场景的表现。例如,Qwen2.5作为通用大模型可能无法直接处理医疗领域的专业术语,通过微调可使其掌握医疗报告生成能力,…- 0

- 0

-

Cursor是越来越难用了!逼着我写mdc文档比代码还多

Cursor真就越来越难用了,尤其从0.45版本开始,智能肉眼可见的下降,越来越Trae化了。这段时间以来我就发现Cursor的上下文越来越短,时不时的乱改文件,一个简单问题能盘它好久,明明就是已经提供了报错信息解决方式愣是不解决。最离谱的是我打开了MCP的功能,结果每次编辑文件他都会去调用MPC的写文件功能,我甚至把配置文件去掉了,他还在调MCP的rite_file。哎,以前有多智能,现在就有多…- 0

- 0

-

Docker部署Dify+RAGFlow避坑指南

在 Docker 中同时安装 dify 和 RAGFlow 后,可能会遇到以下问题:一、端口冲突问题现象:Dify 和 RAGFlow 默认使用相同的端口(80 和 443),导致某一服务无法启动。解决方案:修改 RAGFlow 的端口映射,例如在 docker-compose.yml 中调整:ports: - "8000:80&quo…- 0

- 0

-

大型语言模型如何高效微调量化?答案就是 QLoRA!

QLoRA(Quantized Low-Rank Adapters)是一种高效的微调技术,用于在消费级硬件(如单张GPU)上微调大语言模型(LLM)。它的核心思想是通过量化(Quantization)和低秩适配器(Low-Rank Adapters)来减少内存占用,同时保持模型的性能。QLoRA 的关键技术4-bit 量化:使用4-bit NormalFloat (NF4) 量化方法,使得模型占用…- 0

- 0

-

LLaMA Factory微调后的大模型在vLLM框架中对齐对话模版

LLaMA Factory微调后的大模型Chat对话效果,与该模型使用vLLM推理架构中的对话效果,可能会出现不一致的情况。模型回答不稳定:有一半是对的,有一半是无关的?一般是因为训练时间太短,loss曲线未收敛;需要继续微调训练;大模型回答与LLaMA Factory训练chat界面的不一致?一般是因为对话模版chat_template不一致。本文来讲解下对话模版不一致的情况的解决方法。一、原因…- 0

- 0

-

AI大模型分布式训练技术原理是什么?看这篇超犀利解析!

AI大模型分布式训练技术是解决单机资源不足、提升训练效率的核心手段。 一、为什么需要分布式训练?模型规模爆炸:现代大模型(如GPT-3、LLaMA等)参数量达千亿级别,单卡GPU无法存储完整模型。计算资源需求:训练大模型需要海量计算(如GPT-3需数万GPU小时),分布式训练可加速训练过程。内存瓶颈:单卡显存不足以容纳大模型参数、梯度及优化器状态。二、分布式训练的并行策略1、数据并行(D…- 0

- 0

-

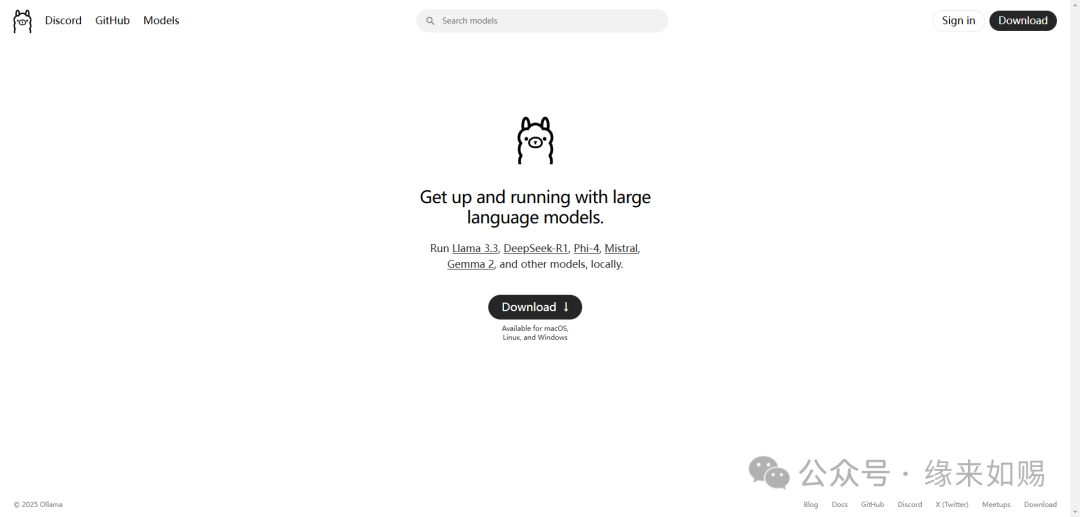

大模型部署该选谁?Ollama、vLLM 和 LMDeploy,各有千秋!

一、Ollama、vLLM 和 LMDeploy介绍Ollama、vLLM 和 LMDeploy 都是与大语言模型相关的工具或框架,以下是它们的具体介绍:Ollama简介:一个轻量级的模型托管框架,可在本地环境中运行和管理 LLM 模型。基于 Go 语言开发,集成了模型管理与交互界面,采用 MIT 许可。适用场景:适用于个人开发者测试、教育场景以及轻量应用,比如在 MacBook Pro(M3 芯…- 0

- 0

-

【强烈建议收藏】一文读懂大模型训练的通信原语

在大模型训练过程中,通信原语起着举足轻重的作用。大模型训练涉及海量数据和复杂计算,需要多节点协作。通信原语能保障各节点间高效数据交互,像All-Reduce可实现全局梯度同步,让各节点获取相同规约结果,保证模型参数更新一致性;Reduce-Scatter能将规约结果分块到各节点,便于并行计算。合理运用通信原语可优化训练流程,减少通信延迟,提升计算资源利用率,加速训练速度。若通信原语使用不当,会出现…- 0

- 0

-

为什么你的Cursor效率不如我

现阶段程序员们都在探索如何高效地释放AI编程能力,比如用一句prompt在项目工程中构建一份本地的上下文基础信息库,这其实是一种AI编程工程的优化使用过的 Cline 的同学应该都能感受到 Cline、 Cursor,Copilot 之间的”代差“。而Cline优秀的上下文管理能力很大程度上正是因为memory bank,相信大家都遇到过以下这些糟糕表现改了一个文件,没有修改另外的文件。如果是几百…- 0

- 0

-

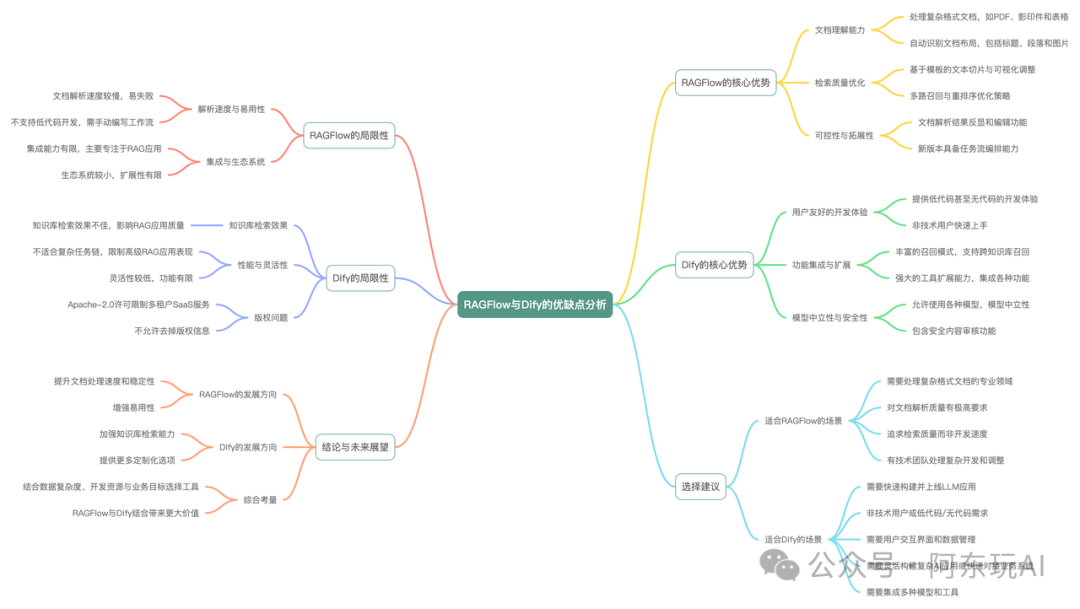

RAGFlow vs Dify, 商业化落地场景选哪个?

随着大模型(LLM)技术在各行各业的快速落地,对话式 AI 的需求持续升温。越来越多的团队开始探索如何让智能对话更好地与业务场景融合,以提升客户体验、优化企业内部流程。在众多解决方案中,RAGFlow 与 dify 这两款产品因其独特的技术思路与应用定位而备受瞩目。本文将围绕它们的特点、应用场景以及适用人群展开分析,帮助您更好地理解二者的差异,从而做出最优的技术选型。…- 0

- 0

-

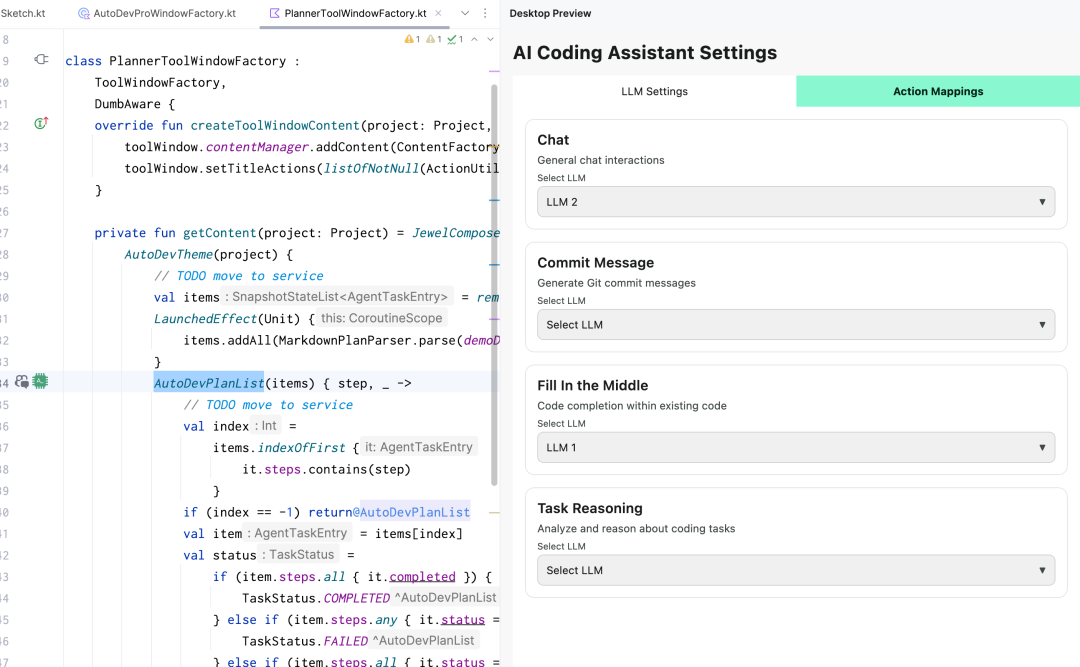

AutoDev Next:IDE 即 AI 编程服务,构建多端粪围编程

AutoDev Next 的核心理念是将强大的 IDE 能力与 AI 结合,打造“IDE 即服务”的下一代 AI 编程体验,随处即创建应用的编程服务体验。GitHub:https://github.com/unit-mesh/auto-dev-next引子:AI 编程的持续进化我们正经历一个从传统手动编码到 AI 辅助开发的转变时代。在这种新范式下,开发者可以通过自然语言描述需求,由 AI 负责生…- 0

- 0

-

论懂五行术数还得看DeepSeek,手把手教你搭建一个算命智能体!

前言在之前《白嫖DeepSeek的文章》里,我提到了好几种当下可以免费使用的DeepSeek方式。这两天又发现了一个完全免费的可联网满血模型使用方式,即支付宝的百宝箱产品,知道的人应该不多。不过这篇文章我不准备仅仅告知大家一个可以免费使用DeepSeek联网满血模型的另一个途径,它还提供了更多好用的功能,我将手把手教大家使用百宝箱提供的功能,搭建一个基于DeepSeek R1的算命智能体。至于为什…- 0

- 0

-

Open R1 项目进展第一期

DeepSeek R1 发布已经两周 (注: 原文发布于 2 月 2 日) 了,而我们启动 open-r1 项目——试图补齐它缺失的训练流程和合成数据——也才过了一周。这篇文章简单聊聊:Open-R1 在模仿 DeepSeek-R1 流程和数据方面的进展我们对 DeepSeek-R1 的认识和相关讨论DeepSeek-R1 发布…- 0

- 0

-

Open R1 项目进展第二期

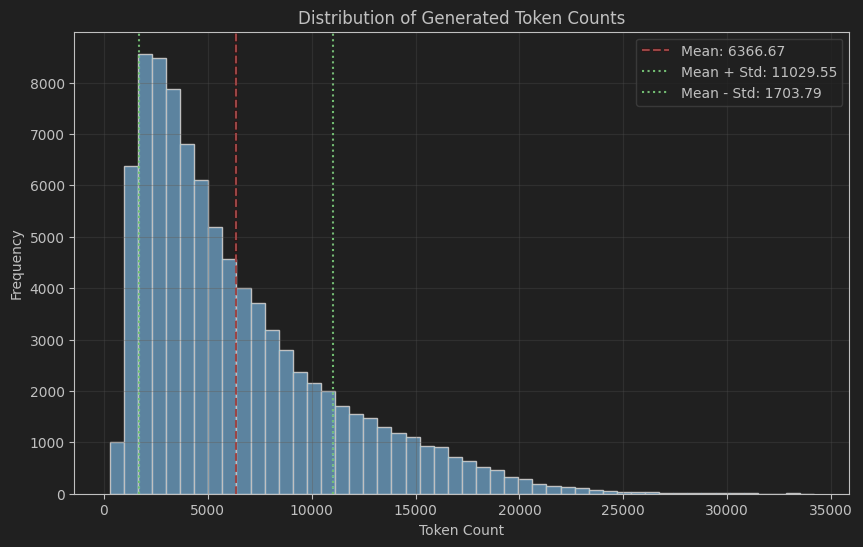

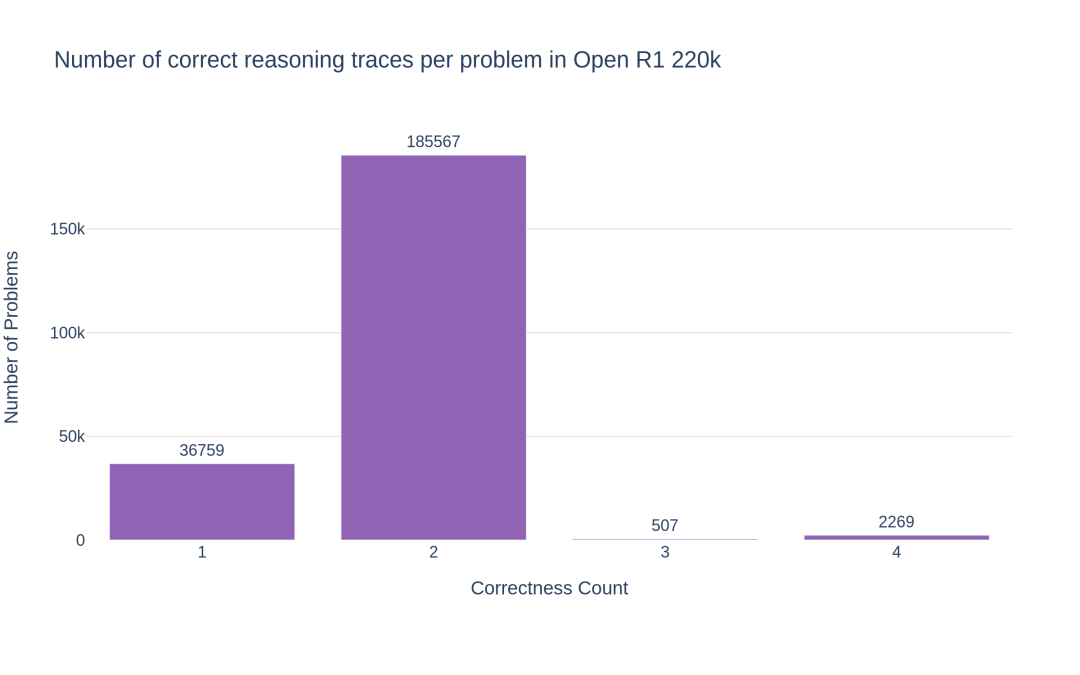

原文发布于 2025 年 2 月 10 日我们启动 Open R1 项目已经两周了,这个项目是为了把 DeepSeek R1 缺失的部分补齐,特别是训练流程和合成数据。这篇文章里,我们很高兴跟大家分享一个大成果:,这是我们打造的第一个大规模数学推理数据集!除此之外,我们还聊聊社区里一些让人兴奋的进展,比如怎么整理出小而精的高质量数据集来微调模型,以及如何在训练和推理时控制推理模型的“思考步数”。一…- 0

- 0

-

通义灵码与魔搭Notebook深度集成:在线编码开箱即用,开发效率倍增

00前言通义灵码2.0 AI程序员于2025年1月上线,目前已支持超过百万开发者。该工具的智能编程能力现已与阿里云AI模型开发平台魔搭ModelScope实现技术集成,成为继函数计算FC之后接入该平台的又一开发工具。此次合作将通义灵码的代码生成能力应用于AI模型研发流程,为算法工程师提供开发支持。在魔搭 ModelScope 的Notebook在线开发环境中,开发者现可直接开启通义灵码的智能问答和…- 0

- 0

-

FastGPT原理分析-数据集创建第一步

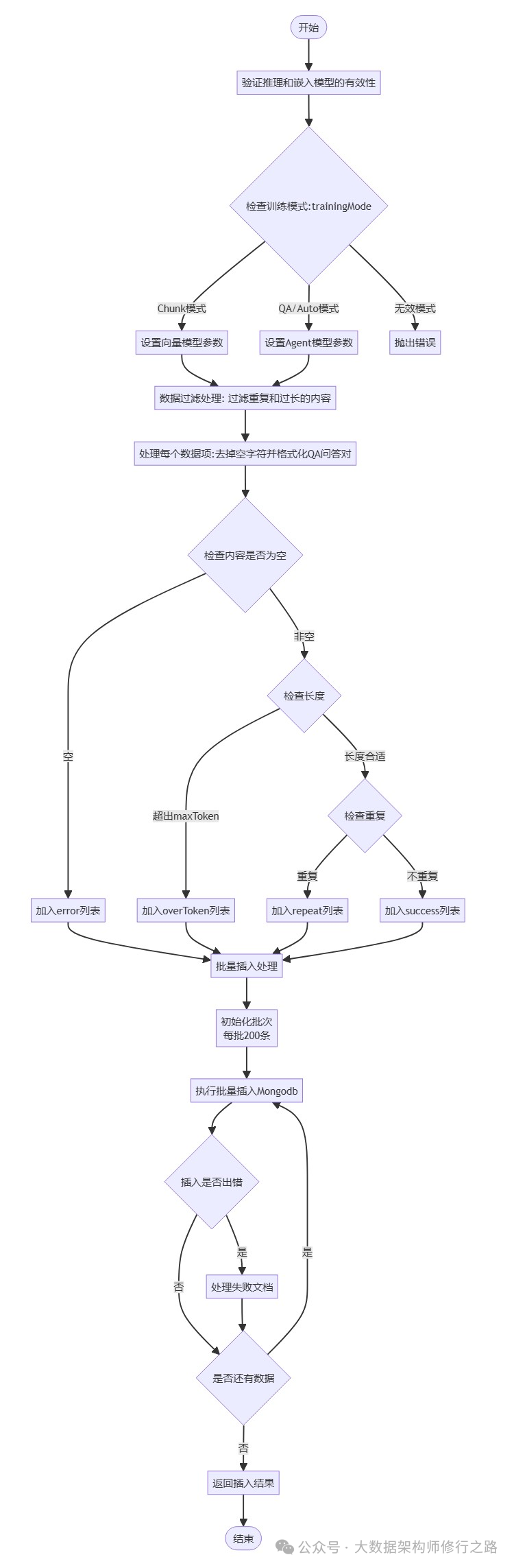

概述FastGPT的文件上传过程分为两个阶段:第一个阶段:是文件上传。第二个阶段:是对文件进行向量化处理和QA化处理。本文介绍文件上传的总体流程,并对创建数据集的第一步的详细实现逻辑进行分析。数据集创建总体流程数据集创建分为两个步骤:第一步:文件上传和预处理,插入记录到mongodb的训练队列dataset_trainings表中。第二步:监控mongodb的插入操作,并启动数据处理:(1)嵌入向…- 0

- 0

-

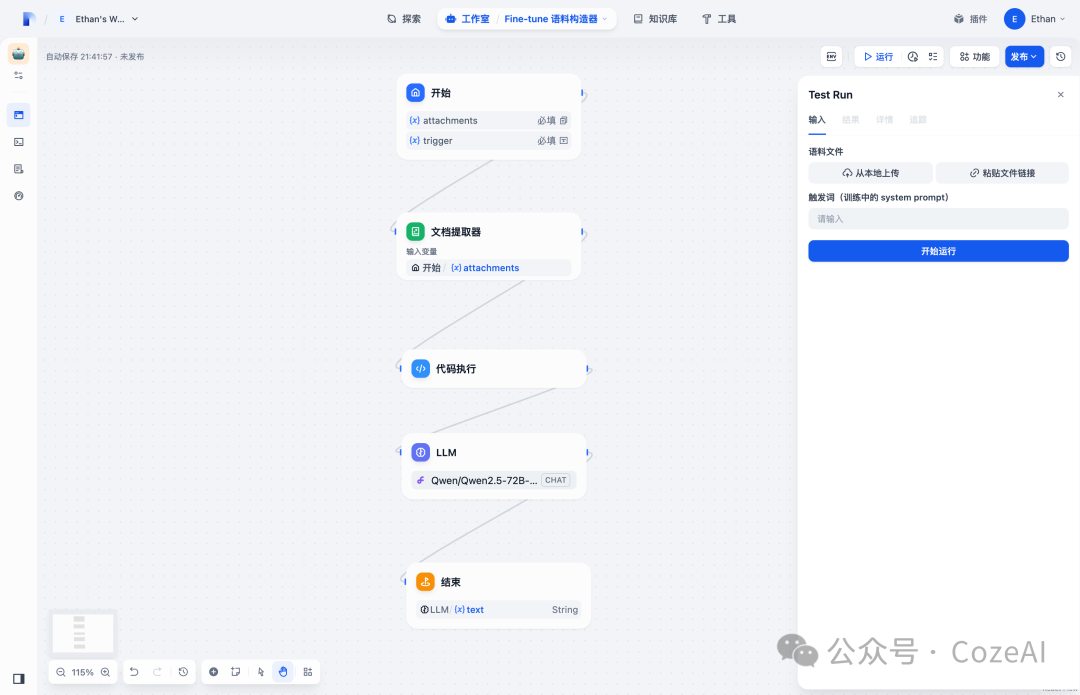

如何利用Dify轻松构建你的专属语料库?

在人工智能的浪潮中,大语言模型(LLM)展现出强大的能力。除了聊天对话,LLM 还能帮助我们完成许多任务,例如构建用于模型微调的语料库。本文将以一个dify实际的工作流为例,向您介绍如何利用 LLM 自动化地创建高质量的语料数据。 什么是语料库?为什么需要构建它? 语料库,简单来说,就是大量文本数据的集合。对于训练或微调一个特定任务的语言模型来说,高质量的语料库至关重要。例如,…- 0

- 0

-

大模型的秘密武器:模型蒸馏技术

随着人工智能的快速发展,大模型的规模和复杂度不断攀升。以GPT系列为例,从GPT-1到GPT-4,模型参数呈指数级增长,带来了更强大的语言处理能力,但也伴随着高昂的计算成本和存储需求。在实际应用中,许多设备,如手机、边缘计算设备等,无法承受如此庞大的模型运行。这就如同打造了一辆超级跑车,性能卓越,但却无法在普通的小路上行驶。大模型蒸馏技术应运而生,旨在解决大模型在实际应用中的“水土不服”问题,让模…- 0

- 0

-

Xinference 本地部署全流程详解与疑难解答

一、基础环境配置1. Docker 与 NVIDIA 驱动验证核心步骤:Docker 安装验证:docker --version # 需 ≥24.0.5(2025年兼容性要求)NVIDIA 驱动兼容性:检查驱动版本(需 ≥535.129.03):nvidia-smi | grep "Driver Version" # 输出示…- 0

- 0

-

客服中心如何微调专属AI大模型

在智能客服的浪潮下,AI大模型的应用正逐步成为企业提升服务质量和运营效率的重要工具。然而,未经优化的AI大模型往往无法精准理解用户需求,甚至可能因答复不当而引发客户不满。例如,某银行客服团队反馈,用户在深夜咨询ETC发票问题时,AI大模型竟然回复“建议您在白天工作时间咨询”,导致客户投诉。这种问题的出现,表明AI大模型必须经过精细化的微调,才能真正适应企业的业务需求和用户期望。本文将深入探讨如何高…- 0

- 0

-

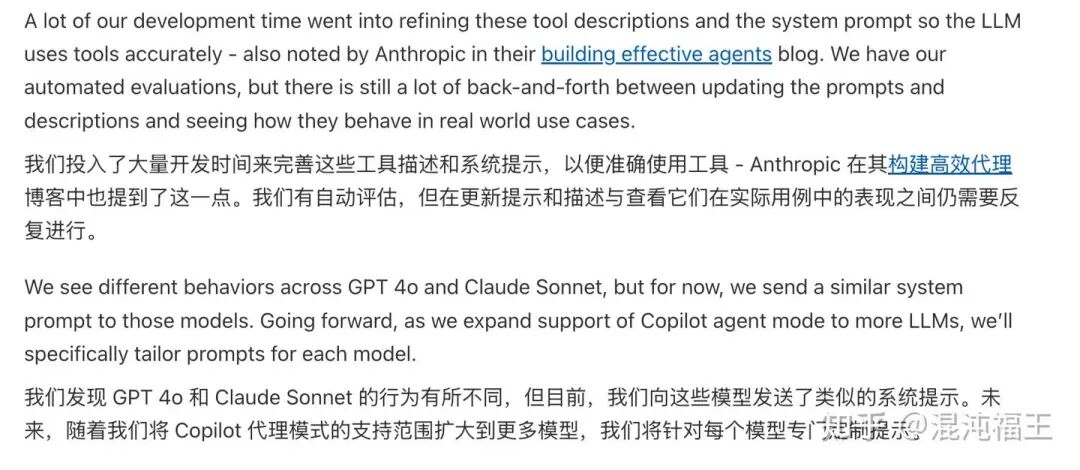

全网首家,教你快速打造个人/企业版本 cursor

笔者长期在 cursor / windsurf 之间徘徊,多次切换 GitHub Copilot 发现都没有达到很好的效果。这里主要有几个重要的能力差距:1. Copilot 代码智能、且快速的自动应用。 2. Agent 自动编程模式。3. UI/UX交互体验细节前面两个功能的实现,从原理上并不复杂,但提示工程细节优化非常需要耐心。Copilot 团队在文档中也介绍了这里的工作量。今天尝试了最新…- 0

- 0

-

DeepSeek-R1本地化部署全流程

1.模型定位与平衡运行硬件需求1.5B/7B/8B版本定位:中小型模型、轻量级模型、平衡型模型参数规模:1.5B(15亿)、7B(70亿)、8B(80亿)特点:轻量级模型,资源消耗低,推理速度快,但处理复杂任务的能力有限。硬件需求:普通消费级GPU(如RTX3090/4090 GPU,显存≥4GB)适用场景:· 本地开发和测试:可处理一些常规的翻译、总结、摘要、生成等常见任务…- 0

- 0

-

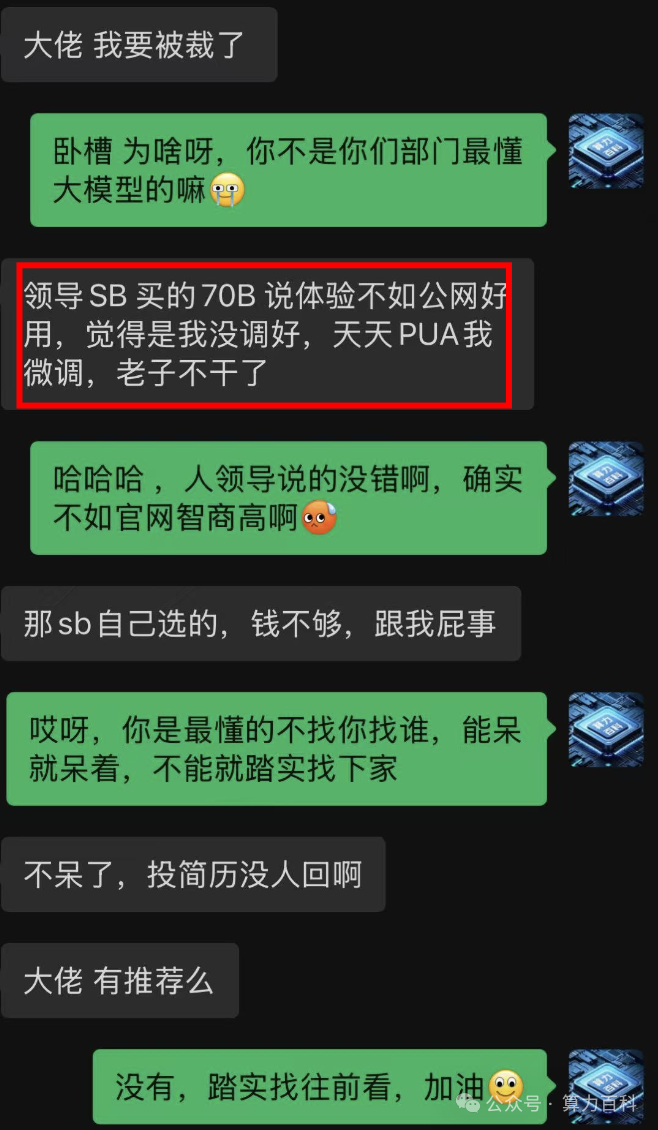

他因选DeepSeek 70B 体验差,被开除

受害者案例 这个案例是真实的,这个哥们之前问过我选什么版本,我俩还探讨过选什么版本比较好,我推荐他选满血版,哪怕是选择一个量化Q4的,他们预算不多,领导的意思是先做个AI助手,再慢慢体验后续逐步集成到业务系统里。 最终,他们选择了一个之前合作过的集成商,提供了一个DeepSeek 蒸馏的70B版本,部署了一个AI助手用,领导说不好用,天…- 0

- 0

-

AI训练平台终极构建指南:结合RoCE/IB网络、3FS存储与HAI平台

AI训练平台的建设是人工智能领域发展的核心驱动力,尤其在分布式训练和大规模模型训练中,涉及网络、存储和平台集成的多方面技术。本报告基于当前研究和实践,详细探讨如何从底层RoCE或IB网络、网络优化、3FS存储到幻方HAI Platform平台的多维度构建高效AI训练平台,内容面向技术从业者和决策者,力求通俗易懂。1. 底层网络:RoCE和IB的技术基础AI训练对网络性能要求极高,尤其是分布式GPU…- 0

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!