LangChain与LlamaIndex,作为两大AI应用开发框架,它们各自以独特的优势和特点,为开发者提供了构建智能应用的利器。本文将从三个维度进行深入剖析:LangChain的模块化魔法、LlamaIndex的检索神技,以及在实际开发中如何做出选择。

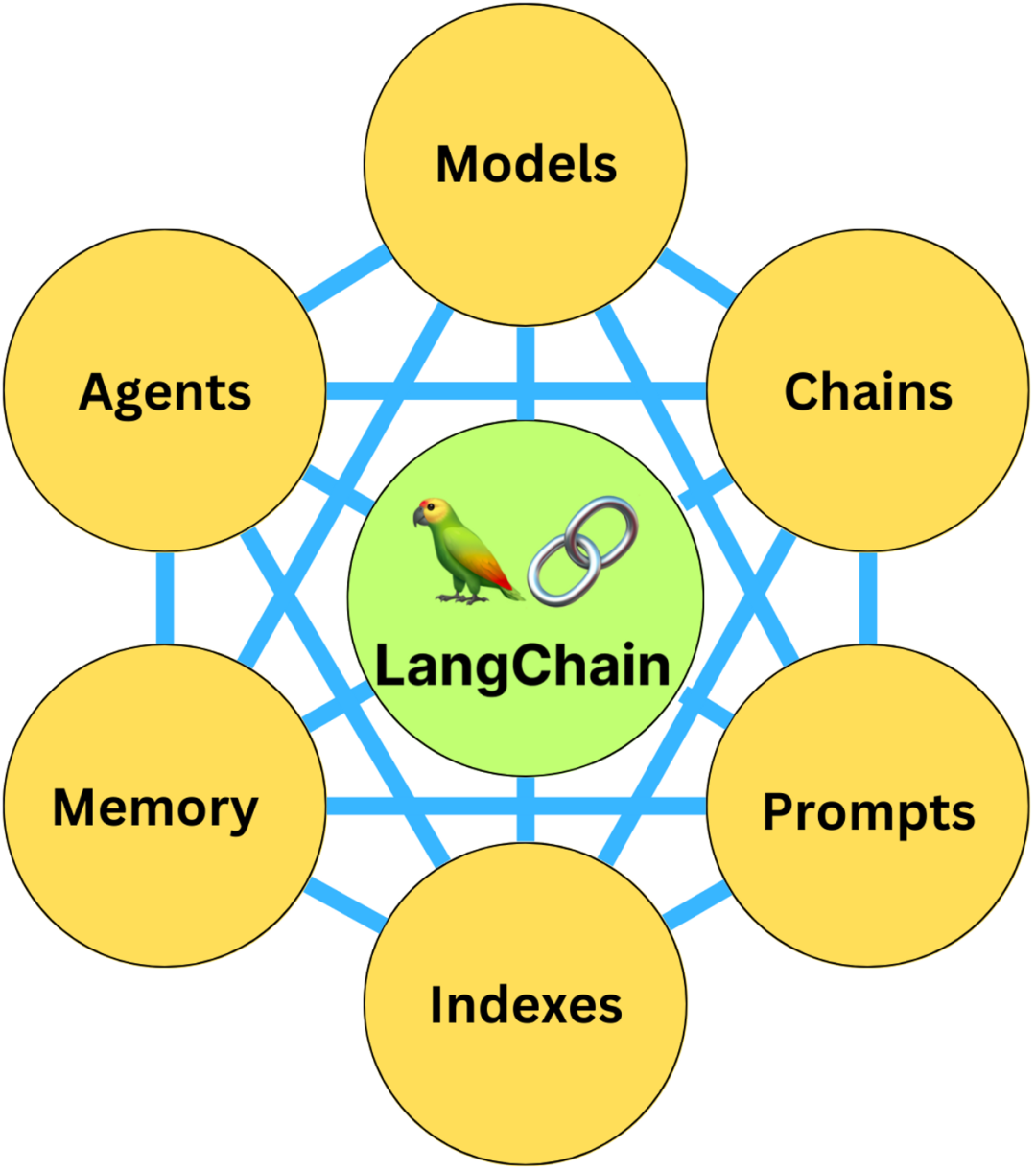

简单来说,LangChain 旨在简化与语言模型的交互方式,帮助开发者更有效地利用现有的技术栈与语言模型交流,并构建出功能更强大的应用程序。

-

LangChain库:提供了各种组件的接口和集成,一个基本的运行时,用于将这些组件组合成链和代理,以及现成的链和代理的实现。

-

LangChain模板:一系列易于部署的参考架构,用于各种任务。

-

LangServe:一个用于将LangChain链部署为REST API的库。

-

LangSmith:一个开发者平台,与LangChain无缝集成,让开发者可以调试、测试、评估和监控基于任何LLM框架构建的链。

LangChain适用于需要支持多种语言模型、高度可定制的应用开发。它的模块化设计,使得它具有很好的可扩展性,适合需要将LLM集成到现有系统中的场景。

LlamaIndex 是一个用于构建大型语言模型(LLM)应用程序的数据框架,它提供了数据连接器、索引、引擎等工具,能帮助用户摄取、结构化和访问私有或特定领域的数据,并与其他应用程序框架集成,从而更安全可靠地将这些数据注入 LLM 中,以实现更准确的文本生成。

-

支持多种数据源;

-

提供高级检索/查询界面,只需输入 LLM 输入提示,即可返回检索到的上下文和知识增强输出;

-

具备高级和低级 API,方便不同水平的用户使用;可与多种框架集成;

-

拥有社区库和项目平台等生态系统资源。例如,用户可以利用 LlamaIndex 将大量文档加载到系统中构建文档问答系统,然后根据用户提出的问题,系统会自动查找相关文档并生成答案。

同时,LlamaIndex 还允许微调嵌入模型以适应特定任务或数据集。常见的使用场景包括为客户支持构建聊天机器人、辅助研究人员和学者完成特定领域任务、帮助医生访问复杂医疗信息等。

工作原理

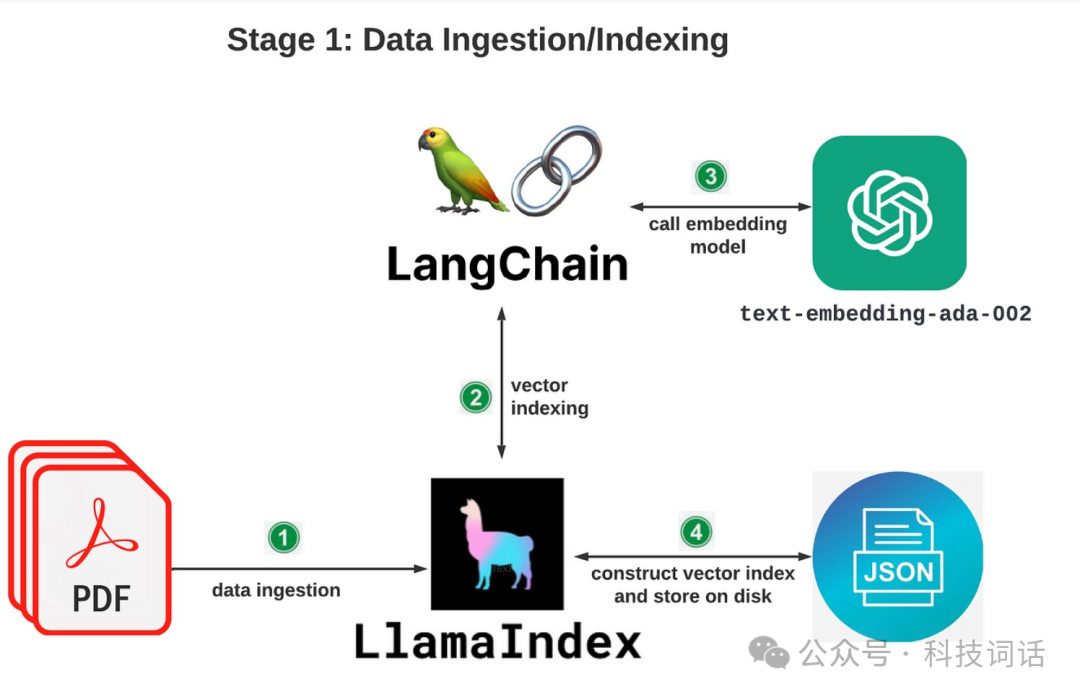

LlamaIndex的工作原理基于检索增强生成(RAG)技术,包括两个核心步骤:

-

索引阶段:将专有数据转化为富含语义信息的向量索引。

-

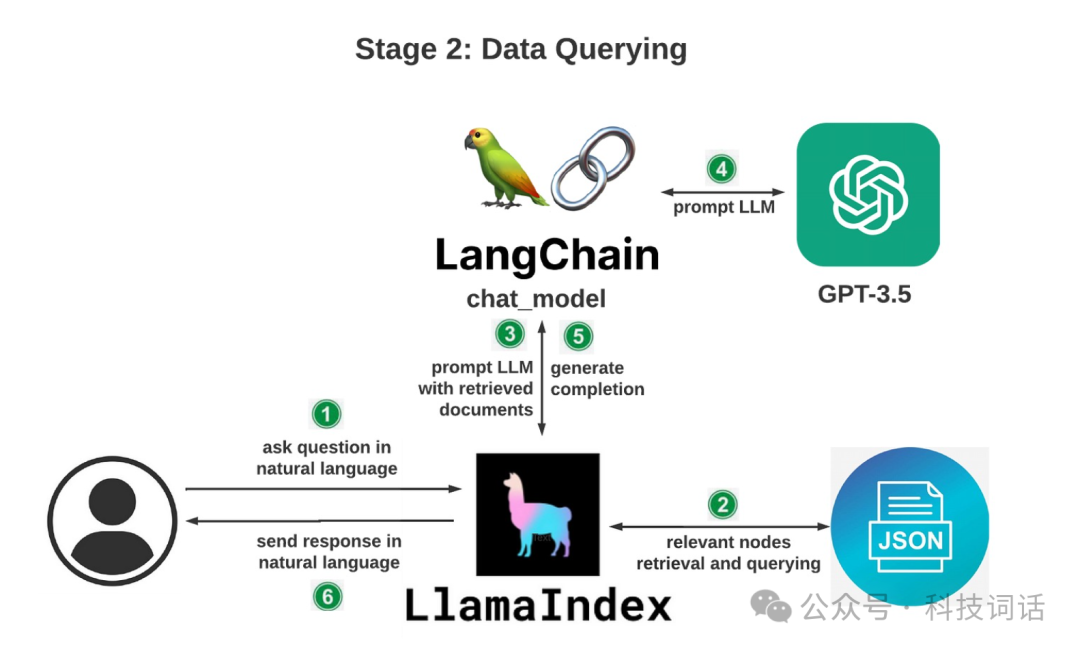

查询阶段:系统接收到查询后,迅速匹配并返回最相关的信息块,结合原始问题,由LLM生成精准答案。

LangChain与LlamaIndex,如何选择

在选择LangChain和LlamaIndex时,需要考虑以下因素:

-

项目需求:如果应用主要关注搜索和检索,LlamaIndex可能更适合。对于更多样化的NLP任务和自定义工作流程,LangChain提供更大的灵活性。

-

使用简易性:LlamaIndex提供更简化和适合初学者的界面,而LangChain需要更深入地理解NLP概念和组件。

-

自定义程度:LangChain的模块化架构允许进行广泛的自定义和微调,而LlamaIndex则提供了更偏向于搜索和检索优化的有见地的方法。

LangChain与LlamaIndex,两大框架各有千秋。LangChain以其模块化和高度可定制性,在多样化的NLP任务中展现出强大的能力。而LlamaIndex则专注于提供高效的数据索引和检索,尤其适合信息检索密集型应用。开发者在选择框架时,应根据项目的具体需求、易用性偏好和定制化程度来做出决策。无论选择哪一个,它们都将是构建创新AI应用的有力助手。