近两年,随着大模型(LLM,Large Language Model)技术的飞速发展,越来越多的开发者开始构建基于 LLM 的应用。但在实际开发过程中,我们会发现有一些绕不开的“痛点”,比如:

-

• 如何实时观察模型的运行情况? -

• 怎么高效管理和迭代 Prompt? -

• 如何评估 LLM 的输出质量? -

• 数据从哪里来,又该如何测试?

这些问题如果逐一手动解决,可能会浪费大量时间和精力。今天就给大家介绍一个开源工具——Langfuse,它是一个一站式的 LLM 工程平台,能帮开发者解决从开发到监控的一系列问题。

为什么需要 Langfuse?

对于用 LLM 构建的产品,开发者通常面临如下挑战:

-

1. 模型监控难

LLM 的运行是一个“黑箱”,我们需要知道调用了哪些 API,消耗了多少成本,运行速度怎么样,这些都需要监控工具。 -

2. Prompt 管理混乱

不断调整 Prompt 是开发过程中不可避免的,但如果没有一个集中式管理平台,很容易陷入版本混乱。 -

3. 质量评估复杂

如何衡量模型输出是否满足预期?人工打分?还是用另一个模型来评估?这其中需要明确的流程和工具支持。 -

4. 测试和实验繁琐

在上线前,我们需要对 Prompt 和模型进行大量的实验验证,确保最终的效果。这需要方便的测试和回归工具。

Langfuse[1] 就是为了解决这些问题而生的,它能够让开发者专注于功能实现,而不用为基础工具链操心。

Langfuse 能做什么?

我们可以从三个方面来看 Langfuse 的核心功能:

1. 开发阶段:模型可观测性(LLM Observability)

Langfuse 提供强大的日志追踪功能,你可以通过集成 Langfuse 的 SDK,把每一次 LLM 的调用记录下来。

-

• 支持的语言:Python 和 JavaScript/TypeScript -

• 集成方式:可直接替换 OpenAI SDK,或者作为 LangChain、LlamaIndex 的回调系统使用。

代码示例如下:

from langfuse import Langfuse

# 初始化 Langfuse

langfuse = Langfuse(api_key="your-public-key", secret="your-secret-key")

# 示例调用:记录一次 LLM 调用

langfuse.trace(

name="Generate Product Description",

metadata={"model": "gpt-4", "prompt_length": 200},

output="This is a sample response"

)借助这些日志,你可以轻松分析以下信息:

-

• API 的响应时间和成本 -

• 调用链的执行流程 -

• 错误率和性能瓶颈

甚至还可以通过集成到 OpenAI、LangChain 等库,完成自动化的数据采集!

2. 管理阶段:Prompt 管理和版本控制

Prompt 是构建 LLM 应用的核心,但随时间推移,不同版本的 Prompt 可能会导致逻辑混乱。Langfuse 提供了一个集中管理和版本控制的功能,帮助开发者高效组织 Prompt。

核心功能:

-

• 版本管理:记录 Prompt 的每次修改,支持回滚到之前的版本。 -

• Prompt 调试:通过 Prompt Playground 快速测试和调整 Prompt。

用户输入Prompt 版本 1Prompt 版本 2模型输出优化

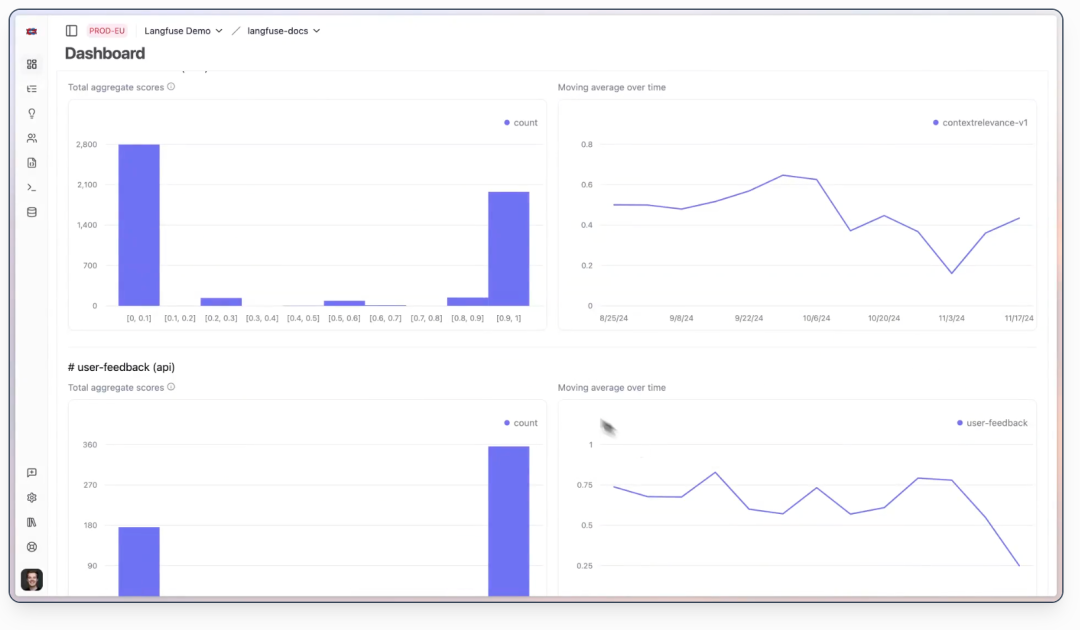

3. 测试阶段:模型评估与实验管理

Langfuse 提供完善的 LLM 评估功能,支持多种方式:

-

1. 人工打分:开发者或用户手动评价模型输出质量。 -

2. 模型评估:用另一个 LLM 模型作为“裁判”打分。 -

3. 自动化测试:提供数据集和基准测试功能,提前发现潜在问题。

一个简单的实验配置代码示例:

langfuse.evaluate(

model_output="The quick brown fox",

reference_output="A quick, brown fox",

metrics=["similarity", "fluency"]

)这可以帮助团队在上线前,快速定位模型问题,并优化产品体验。

Langfuse 的部署方式

Langfuse 提供两种主要的部署模式:

-

1. 云端部署(Langfuse Cloud)

开箱即用,适合个人开发者和小团队。免费计划无需信用卡,直接上手! -

2. 本地部署(Self-hosted)

如果你对数据隐私要求高,也可以选择本地化部署,只需一个 Docker 容器和 PostgreSQL 数据库即可。

本地部署的命令如下:

# 克隆仓库

git clone https://github.com/langfuse/langfuse.git

cd langfuse

# 启动服务

docker-compose up -d支持 Kubernetes、GCP、AWS 等模板化部署。

与其他工具对比

市面上也有一些工具在解决类似问题,我们简单做个对比:

|

|

|

|

|

|

| Langfuse |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

从功能完整性和灵活性来看,Langfuse 是目前为数不多的覆盖开发全生命周期的开源工具,非常适合 LLM 应用开发者使用。