人类一直希望人工智能能成为人类的重要助手,协助人类解决各种复杂问题,完成各种各样繁琐的任务。AGI(Artificial General Intelligence,通用人工智能)将会帮助人们实现该愿景。AGI是指一种能够像人类一样思考、学习和执行多种任务的人工智能系统。多年来,人们在人工智能领域的不断研究探索,尤其是随着大语言模型的爆火,使得人们越发清晰的认识到Agents和人工智能的发展是密不可分的。Agents被视为是通往AGI的主要探索路线。

1 概述

11月6日,OpenAI在召开了首次开发者大会。在大会上,OpenAI认可了AI Agent的发展方向,并提供了一系列产品功能用于支持AI Agent的发展,包括:

-

GPT builder:对话形式构建agent的UI,无需任何代码; -

Assistants API:一系列高级API帮助开发者快速搭建应用; -

GPTs平台:Agents分发平台。开发者可以上传自己的Agent(OpenAI叫客制化GPT),并获得利润分成。

2 Agent起源与演进

随着ChatGPT等大语言模型(LLM)获得了巨大成功,在其爆火的推动下,AI Agent(智能体)相继成为各大科技巨头布局的新风口。比如微软推出了AutoGen、谷歌Deepmind推出了Robotic Agent、亚马逊推出了Bedrock Agents、阿里云ModelScopeGPT、斯坦福与谷歌联合搭建的名为《Smallville》的虚拟小镇等等,同时,OpenAI也已然奔赴至Agent。Agent被认为是大语言模型(LLM)的下半场,或许它将是决定大语言模型革命的关键因素。

Agent是一个历史悠久的概念,最早起源于哲学,其根源可以追溯到Aristotle(亚里士多德)和Hume(休谟)等思想家[1][2]。其描述了一种拥有欲望、信念、意图以及采取行动能力的实体。后来,随着计算机技术的兴起与快速发展,再加上人们一直以来对人工智能的期望,研究人员将Agent概念引入至人工智能领域中。在人工智能领域,AI Agent(智能体)这一术语被赋予了一层新的含义:具有自主性、反应性、主动性和社交能力特征的智能实体。

-

自主性:智能体能够在没有人类或其他实体的直接干预下运行,并对其行为和内部状态具有一定的控制能力。也即智能体不仅应该具备按照明确的人类的指令完成任务的能力,还应该具备独立启动和执行行动的能力。

-

反应性:智能体能够对环境中的即时变化和刺激做出快速响应的能力。也即智能体能够感知其周围环境的变化,并迅速采取适当的行动。

-

主动性:智能体不仅仅是对环境做出反应,而且也需要具备主动采取行动来展示出以目标为导向的能力。该属性强调智能体能够进行推理、制定计划并采取主动措施来实现特定目标或适应环境变化。

-

社交能力:智能体与其他智能体(包括人类)通过某种通信语言进行交互的能力。

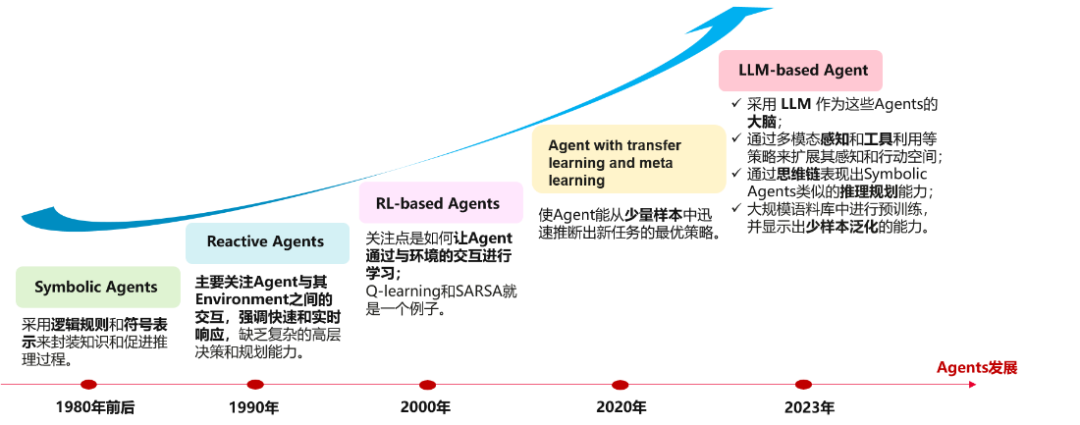

图1 Agents演进示意图

Agent的演变经历了几个阶段,从20世纪80年代开始,Agent在不断演进中,从无“脑”演变为有“脑”,从初始的采用逻辑规则和符号来封装知识和促进推理过程,演变为采用LLM作为大脑,并通过更多的组件赋予其更多的能力,如通过多模态感知和工具等策略扩展其感知环境,通过思维链实现类似推理规划能力等。

3 Agent是什么

3.1 Agent概念

-

自主智能体:如Auto-GPT,主要是为人类服务,自动执行任务并实现预期结果。 -

生成智能体:如斯坦福和谷歌的西部世界小镇,它们在同一环境中生活,拥有自己的记忆和目标,不仅与人类交往,还会与其他机器人互动。

-

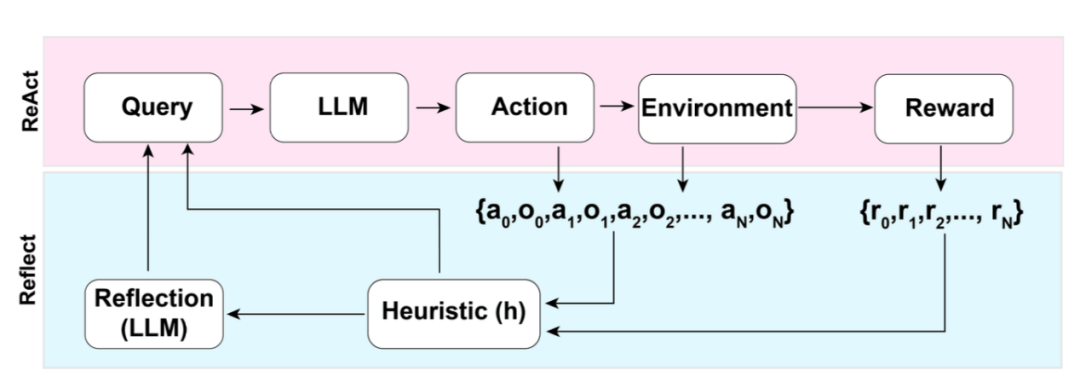

子目标和分解:Agent能够将大型/复杂任务分解为更小的、可管理的子目标,以便高效的处理复杂任务。 -

反思和改良:Agent可以对过去的行为进行自我批判和反思,从错误中吸取经验,并为接下来的行动进行分析、总结,从而提高最终结果的质量。

-

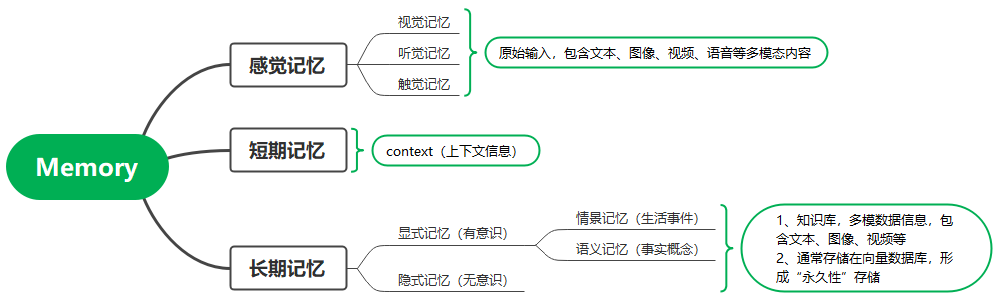

短期记忆:即Prompt内的信息,所有上下文学习都可以视为利用模型的短期记忆进行学习。 -

长期记忆:使得Agent能够长期保存和回忆(无限)信息的能力,通常使用外部向量存储和快速检索实现。

-

Agent可以学习如何调用外部 API,以获取模型权重中缺少的额外信息,这些信息通常在预训练后很难更改,包括当前信息、代码执行能力、专有信息源的访问等。

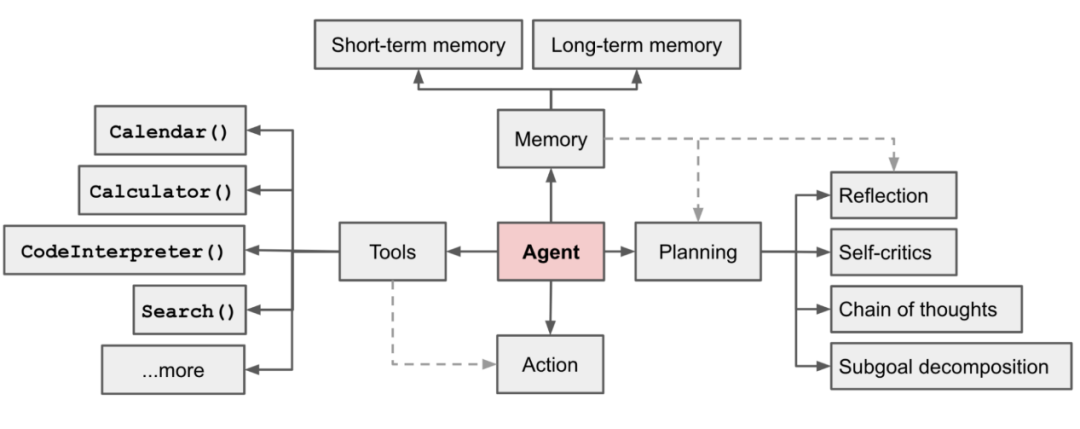

图2 基于LLM的Agent系统概览

-

分析模块:通常通过扮演特定的角色来执行任务,例如程序员、教师等。该模块旨在确定Agent的角色,包含基本信息和行为倾向等“心里信息”,然后将信息写入至配置文件,并被输入至提示中以影响LLM行为。 -

记忆模块:记忆模块在Agent架构设计中起着非常重要的作用。它存储从环境中感知到的信息,并利用记录下来的记忆来促进未来的行动。记忆模块可以帮助Agent积累经验、自我进化,并以更一致、合理和有效的方式行动。 -

规划模块:人们在面对复杂任务时,往往会将其分解为较简单的子任务并逐个解决。规划模块旨在赋予Agent解决复杂问题时的思考和规划能力,致使其行为更加合理、有力和可靠。 -

行动模块:行动模块负责将Agent的决策转化为具体的结果。其会受到其它模块的影响,并与环境直接交互,决定着Agent完成任务的结果。

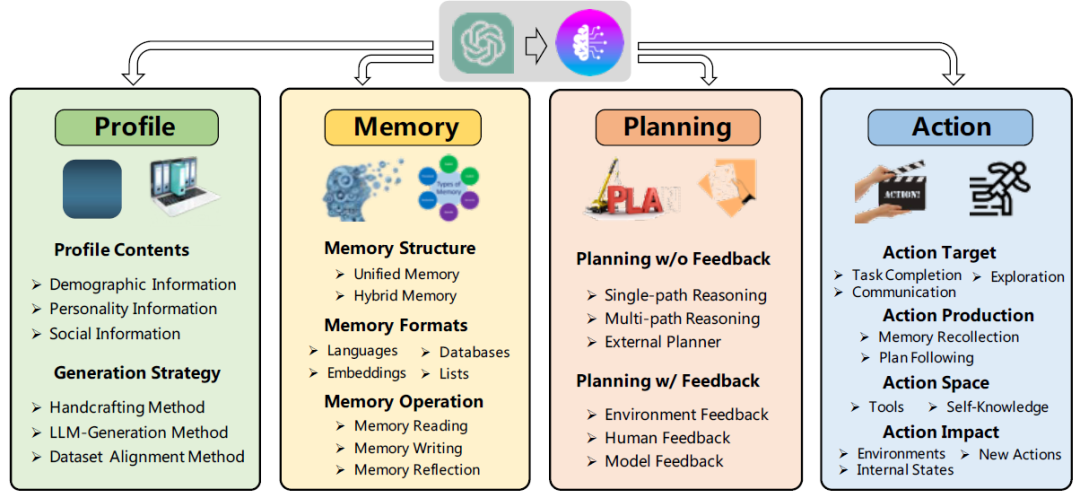

图3 基于LLM的Agent架构设计的统一框架

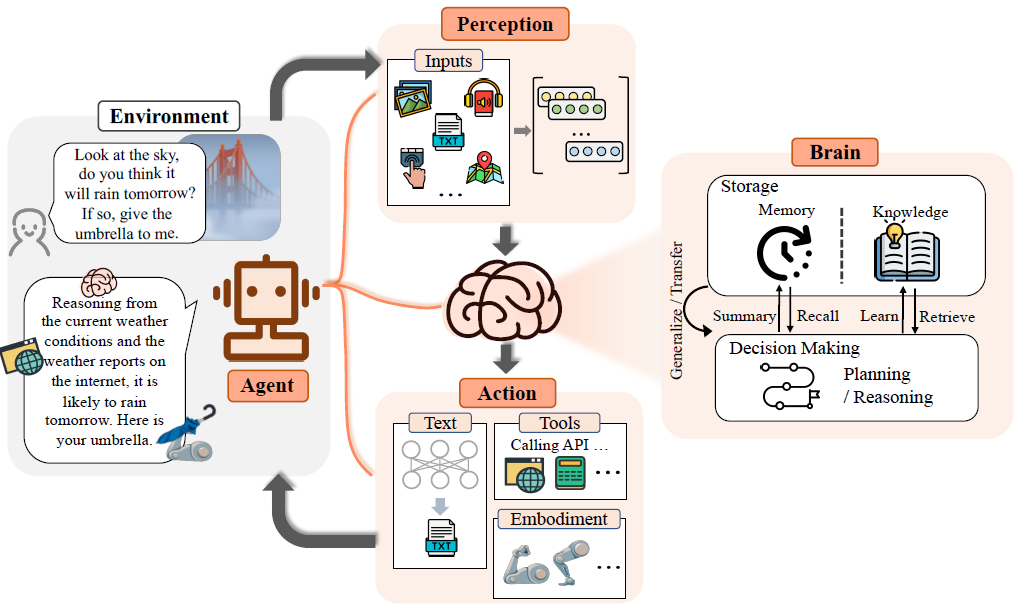

9月份,复旦大学NLP团队推出了《The Rise and Potential of Large Language Model Based Agents: A Survey》综述论文。在该论文中,Agents被定义为由三个部分组成:控制器(Brain)、感知(Perception)和行动端(Action),如图4所示。

-

控制器:由LLM构成,是Agent的核心,承担着存储知识、记忆、信息处理和决策等能力。它可以展示出推理和规划的过程,并能够很好地应对未知任务,展现出Agent的智能性。其包含如下方面的能力:自然语言交互、知识、记忆、推理 & 规划和迁移性 & 泛化性。 -

感知:感知并处理来自外部环境的多模态信息,如纯文本拓展到包括文本、视觉和听觉等多模态领域。其包含如下方面的能力:文本输入、视觉输入、听觉输入和其他输入。 -

行动:赋予行动能力和使用工具的能力,使其能够更好地适应环境变化,通过反馈与环境交互,甚至影响和塑造环境。

图4:基于LLM的Agents的概念框架

3.3 Agents组成

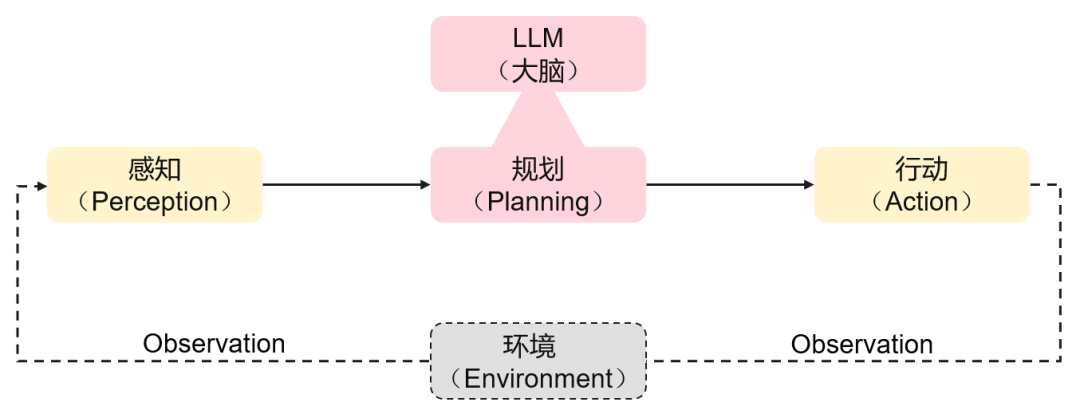

一个LLM Agent的能力大体上达成共识,包含大脑、感知、规划、记忆和行动,行动中包含工具使用。当然,LLM Agent的能力也尚在不断演进。通常,LLM Agent基础架构包含LLM、规划、感知、记忆与行动五个组件部分,其中LLM 扮演了Agent 的“大脑”,在这个系统中提供推理、规划等能力。

图5 LLM Agent决策示意图

LLM+规划,Agents的大脑

图6 Agents的反思框架

Agent通过感知模块感知外部环境,确定环境的相关状态和变化,并将空间扩展至多模态。然后将感知的信息作为后续规划决策的信息来源。Agent支持通过各种设备获取不同的环境信息,其感知空间包含文本、视觉、听觉等多模态领域。

记忆,扩展大模型的对上下文、历史信息、领域知识的处理能力

记忆模块在Agent架构设计中起着非常重要的作用。对Agent系统而言,记忆可以定义为用于获取、存储、保留以及随后检索信息的过程。它可以利用记录下来的记忆来促进未来的行动。记忆模块可以帮助Agent积累经验、自我进化,并以更一致、合理和有效的方式行动。

图7 Agents中的长短期记忆,Lilian Weng.

行动模块将Agent的决策转化为具体的行动,其赋予了Agent行动能力和使用工具的能力,使其能够更好地适应环境变化,通过反馈与环境交互,甚至影响和塑造环境。

人类最显著的特征之一是能够使用工具。人类通过创造、修改和利用外部对象来完成超出身体和认知极限的任务。同样,给 LLM 配备外部工具也可以显著扩展大模型的功能,使其能够处理更加复杂的任务。Agent与大模型的最大区别在于能够使用外部工具协助其完成原本无法完成的工作。Agent具备了自主调用工具的能力,其会在获取到每一步子任务的工作后,都会判断是否需要通过调用外部工具来完成该子任务,并在完成后获取该外部工具返回的信息提供给LLM,进行下一步子任务的工作。

图8 Pi在情感方面的建议,来源于36氪

在游戏中,网易《逆水寒》手游,内置百位AI NPC,其将智能NPC升级至AI NPC,为玩家带来了AI游戏的体验,在游戏中可以体验到AI画师、AI作诗、AI对话剧情,处处皆有AI,让游戏不再呆板。利用Agent的人格属性,使NPC可以进行更智能化、个性化的对话。同时,利用Agent的记忆属性,使NPC可以记住之前对话,并根据对话内容改变之后与玩家的交流方式。AI Agent NPC的引入,极大提升了游戏的娱乐性,并引发了游戏社区的讨论热潮。

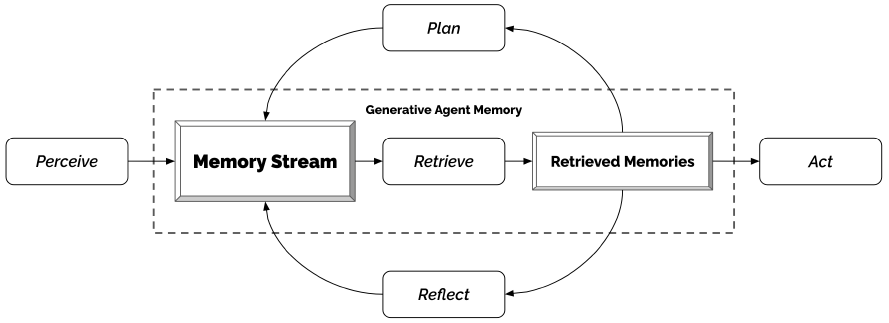

2023年4月,斯坦福大学的研究者们发表了名为《Generative Agents: Interactive Simulacra of Human Behavior》的论文,展示了一个由生成代理(Generative Agents)组成的虚拟西部小镇。该小镇由斯坦福与谷歌联合搭建并命名为《Smallville》,在小镇中,首次创造了多个智能体生活的虚拟环境,其内生活着25个可以模拟人类行为的生成式AI Agent。他们会有工作、会八卦、能组织社交等等。Agent具有类似人的特质、独立决策和长期记忆等功能。在小镇设计中,Agent包含了记忆、反思和规划三大要素。

图9 生成式Agents架构

在上述架构中,Agents感知其环境,并将所有感知保存在称为记忆流的Agents经验的综合记录中。基于他们的感知,该架构检索相关的记忆,并使用这些检索到的行动来确定另一个行动。这些检索到的记忆也被用来形成长期的计划和创建更高级别的反思,这些都被输入到记忆流中以供未来使用。

5 Agents挑战与展望

-

大模型可靠性不足,能力边界不确定,AI Agent对于复杂任务处理不够理想。如处理长期规划和任务拆解时表现欠佳、开销极高等。 -

AI Agent交互的灵活稳定性。在目前的框架中,系统经常会交互信息设计导致系统不稳定,例如身份信息错乱,AI Agent间能力差异导致对话失败等问题。 -

多模态支持,包括AI Agent间交互方式以及环境设置等。目前学术界对大都是对还是通过将其他模态信息转换成文字信息然后交给LLM处理,在针对一些模态的转换,转换成文字,可能会存在时延、信息损失等问题(机器人)。 -

如何让开发者、甚至普通用户,能够方便快捷的创建适用于自己的AI Agent,打造个人专属助手。