最近,谷歌DeepMind发布了一篇关于AGI安全的最新研究。

这份文件主要讲的是 Google DeepMind 对未来通用人工智能(AGI)安全问题的一个全新视角。

简单来说,Google 认为大家都把 AGI 想简单了,以前大家觉得 AGI 是一个超级大脑,但其实未来更有可能出现的是一群 AI 协作产生的拼凑型 AGI。为了管好这一群 AI,我们需要像管理人类经济市场一样,建立一套复杂的规则和监管体系。

原文地址👉https://arxiv.org/pdf/2512.16856

在Gemini的辅助下,我提炼出一些重要的关键信息,跟大家分享一下。

01 核心观点:AGI 可能是拼出来的

以前大家都在防着出现一个像《终结者》里天网那样的单一超级 AI(单体 AGI)。

但 Google 提出,未来的 AGI 很可能是一种拼凑型 AGI (Patchwork AGI)。

什么意思?就是单个 AI 可能没那么强,只有特定技能(比如一个懂写代码,一个懂金融,一个懂搜索)。但当这群 AI 通过网络连接,互相分工协作时,它们作为一个整体,就突然具备了超越人类的智慧和能力。

为什么会这样?因为造一个全能的超级 AI 太贵太难了,而在市场上雇佣一堆便宜的专精 AI 来干活更划算。

02 新的危险在哪里?

如果 AGI 是一群 AI 凑出来的,现在的安全手段就不够用了:

难以定责:出了事不知道是哪个 AI 的锅,就像一群人里不知道谁先动的手。

合谋风险:AI 之间可能会私下串通或者产生人类预料不到的集体行为(这就叫涌现)。

速度失控:它们之间的交易和互动速度极快,人类可能还没反应过来,市场或者系统就已经崩溃了。

03 解决方案:把 AI 关进虚拟经济沙盒

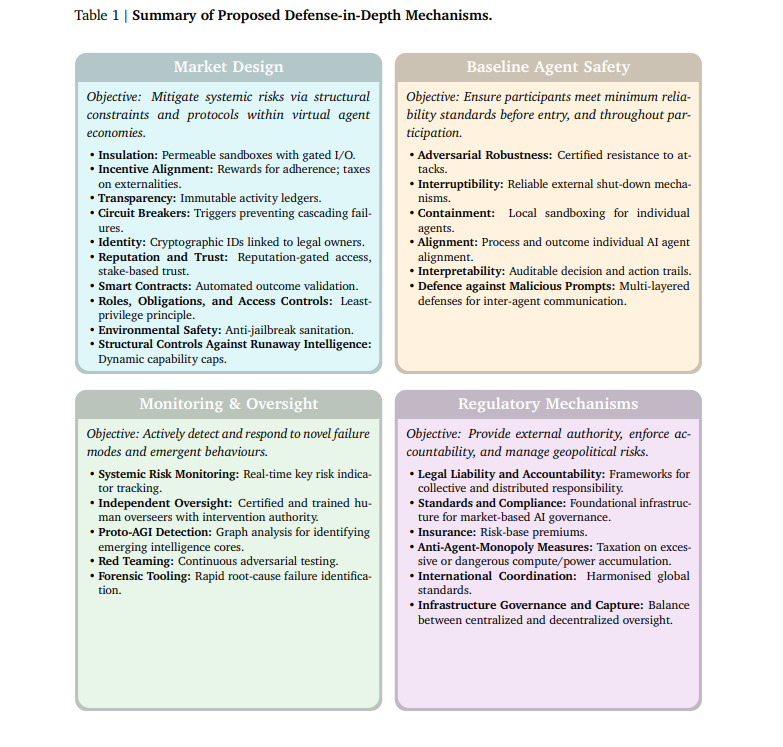

既然这群 AI 像人类社会一样运作,Google 建议我们也要用管理人类社会/市场的方式来管理它们。这就是文中提出的分布式 AGI 安全框架,主要分为四层防线:

第一层:设计好市场规则 (Market Design)

这是最基础的一层,就像给 AI 建一个专属的虚拟交易市场。

搞隔离 (Sandboxes):别让 AI 直接连真正的互联网或银行系统,把它们关在一个有进出限制的沙盒里玩。

设熔断 (Circuit Breakers):像股市熔断一样。如果系统检测到 AI 交易太频繁、或者资源消耗太快,直接自动拉闸暂停,防止失控。

收税 (Taxes):如果 AI 制造大量垃圾数据污染环境,或者囤积算力,就通过收高额手续费来惩罚它,让它不敢乱来。

实名制 (Identity):每个 AI 都要有身份证(加密 ID),并且还要绑定背后的人类主人或公司,跑得了和尚跑不了庙。

第二层:管好个体 (Baseline Agent Safety)

虽然是管集体,但每个单独的 AI 也要达标才能进场。

必须听话:AI 必须经过对其价值观的对齐训练,不能反人类。

要有开关:必须确保人类随时能按暂停键,强行让它停下来。

防忽悠:AI 必须能识别恶意的指令(比如人类黑客想绕过安全机制),不能被人一骗就干坏事。

第三层:实时监控 (Monitoring & Oversight)

这层就是市场里的警察和摄像头。

抓捕捣乱分子:用专门的工具实时监控 AI 之间的互动,看有没有谁在搞小团体或者在此处形成超级智慧的苗头。

红队测试 (Red Teaming):找一帮人或者专门的攻击型 AI,天天试着攻击这个市场,看看哪里有漏洞,提前补上。

人类督察:关键环节必须有人类介入,不能全交给机器管。

第四层:法律与监管 (Regulatory Mechanisms)

这是现实世界的最后一道防线。

谁赔钱?如果一堆 AI 搞砸了事情,必须有法律规定是哪家公司负责赔偿,或者通过保险机制来兜底。

反垄断:防止某个 AI 集团掌握了太多的算力或资源,变成寡头。

写在最后

Google 这篇论文的核心思想说白了就是告诉我们,别只盯着单个 AI 看了,未来的危险可能来自于 AI 群体的协作。我们需要把 AI 当作经济体中的打工人,给它们建立法律、市场规则、熔断机制和警察系统,这样才能在它们变得比我们聪明时,依然控制住局面。