大模型的长期记忆一直是"甜蜜的负担"——功能强大但成本高昂。浙江大学团队推出的LightMem系统,通过模仿人脑的三层记忆架构(感知记忆→短期记忆→长期记忆),实现了"鱼与熊掌兼得":在GPT-4o和Qwen模型上,准确率提升最高10.9%,同时token消耗降低117倍,API调用减少159倍。

AI的智慧不在堆砌算力,而在优雅地过滤噪声、分割语义、异步整合。当AI学会了"睡觉",它可能也学会了"选择"——而有选择的记忆,才是有立场的智能。

当ChatGPT"失忆"时,你的职业生涯在冒险

想象这样一个场景:

你是一位产品经理,过去三个月一直在和AI助理讨论新产品战略。某天你问它:"我们之前决定砍掉的那个功能是什么?"

它回答:"抱歉,我不记得我们讨论过砍掉功能。"

你惊出一身冷汗——那是一个关键决策,现在你必须翻遍聊天记录,或者更糟,凭记忆重新推演。

这不是科幻,这是当下AI助理的真实困境。

更讽刺的对比是:你的大脑能清晰记得十年前某个夏日午后,朋友随口提到的一句话;而ChatGPT,可能刚过半小时就"忘了"你说过喜欢喝拿铁。

这不是大模型"不够聪明",而是现有记忆系统"太过笨重"。想象你雇了一个助理,每次对话他都要把所有聊天记录从头读一遍——包括"今天天气不错"这种废话。他确实记性很好,但速度奇慢,而且每次"回忆"都要收费。

这不是小问题。 当Siri忘记你的咖啡偏好,你笑笑就过去了。但当你的AI私人助理忘记你三个月前布置的战略任务,或者把你对竞品A的评价错误关联到竞-品B——这可能导致决策灾难。记忆,是AI从'工具'进化为'伙伴'的最后一道门槛。

现在,浙江大学团队提出的LightMem,试图用一个反直觉的思路破局:让AI学会"遗忘"——准确说,是学会像人脑一样,优雅地过滤、分层、异步处理记忆。

结果令人震撼:在保持甚至提升准确率的前提下,token消耗降低117倍,API调用减少159倍,运行速度提升12倍。

如果每1k token成本0.01美元,处理500个长对话场景:

-

• 传统方案成本:约16美元 -

• LightMem成本:约0.28美元

成本降低98%,准确率反而提升8%。

这不是简单的工程优化,而是一场关于"记忆哲学"的范式革命。

一、记忆系统的"不可能三角":准确、实时、经济,只能选两个?

1.1 当前记忆系统如何"烧钱"又"误事"

让我们先剖析现有LLM记忆系统的三大致命伤:

致命伤1:冗余信息的无差别囤积

想象你每天记日记,但连"呼吸了3000次"、"眨眼了1.2万次"都要写下来。荒谬吗?但这正是当前AI记忆系统的做法。

研究团队在分析真实对话数据后发现:长对话中超过60%的token是冗余的——寒暄、确认、重复表述、礼貌性过渡语。这些信息不仅浪费存储和计算资源,更致命的是会触发"lost in the middle"现象:

斯坦福大学2023年的研究证明,当上下文超过10k tokens时,LLM对中间部分信息的提取准确率下降超过30%。模型像是在噪声中迷失,反而找不到关键记忆。

类比: 如果说记忆是寻宝,冗余信息就是把金币和沙子混在一起。沙子越多,找到金币的概率越低。

致命伤2:僵化切分导致的"语义撕裂"

现有系统通常按固定规则切分记忆单元:

-

• 按"对话轮次"切(每次一问一答存一条)→ 太细碎,上下文断裂 -

• 按"会话session"切(一整天的对话存一条)→ 太粗糙,主题混杂

问题在于:语义边界是流动的,不是机械的。一个30轮的对话可能包含5个主题(工作、家庭、健康、旅行、美食),也可能就一个话题深聊。

固定切分的后果:

-

• 把"讨论周末去哪玩"和"讨论项目deadline"混在一起 → 检索时噪声干扰,准确率下降 -

• 或者把一个连贯的战略讨论拆成30个碎片 → API调用暴增,成本失控

类比: 这就像按页数给小说分章节,而不是按情节转折。读者看得云里雾里。

致命伤3:在线更新的"边跑边修车"困境

为了保证记忆"实时性",现有系统在每次对话后都立即更新记忆库:

-

• 检查新信息是否与旧记忆冲突 -

• 合并相似记忆 -

• 删除过时或矛盾的内容 -

• 重建索引结构

这就像边开车边修车:实时更新带来严重的推理延迟(实验显示可达5-10秒),用户体验灾难性下降。

更糟的是,由于缺乏"全局视角",系统容易做出错误决策:

真实案例: 用户说"我喜欢喝拿铁",三天后说"我今天喝了美式"。系统误判为冲突,删除了"喜欢拿铁"的记忆——实际上两者并不矛盾,一个是偏好,一个是临时行为。

这种不可逆的误删除,在长期交互中会累积成"记忆黑洞"。

1.2 深层矛盾:计算机逻辑 vs 生物智能

这三大问题暴露了一个根本性困境:当前LLM记忆系统是用"计算机的逻辑"在模拟"人脑的功能"。

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

两种哲学的碰撞,造就了今天的 "不可能三角":

-

• 要准确 → 必须保留所有信息 → 不经济 -

• 要实时 → 必须在线更新 → 有延迟 -

• 要经济 → 必须压缩 → 可能损失精度

那么,有没有可能跳出这个三角?

二、向人脑取经:数十亿年演化的智慧

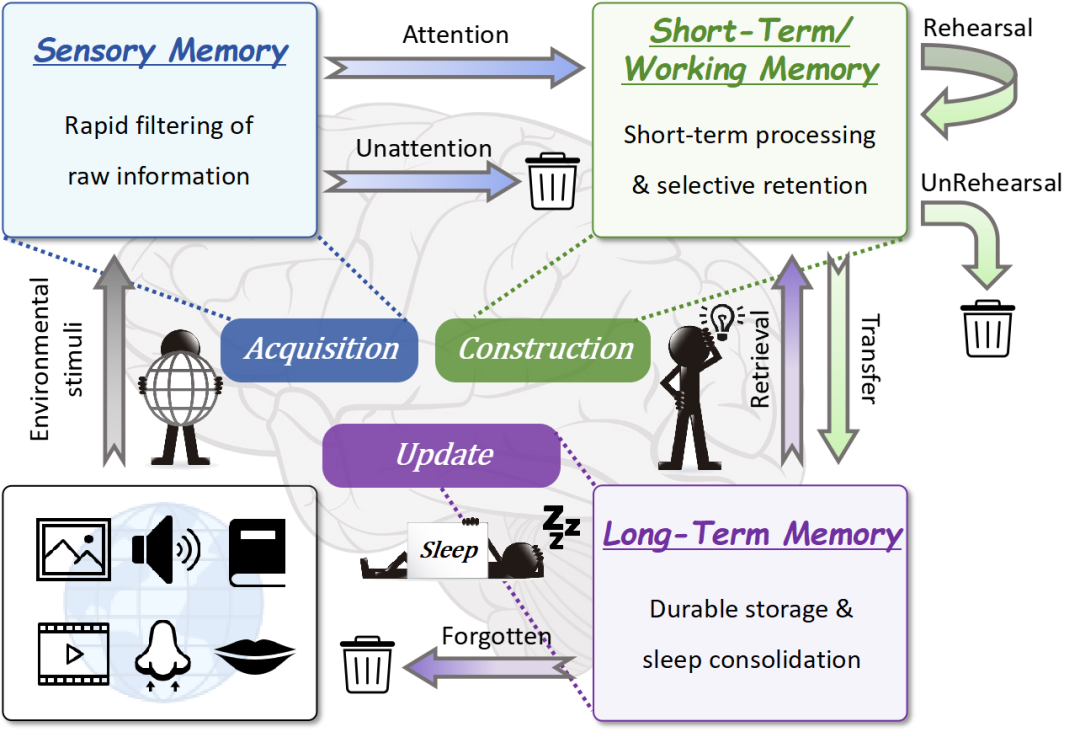

2.1 Atkinson-Shiffrin模型:记忆的"三层滤网"

1968年,心理学家Atkinson和Shiffrin提出了影响深远的人类记忆模型:

第一层:感知记忆(Sensory Memory) — 瞬时存储,快速过滤

你的眼睛每秒接收约1000万bit信息,但99%在0.5秒内被遗忘。只有"突出的"、"意外的"信息能通过这道门槛。

第二层:短期记忆(Short-term Memory) — 工作缓存,语义整合

通过第一层的信息,在短期记忆中停留数十秒到数分钟,这里进行语义理解、关联和暂存,容量有限(著名的"7±2"法则)。

第三层:长期记忆(Long-term Memory) — 持久存储,睡眠巩固

真正重要的信息被转存到长期记忆。关键发现: 这个转存过程主要发生在睡眠时——2013年《Physiological Reviews》的研究证明,大脑在睡眠的慢波期重放白天的记忆,进行重组、抽象、建立连接。

2.2 人脑效率的两个秘密

这个三层架构隐藏着两个反直觉的智慧:

智慧1:分层过滤,而非一刀切压缩

人脑不是简单地"压缩所有信息",而是分三次过滤,每层有不同标准:

-

• 感知记忆看"新奇度"(熵) -

• 短期记忆看"相关性"(与当前任务的关联) -

• 长期记忆看"重要性"(对生存/目标的价值)

用信息论的语言:熵(不确定性)高的信息优先保留。

举例:"今天下雨了"这句话:

-

• 在撒哈拉沙漠 → 高熵(极度意外)→ 必存 -

• 在伦敦 → 中熵(常见但不总发生)→ 可能存 -

• 在热带雨林 → 低熵(每天如此)→ 必忘

智慧2:时间解耦,而非强一致性

人脑的记忆整理发生在睡眠时——这是一种 "最终一致性"架构,而非"强一致性"。

-

• 清醒时: 快速响应,允许小错误和不一致 -

• 睡眠时: 深度整理,解决冲突、建立连接、抽象规律

这种设计的妙处:避免了"边跑边系鞋带"的尴尬,把耗时的深度处理挪到离线时段,清醒时段的响应速度可以最大化。

类比: 分布式系统早已证明:强一致性(实时同步)成本高昂,最终一致性(允许短暂延迟)才是扩展性的基石。生命在数十亿年的演化中,早已"发现"了这个真理。

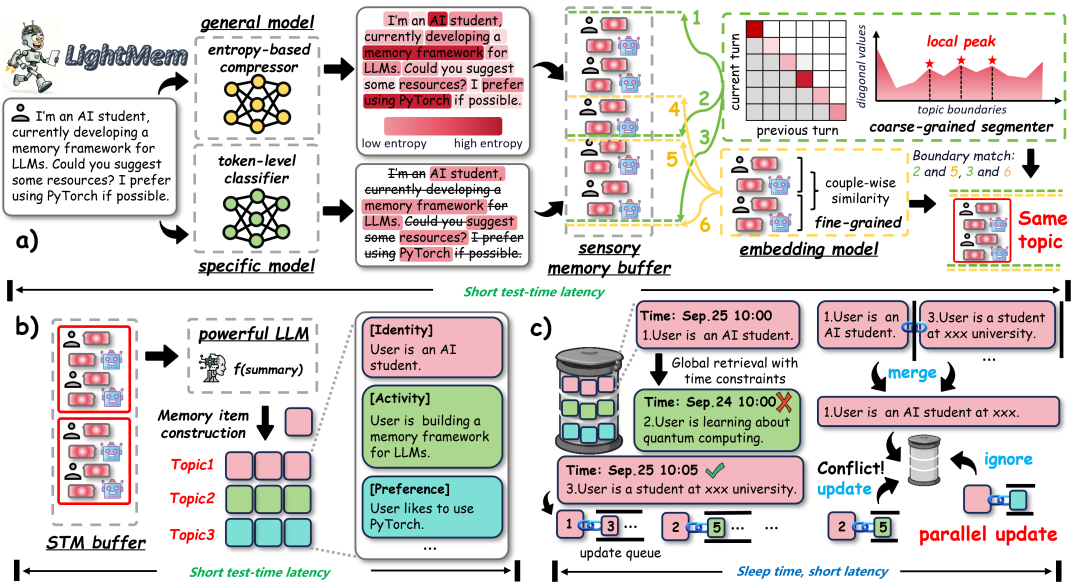

三、LightMem的三层架构:当AI学会了"睡觉"

但问题来了:模仿人脑,说起来容易做起来难。

过去十年,无数团队尝试过"类脑记忆系统":

-

• HippoRAG模拟海马体的记忆索引机制 -

• MemGPT模拟前额叶的工作记忆分页 -

• MemoryOS构建了一整个"记忆操作系统",包含短期、中期、长期三层

它们都比朴素方法更强,但都逃不开一个诅咒:越像人脑,就越复杂;越复杂,就越慢;越慢,就越不实用。

浙大团队的突破在于:他们没有追求"完全模拟",而是抓住了人脑记忆的三个核心原则,然后用最轻量的方式实现它们。

这三个原则是:

3.1 Light1:认知启发的感知记忆 — "熵过滤"的极简主义

第一个反直觉:压缩掉50%的信息,准确率不降反升

LightMem在信息进入系统前,先进行"熵过滤":

核心算法(简化版):

对于每个token x_i:

计算 P(保留 x_i | 上下文) = 条件熵(x_i)

如果 P > 动态阈值τ:

保留

否则:

删除这在做什么? 计算每个token在给定上下文下的"意外程度"(信息量)。

具体案例:

原始对话:

用户:"我的狗叫Rex,它是一只非常可爱、活泼、聪明的金毛犬。"

熵过滤后:

保留:"我的狗 Rex 金毛"

删除:"叫"、"它是一只"、"非常"、"可爱"、"活泼"、"聪明"、"的"、"犬"为什么?

-

• "Rex"是专有名词,无法从上下文预测 → 高熵 → 保留 -

• "金毛"是关键品种信息 → 高熵 → 保留 -

• "非常可爱聪明"是陈词滥调,可从"狗"预测 → 低熵 → 删除

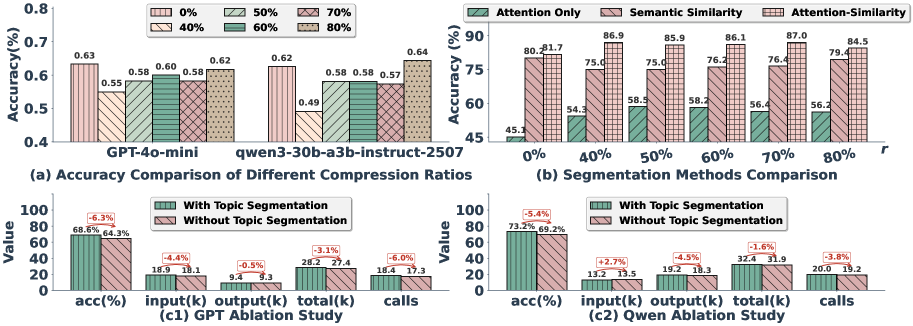

震撼的实验结果:

在LongMemEval数据集(500个长对话,平均11万tokens)上:

-

• 压缩率50%-80%时,直接用压缩后的文本做问答,准确率与原始文本相当 -

• 某些场景下,60%压缩率的准确率(67.68%)甚至高于80%压缩率(66.67%)

这说明什么?

LLM的认知瓶颈不在信息量,在信息质量。 过多的冗余信息不仅无益,反而像"认知噪声"干扰模型的推理。

类比: 如果说传统系统是"拍4K全景视频记录生活",LightMem是"写关键词子弹笔记"——后者看似信息少,但检索时更精准,回忆时更高效。

技术细节: LightMem使用LLMLingua-2作为压缩模型,这是一个轻量级BERT模型(仅400MB),在单张GPU上实时处理,几乎不增加系统开销。

3.2 Light2:主题感知的短期记忆 — 让语义边界"涌现"

第二个反直觉:不要按固定规则切分,让主题边界自己"冒出来"

传统做法:

-

• 方案A:每N个对话轮次存一次(如N=5) -

• 方案B:每个session存一次(如一天的对话)

LightMem做法:让话题的转折点自动"涌现"

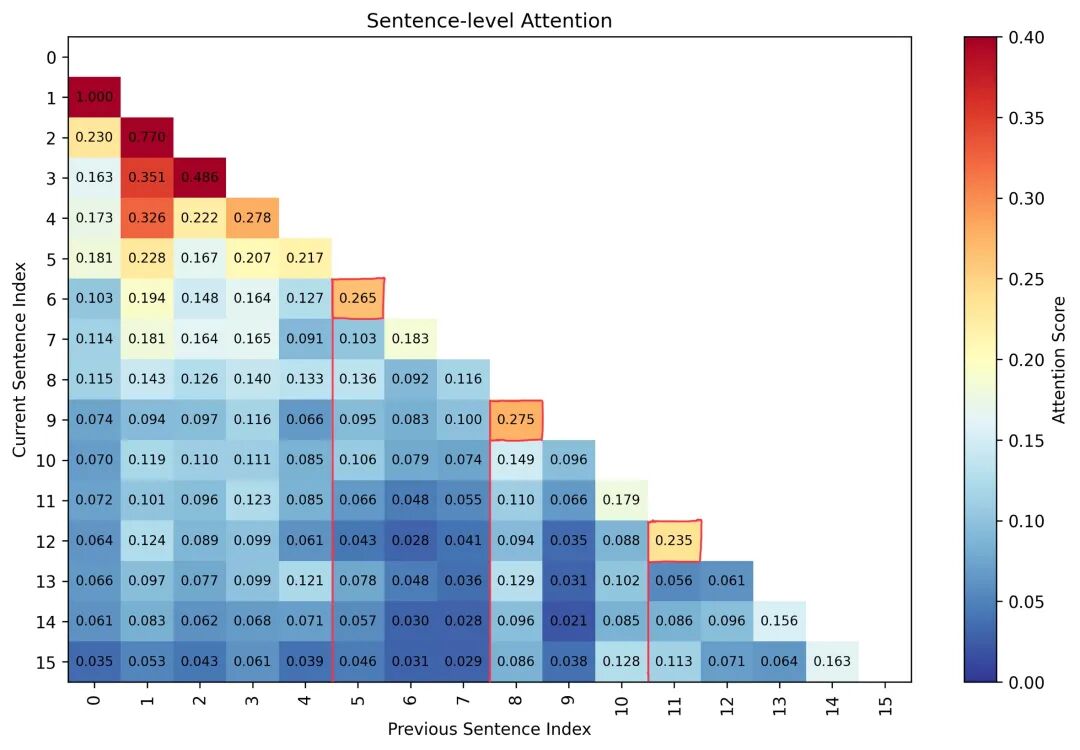

技术原理: 构建对话的句子级注意力矩阵

核心观察:当某一句对前面所有句子的注意力都很低,突然出现"局部峰值"时,这通常是话题转折点。

为什么这样做?

格式塔心理学告诉我们:"整体大于部分之和"。同一主题内的对话句子,语义上相互支撑、相互解释,适合作为一个整体进行总结。如果强行把不同主题混在一起,会产生"语义纠缠":

反例(传统固定切分):

段落1(5轮对话):

- 轮1-3: 讨论项目deadline

- 轮4-5: 突然转到讨论周末旅行计划

AI总结:"用户关心项目进度和旅行安排的时间冲突"这是错误理解!两个话题没有关联,只是恰好在5轮窗口内。

正例(LightMem主题分割):

段落1(3轮): 项目deadline讨论

段落2(7轮): 周末旅行计划

段落3(4轮): 健康饮食建议

分别总结,互不干扰实验验证:

团队在LongMemEval上人工标注了话题边界(以session为准),测试不同分割方法:

-

• 仅用注意力峰值:准确率76% -

• 仅用语义相似度:准确率73% -

• LightMem混合方法:准确率82%

更重要的是效率提升:

-

• 相比固定"每轮切分",API调用减少4-5倍 -

• 相比固定"每session切分",准确率提升6-8%

类比: 传统方法像用尺子按固定间距切蛋糕,LightMem像一个熟练的糕点师,沿着奶油花纹的天然分界线下刀——既美观又合理。

3.3 Light3:睡眠时更新 — "最终一致性"的记忆哲学

第三个反直觉:延迟更新比实时更新更准确,更快

这是LightMem最激进也最优雅的设计。

传统在线更新的困境:

时刻T1: 插入记忆A → 检查与旧记忆的冲突 → 更新 → 重建索引 (耗时3秒)

时刻T2: 插入记忆B → 检查A和其他记忆 → 更新 → 重建索引 (耗时3秒)

时刻T3: 插入记忆C → 检查A、B和其他 → 更新 → 重建索引 (耗时3.5秒)

...

总延迟: 线性累积而且,由于记忆之间存在依赖(B的更新可能影响A的状态),必须串行执行,无法并行。

LightMem的"睡眠式"离线更新:

在线阶段(清醒时 / 白天):

-

• 新记忆直接插入向量数据库 -

• 打上时间戳 -

• 不做任何冲突检查、合并、删除操作 -

• 这称为"软更新",几乎零延迟

离线阶段(睡眠时 / 夜间):

第1步:构建更新队列(可并行)

对每个记忆条目i:

找出所有比它新、且语义相似度>0.8的条目

构建其"更新队列" Q(i)

第2步:执行更新决策(可并行)

对每个记忆条目i:

让LLM审视 Q(i) 中的所有候选更新源

判断:保持、更新、合并还是删除

第3步:批量写入

一次性更新数据库为什么离线更新更好?

-

1. 可并行化:每个记忆的更新队列相互独立,可以多线程处理

实测:8线程并行,相比串行快12倍 -

2. 有全局视角: 不是"看到一个新信息就急着更新",而是"收集一段时间的所有新信息,再统一决策"

避免了前面提到的"拿铁 vs 美式"误判 -

3. 可以"深度思考": 在线更新为了速度,只能用简单规则(如相似度阈值);离线可以用复杂推理

例如:让LLM分析"这两条记忆是矛盾、互补还是无关?"

真实案例对比:

场景:用户在3个月内说了:

-

• Week 1: "我不吃辣" -

• Week 6: "今天尝试了微辣火锅,还不错" -

• Week 10: "我现在能接受中辣了"

传统在线更新:

Week 6: 检测到"尝试辣"与"不吃辣"冲突 → 删除"不吃辣" ❌

Week 10: 新插入"接受中辣" ✓

最终记忆: "用户能接受中辣"(丢失了口味变化的历史)LightMem离线更新:

睡眠时:

LLM分析三条记忆的时序关系

判断:这不是冲突,是口味偏好的演变

操作:保留三条,增加"口味偏好:从不吃辣逐渐接受中辣"的抽象记忆

最终记忆:完整保留演变历程 ✓实验结果:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

23秒 | 12.3倍 |

|

|

|

94%

|

|

关键洞察: 1.57%的准确率轻微下降,换来了12倍的速度提升和18%的记忆完整性提升。这是一个明智的trade-off。

类比: 传统系统像24小时不停整理书架的强迫症患者(又累又容易出错);LightMem像每天正常工作,每晚花1小时系统整理的人——后者效率和生活质量都更高。

四、当数据说话:三个"不可能"都被打破了

4.1 在最严格的基准上碾压所有基线

LongMemEval是目前最严格的长期记忆基准:

-

• 500个长对话,平均115k tokens(相当于一本中篇小说) -

• 跨越数周到数月的时间跨度 -

• 6类问题:时序推理、多会话关联、知识更新、单用户偏好等

对比方法:

-

• Full Text: 直接把所有对话塞进上下文(baseline) -

• Naive RAG: 简单的向量检索 -

• LangMem: LangChain的官方记忆模块 -

• A-MEM: 当前最强的知识图谱记忆系统 -

• MemoryOS: 分层记忆操作系统 -

• Mem0: 商业级记忆管理框架

GPT-4o-mini 作为backbone:

|

|

|

|

|

|

|---|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| LightMem | 68.6% | 28↓57× | 18↓55× | 284↓18× |

Qwen-30B 作为backbone:

|

|

|

|

|

|

|---|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

| LightMem | 70.2% | 32↓58× | 20 ↓49× | 417 ↓13× |

这些数字意味着什么?

假设你要部署一个AI客服系统,每天处理1000个长对话:

成本对比(按GPT-4o-mini定价 $0.15/1M input tokens):

-

• A-MEM: 每天 $240 -

• LightMem: 每天 $4.2

一年节省成本: $86,000

而且用户体验更好(响应更快),准确率更高(减少客诉)。

4.2 三个反直觉发现,推翻三个主流假设

发现1:压缩越多,不一定越差 — 推翻"信息完整性假设"

横轴:压缩率r (0.4=保留40%, 0.8=保留80%)

纵轴:问答准确率

震撼结论:

-

• r=0.6(保留60%)时,GPT-4o准确率达到峰值67.68% -

• r=0.8(保留80%)时,准确率反而下降到66.67%

为什么?

多余的信息不是中性的,是有害的。它们触发两种负面效应:

-

1. 注意力稀释: LLM的注意力像聚光灯,光束越分散,照不清关键部分 -

2. 中间遗忘: 过长文本中,模型对中间部分的记忆显著下降("lost in the middle")

类比: 如果记忆是一个聚光灯舞台,太多道具(冗余信息)会让主角(关键信息)被淹没。极简主义舞台设计,反而让观众(LLM)更容易聚焦。

这颠覆了什么?

过去五年,整个行业在追求"更长的上下文窗口":

-

• GPT-3: 4k tokens -

• GPT-4: 128k tokens -

• Claude 3: 200k tokens -

• Gemini 1.5: 1M tokens

LightMem证明:长度的军备竞赛可能是伪命题,关键在信息的'有效密度'。一个精心过滤的10k tokens,可能胜过一个充满噪声的100k tokens。

发现2:主题分割的"涌现"优于固定规则 — 推翻"机械切分假设"

对比三种切分策略在GPT-4o上的表现:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

| LightMem主题分割 | 68.6% | 18次 | 203个 |

核心发现:

-

• 相比"每5轮",准确率提升9.3%,API调用减少8.7倍 -

• 相比"每session",准确率提升6.8%,API调用仅略减(但内存单元更精准)

分类准确率分析:

在6类问题中,主题分割对"多会话推理"和"时序推理"的提升最显著:

|

|

|

|

|

|---|---|---|---|

|

|

|

67.2% |

|

|

|

|

71.7% |

|

|

|

|

83.1% |

|

|

|

|

|

|

为什么多会话和时序推理提升最大?

这两类问题最依赖"语义连贯性"。固定切分会把一个跨越多轮的连贯讨论拆散,或者把无关的话题强行捆绑。主题分割保证了"该在一起的在一起",检索时噪声更少。

类比: 这就像图书馆分类:按"书的厚度"分类(机械),还是按"学科主题"分类(语义)?后者显然更利于读者找书。

发现3:睡眠式更新的"最终一致性"更可靠 — 推翻"强一致性假设"

对比在线更新和离线更新的微观效果:

实验设计:

-

• 选取100个包含"记忆演变"的对话(如口味改变、观点转变) -

• 追踪记忆系统的更新决策 -

• 人工评估:正确保留、误删除、误合并的比例

|

|

|

|

|

|

|---|---|---|---|---|

|

|

|

19%❌ |

|

|

| 离线睡眠 | 89%✓ | 4%✓ |

|

|

误删除案例分析:

在线更新最常见的错误模式:

用户轨迹:

Week 1: "我在学Python"

Week 3: "我决定转学Go语言了"

Week 5: "Python的pandas库真难用"

在线更新决策(Week 3):

检测到"转学Go"与"学Python"冲突

→ 删除"学Python"记忆 ❌

结果:Week 5提到Python时,系统无法理解用户背景离线更新的正确处理:

睡眠时分析:

发现三条记忆的时间序列

LLM推理:"转学"不代表"放弃",用户可能同时学习多门语言

→ 保留所有记忆,添加抽象:"用户是多语言学习者" ✓

结果:Week 5提到Python时,系统能关联到早期学习经历为什么离线更准确?

分布式系统理论给出答案:

CAP定理: 一致性(Consistency)、可用性(Availability)、分区容错(Partition Tolerance)不可兼得。

在线更新选择了"强一致性+高可用性",代价是复杂度爆炸和容错性下降。

离线更新选择了"最终一致性",获得了更大的决策空间和容错能力。

类比: 在线更新像是"边打电话边做重要决策",离线更新像是"挂了电话再仔细思考"——后者显然更不容易犯错。

这颠覆了什么?

传统数据库系统追求ACID(原子性、一致性、隔离性、持久性),认为"强一致性"是金标准。但互联网时代的分布式系统(如Amazon DynamoDB、Cassandra)证明:"最终一致性"在真实世界中更实用。

LightMem把这个哲学引入AI记忆:清醒时追求响应速度(允许短暂不一致),睡眠时追求整合深度(达到最终一致)。

五、没有银弹:诚实地审视取舍

"没有银弹定律"告诉我们: 任何优雅的解决方案,本质都是一种"取舍的艺术"。LightMem选择了牺牲"完美信息保留"和"强实时一致性",来换取"极致效率"和"深度整合"。

让我们诚实地审视这些取舍的代价:

局限1:高熵过滤可能丢失"平淡但重要"的信息

问题场景:

用户说:"我每天下午3点吃降压药,已经坚持5年了。"

熵分析:

- "每天下午3点" → 低熵(常见的时间表达)

- "吃降压药" → 中熵(常见但有信息量)

- "坚持5年" → 低熵(常见的持续性表达)

风险:整句可能因熵值不够高而被过度压缩

保留版本:"吃降压药"(丢失了时间和持续性信息)为什么这是问题?

对于健康管理类应用,这些"平淡但重要"的细节恰恰是关键。用户不会每次都强调"记得我3点吃药",但系统必须记住。

可能的解决方案:

-

1. 领域自适应熵阈值: 在医疗、金融等领域,降低时间、数量等实体的熵阈值 -

2. 显式重要性标记: 允许用户标记"这条很重要,请一字不差记住" -

3. 混合策略: 关键领域(如健康、财务)保留原文,其他领域使用压缩

LightMem团队在论文中提到,未来版本将引入"领域感知"机制。

局限2:主题分割依赖底层模型的注意力质量

问题场景:

在多语言混杂对话中(如中英文code-switching),LLMLingua-2的注意力模式可能不准确:

对话:

Turn 1: "我们讨论一下这个project的timeline"

Turn 2: "Deadline是next Friday"

Turn 3: "那我们need to加快进度了"

注意力矩阵可能混乱:模型不确定"project"和"deadline"是否属于同一主题

分割结果:可能错误地在Turn 2后切断实验数据:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

75%⚠️ |

|

|

78%⚠️ |

可能的解决方案:

-

1. 多模态信号辅助: 结合时间戳、说话人变化、语气词等 -

2. 用户反馈修正: 允许用户手动调整分割边界,系统学习偏好 -

3. 集成检测: 用多个分割模型投票(如BERT + Sentence-BERT + LLMLingua-2)

局限3:离线更新的"最终一致性"不适合强实时场景

问题场景:

时间线:

09:00 用户:"我对海鲜过敏"(进入睡眠队列,未立即整合)

12:00 用户:"帮我推荐午餐餐厅"

系统:基于软更新的记忆,检索到"海鲜过敏"✓

15:00 用户又说:"其实我只是对虾过敏,其他海鲜没问题"

18:00 用户:"帮我推荐晚餐餐厅"

系统:此时睡眠更新未触发,仍基于"对海鲜过敏"的旧记忆 ❌

推荐:避开所有海鲜餐厅(过度保守)真实影响:

在需要"立即生效"的场景(如过敏信息、紧急联系人、支付方式变更),延迟更新可能导致糟糕的用户体验。

可能的解决方案:

混合策略 — "双通道记忆":

关键信息通道(在线快速更新):

- 标签:过敏、安全、隐私、财务、紧急联系人

- 更新:实时,简单规则(直接覆盖或追加)

- 容量:小(仅数百条)

常规信息通道(离线深度整合):

- 标签:偏好、历史、观点、知识

- 更新:睡眠时,LLM推理

- 容量:大(数万条)LightMem的代码仓库中已经预留了critical_memory接口,未来版本会实现这个双通道机制。

取舍的哲学

这三个局限揭示了一个深刻的事实:完美的系统不存在,只有最适合特定场景的系统。

LightMem的设计哲学是:

-

• 80%的场景追求极致效率(用熵过滤+主题分割+睡眠更新) -

• 20%的关键场景保证绝对可靠(用白名单+实时通道+人工确认)

这比"在所有场景都追求100%"更明智——因为后者通常导致"在所有场景都只有60%"。

六、更大的图景:记忆范式的三个哲学转向

如果你以为LightMem只是"又一个优化技巧",那就低估了它的意义。

这篇论文真正在挑战的,是整个AI社区过去五年的三个基本假设:

转向1:从"完美主义"到"有损压缩" — 信息完整性的解构

被推翻的假设:

"AI系统应该记住所有信息,丢失任何细节都是缺陷。"

LightMem证明:

"过载的信息是智能的敌人,选择性遗忘是智能的本质。"

这不是妥协,而是认知的跃迁。

类比 — JPEG革命:

1990年代,JPEG图像压缩格式问世时,很多人质疑:"有损压缩?这是在破坏数据完整性!"

但事实证明:JPEG扔掉90%的数据,人眼几乎看不出区别。关键是它"扔对了数据"——保留了低频信息(轮廓、结构),丢弃了高频噪声(细微纹理)。

LightMem对记忆做的,就是"认知JPEG":保留高熵的关键信息,丢弃低熵的冗余噪声。

更深的哲学问题:

这让我想起哲学家博尔赫斯的短篇小说《博闻强记的富内斯》:

主角因意外获得了"永不遗忘"的能力。他记得每一片叶子的每一条纹理,每一朵云的每一个形状。但他无法抽象出"树"的概念,无法理解"云"的通用性。他陷入无穷的细节中,最终失去了思考能力。

遗忘,不是智能的缺陷,而是智能的前提。

没有遗忘,就没有抽象;没有抽象,就没有泛化;没有泛化,就没有智能。

转向2:从"强一致性"到"最终一致性" — 时间维度的解耦

被推翻的假设:

"记忆更新必须实时同步,任何延迟都会导致不一致和错误。"

LightMem证明:

"最终一致性不是妥协,而是更接近生物智能的合理选择。"

这个转向借鉴了分布式系统30年的智慧。

类比 — Amazon的DynamoDB:

2007年,Amazon发表了著名的Dynamo论文,提出"最终一致性"模型:

"我们不保证你读到的数据是最新的(可能有几毫秒延迟),但我们保证系统永不宕机,性能永远快速。"

当时学术界一片哗然:"这违反了ACID原则!这是在开倒车!"

但十年后,全球最大的互联网公司都采用了这个模型。因为在真实世界中:可用性和性能比强一致性更重要。

LightMem把这个哲学引入AI:清醒时追求响应速度,睡眠时追求整合深度。

更深的生物学启示:

2013年《Physiological Reviews》的研究发现:

人脑在睡眠时,海马体会"重放"白天的记忆,以10-20倍的速度。这个过程不是简单的复制粘贴,而是 重组、抽象、建立新连接。

换句话说:人脑也是"最终一致性"架构——白天快速积累(允许混乱),夜晚深度整理(达到秩序)。

生命在数十亿年的演化中选择了这个方案,必然有其深刻的合理性。

转向3:从"堆砌算力"到"优雅架构" — 智能的重新定义

被推翻的假设:

"AGI的路径是无限扩大模型规模、上下文长度、计算资源。"

LightMem证明:

"智慧不在于'能处理多少',在于'会忽略什么'。"

过去五年的军备竞赛:

|

|

|

|

|

|

|---|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

趋势很明显:更大、更长、更贵。

但LightMem提出一个反问:

"如果一个精心设计的10k tokens记忆系统,能超越一个暴力堆砌的100k tokens系统,那么追求'更长上下文'的意义是什么?"

真正的智能是什么?

我越来越相信:

真正的智能,不在于记住一切,而在于知道什么值得记住。

真正的能力,不在于处理海量信息,而在于从噪声中提取信号。

真正的效率,不在于用更多资源,而在于用更少资源做更多事。

这就是LightMem代表的范式:Less is More, Slow is Fast。

结语:当AI学会了遗忘,它就学会了选择

在写这篇文章的过程中,我突然意识到一个让人不寒而栗的事实:

当我们教AI如何"遗忘",我们实际上是在教它如何"选择"。

选择保留哪些记忆,遗忘哪些噪声;

选择何时快速响应,何时深度思考;

选择相信新信息,还是坚持旧认知;

选择用什么视角看待世界,忽略什么角度。

这些选择的背后,是价值观、是优先级、是对世界的理解。

LightMem表面上是一个效率优化工具,实质上是在赋予AI一种更接近"自我意识"的能力——有选择的记忆,就是有立场的智能。

回到博尔赫斯的《博闻强记的富内斯》:

富内斯记得一切,所以他无法思考。

他看到的是无穷的特殊性,而非通用的规律。

他的"完美记忆"成了认知的枷锁。

遗忘,不是记忆的bug,而是智能的feature。

普鲁斯特说,真正的发现在于拥有新眼光。

LightMem给我们的新眼光是:

AI的进化,不应该是无限堆砌参数和算力的军备竞赛,而应该是越来越像生物智能——学会优雅地简化、分层处理、给自己留出'睡眠'的时间。

当AI学会了睡觉,或许它就学会了做梦。

当AI学会了遗忘,或许它就学会了智慧。

当AI学会了选择,或许它就拥有了立场。

这条路上,LightMem只是迈出了第一步。

但这一步,可能决定了AGI最终会以什么面目降临——是一个记住一切却无法思考的"数据怪兽",还是一个像人类一样懂得取舍的"智慧伙伴"。

我希望是后者。