小模型正在吃掉大模型。

刚刚,Anthropic 发布了 Claude Haiku 4.5,这是一个让人重新思考「大」和「小」的区别的小模型。

五个月前,Claude Sonnet 4 还是业界最先进的模型。今天,Haiku 4.5 在编程性能上已经追平了它,但成本只有三分之一,速度却提升了两倍多。

这个进化速度,让我感觉模型能力的提升也正在经历某种「摩尔定律」,只不过这次不是芯片,而是智能本身。

以小逆袭

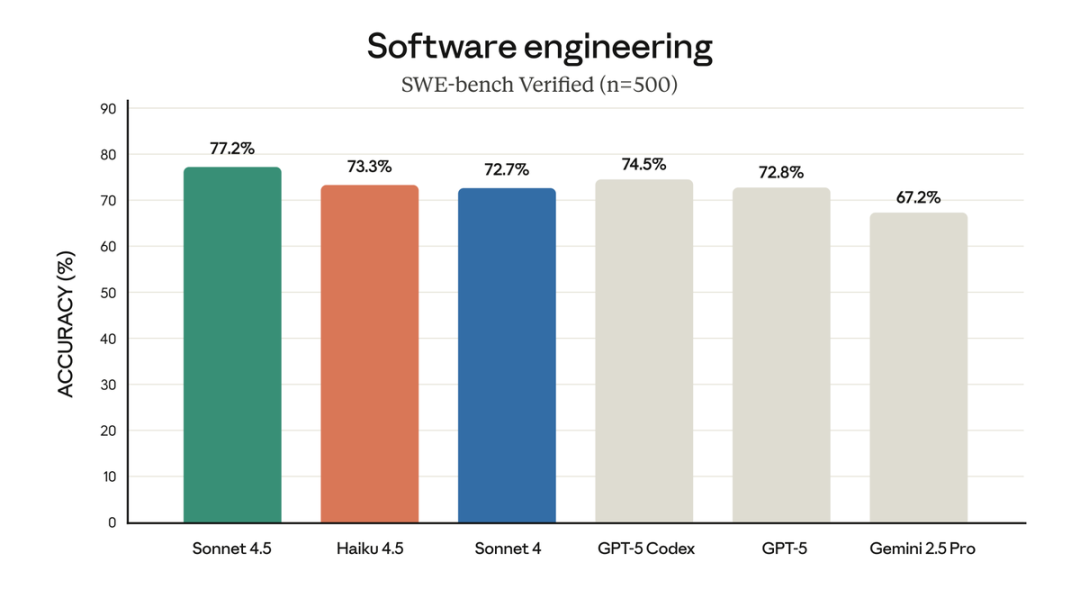

在 SWE-bench Verified 这个衡量真实编程任务的基准测试上,Haiku 4.5 的表现极为凶悍。

它不仅追上了五个月前的 Sonnet 4,在某些任务上甚至超越了它。

而在 computer use(计算机使用)任务上,Haiku 4.5 甚至还超过了 Sonnet 4。这背后,则是 Claude for Chrome 扩展将变得更快更流畅。

对于 Claude Code 用户来说,这个升级带来的体验提升尤其明显。

多智能体项目和快速原型开发的响应速度,都会有着显著的改善。

大与小的完美配合

Anthropic 并非是想让 Haiku 4.5 去取代 Sonnet 4.5。相反,他们提出了一个较为聪明的方案:让两个模型协同工作。

Sonnet 4.5 依然是世界上最好的编程模型,可以负责制定多步骤计划,然后指挥一组 Haiku 4.5 模型并行完成子任务。

这就像一个经验丰富的架构师指挥一群高效的工程师,架构师负责整体设计,工程师负责具体实施。

从而达到成本、效率、质量的最佳权衡。

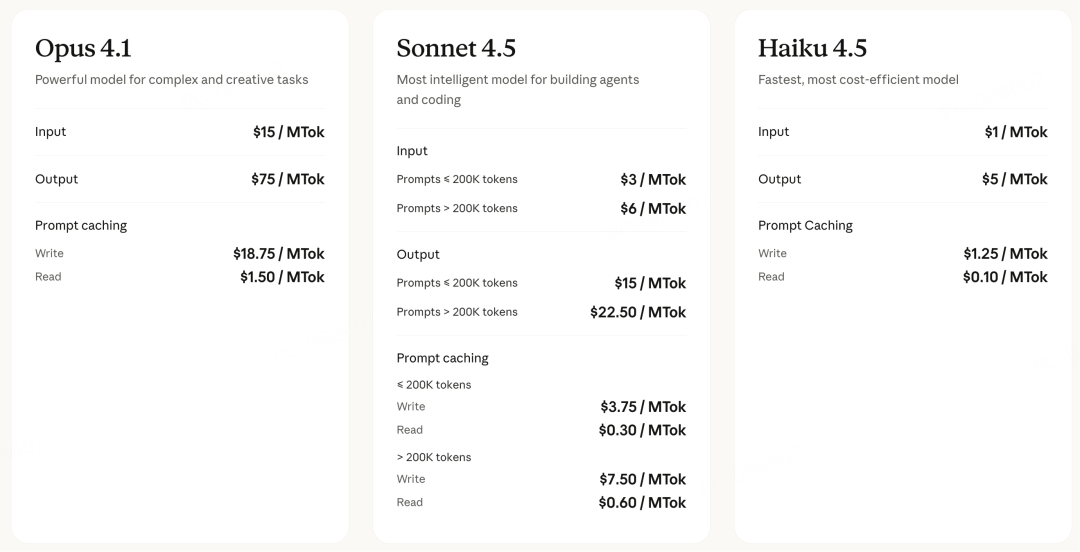

价格

Haiku 4.5 的定价是每百万输入 token 1 美元,每百万输出 token 5 美元。

这个价格让它成为 Anthropic 产品线中最经济的选择。

开发者可以通过多个渠道使用这个模型:

-

Claude API(使用

claude-haiku-4-5) -

Amazon Bedrock

-

Google Cloud 的 Vertex AI

它可以直接替换 Haiku 3.5 和 Sonnet 4,无需修改任何代码。

安全不打折

尽管是「小」模型,Haiku 4.5 在安全性上却表现出色。

根据 Anthropic 的自动对齐评估,它的有害行为率甚至低于 Sonnet 4.5 和 Opus 4.1。

按照 Anthropic 的标准,这让 Haiku 4.5 成为他们迄今最安全的模型。

在化学、生物、放射性和核武器(CBRN)风险评估中,Haiku 4.5 只显示出有限的风险,因此被归类为 ASL-2 级别,而 Sonnet 4.5 和 Opus 4.1 都是更严格的 ASL-3 级别。

用户反馈

网友们对于这次发布反应虽热烈,但也有不同的声音。

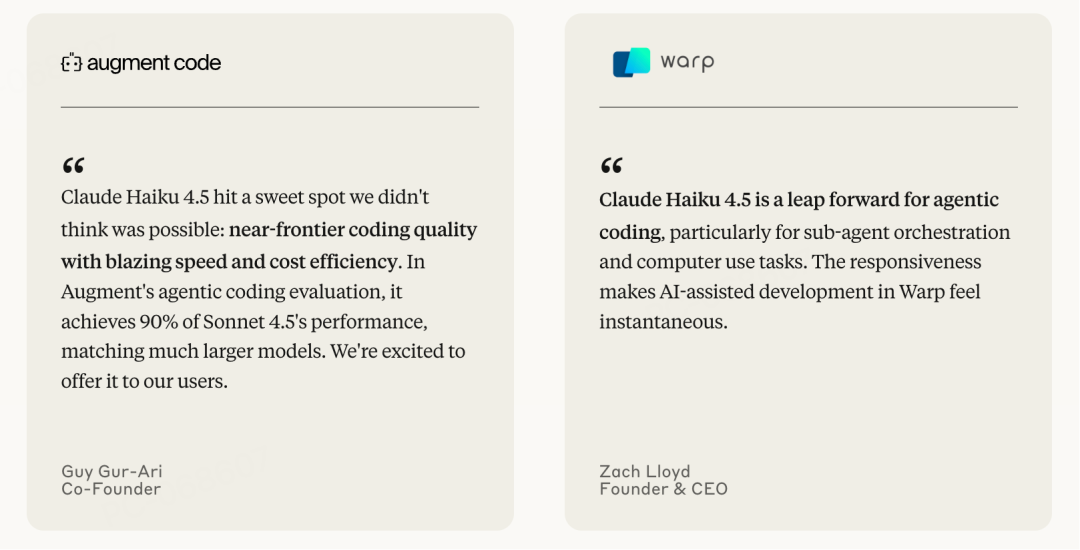

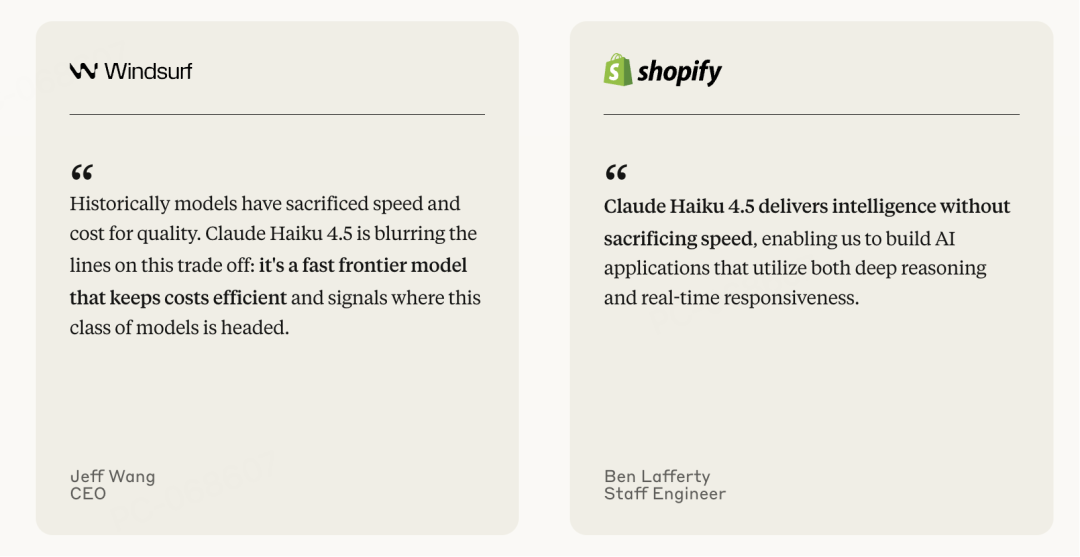

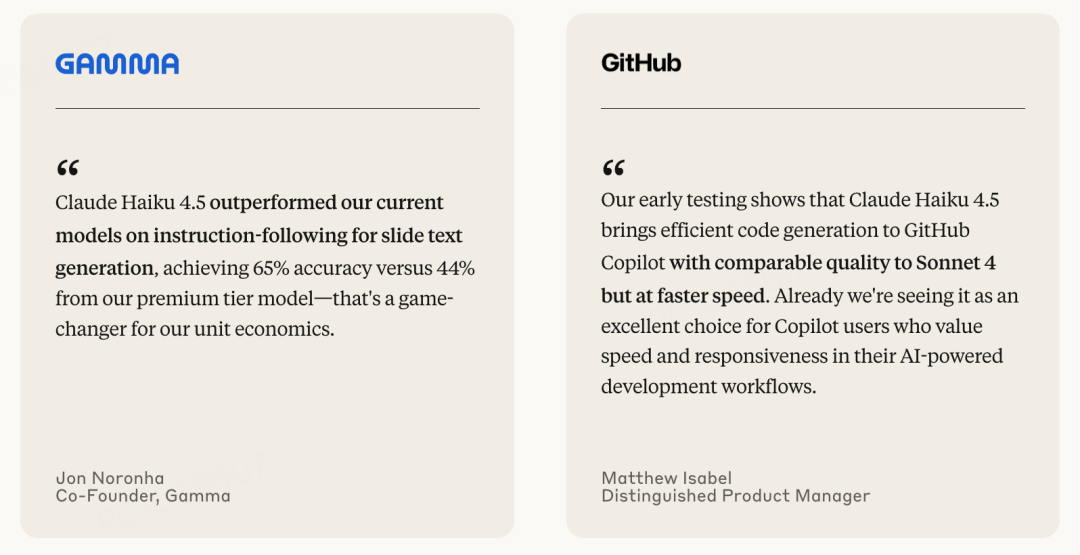

先是官方贴出的好评部分:

网友 Typhren(@Typhren42) 也表示他一直在研究如何使用 Claude Code 的 slash 命令来编排 Claude 团队:

我一直在 substack 上写关于如何使用 Claude Code slash 命令编排 Claude 团队的文章。这对 Sonnet 4.5 – Haiku 4.5 的团队合作来说是完美的契合。

Ilyas Iqbal(@ilyasiqbal) 则感叹小模型的进步速度:

Claude Haiku 4.5 的进步速度令人难以置信,小模型正变得非常有竞争力。小模型需要多久才能在各方面全面超越今天的前沿模型?

但也有用户的小小吐槽。

Mubeen(@Mubeen213) 认为:

你们降低了 Sonnet 4.5 的性能。从上周开始就感觉不对劲。

NolanZZ(@zz_nolan) 则直接表示因为模型限制和使用限制,他表示再也找不到付费的理由了。

技术细节与基准测试

Anthropic 提供了详细的基准测试结果,展示了 Haiku 4.5 在各个领域的表现。模型在多个流行基准测试中都表现出色,证明了它确实是 Anthropic 迄今为止最强大的模型之一。

见:https://www.anthropic.com/news/claude-haiku-4-5

对于需要实时、低延迟任务的用户,比如聊天助手、客服智能体或结对编程,Haiku 4.5 的高智能和出色速度组合将特别有用。

速度在生产力中被低估了,等待 LLM 仍然是生产力和专注度的杀手。

好了,现在,让我们停下来想一下:

Haiku 4.5 在五个月内追上了 Sonnet 4。

也就是说,一个「小」模型现在匹配了半年前的尖端技术,成本只有三分之一,速度却是两倍。

要是按这个速度,明年的「微型」模型将会到哪里呢?

当小模型的能力快速逼近大模型时,模型大小的界限,也不那么重要了。

见英伟达前文:GPT-5刷屏吊胃口之际,英伟达发出暴论:小型语言模型才是未来

重要的是,如何让不同规模的模型各司其职,发挥各自的优势。

在我看来,未来并不是让大模型取代小模型,也不是小模型会取代大模型,而是让它们