Paper:YOLO-World: Real-Time Open-Vocabulary Object Detection

Abs:https://arxiv.org/abs/2401.17270

Code:https://github.com/AILab-CVC/YOLO-World在自然图像与视频目标检测与识别领域,传统方法通常在预定义类别的数据集上训练,无法识别数据集中未出现的目标类别,缺乏零样本检测能力,识别能力有限。

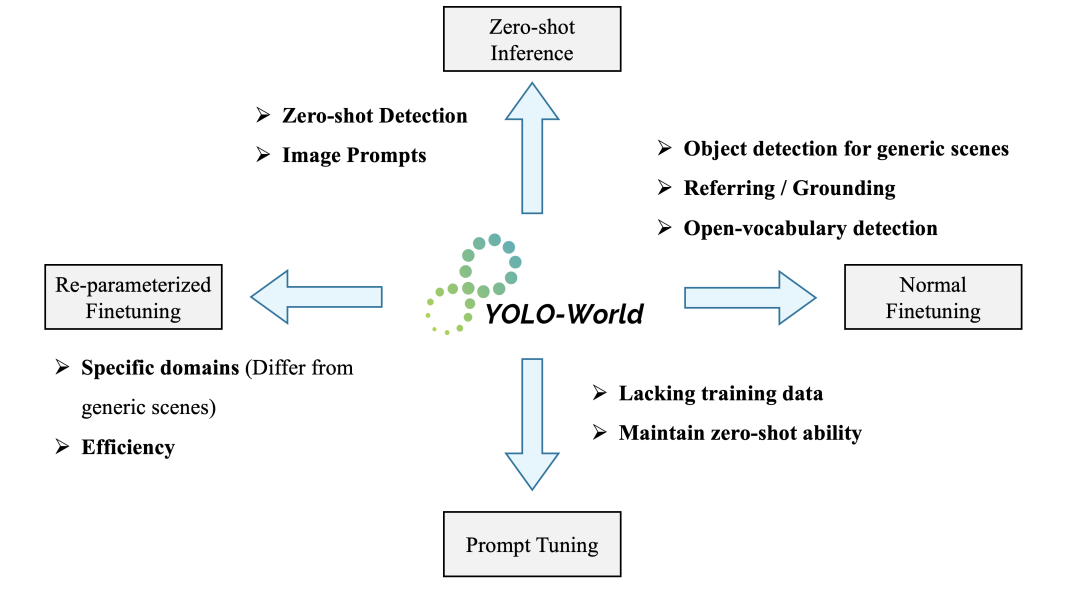

来自Tencent AI Lab、ARC Lab、Tencent PCG 以及华中科技大学的研究者们在 CVPR 2024 上提出了基于视觉语言建模的开放词汇YOLO-World模型,并探索针对YOLO检测器的大规模数据预训练方法,赋予 YOLO 模型零样本检测能力与语言理解能力,在推理速度和零样本检测精度上均领先先前工作。

YOLO-World模型目前已经在腾讯内部多项业务中落地,并与海外多家公司达成商业合作。