在人工智能的世界里,我们经常遇到一些令人困惑的概念和术语。它们在AI的发展中扮演着关键角色,但同时也可能因为它们的专业性而让非专业人士感到难以理解。比如大家一直在说的AI和机器学习ML与深度学习DL是什么关系?transformer和bert都是模型吗?GPT和ChatGpt说的是一回事?模型微调和预训练差别是啥等等,这些概念频繁出现在与大型AI模型相关的讨论中,经常容易看的人云里雾里的。

本文将带您走进这些术语背后的世界,取最容易让人看懵的概念组做对比,以浅显易懂的方式解释它们的含义和区别,以及它们分别在AI领域的主要工作内容!希望能够帮助大家减少对这些术语的误解,让读者对AI领域的技术有更清晰的认识!话不多说,开始!

通识类

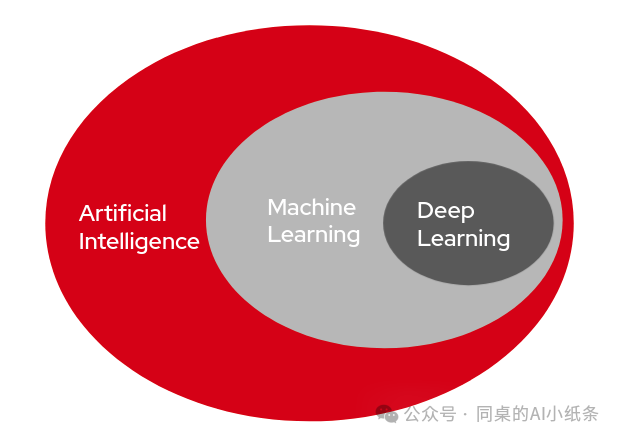

人工智能(AI) vs. 机器学习(ML)vs.深度学习(DL ):

人工智能(Artificial Intelligence):广义上的AI指的是计算机系统能够执行传统上需要人类智能才能完成的任务,如视觉识别、语音识别、决策和翻译等。AI 包括了各种方法和技术,不仅仅限于机器学习。

机器学习(Machine Learning):ML是AI的一个子领域,通过使用算法和统计模型,使计算机能够从数据中学习和做出预测或决定,计算机系统能够在数据中逐步改进其性能,而不需要显式编程。

深度学习(Deep Learning):是机器学习的一个子集,它使用类似于人脑的神经网络结构来学习复杂的模式。

总结:AI>Machine Learning>Deep Learning

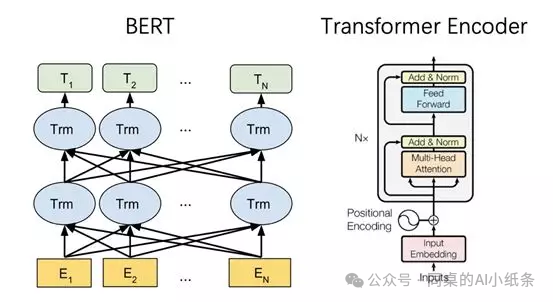

Transformer vs. BERT:

Transformer 是一种用于自然语言处理任务的神经网络架构,以其独特的自注意机制和并行化能力著称,使其在处理长序列文本时效率显著提升。

BERT(Bidirectional Encoder Representations from Transformers)是基于Transformer架构的一种语言模型,特别强调双向上下文的预训练,从而在各种NLP任务中获得了显著的性能提升。

神经网络(Neural Networks) vs. 神经网络架构(Neural Network Architectures)

神经网络:是模仿人脑神经元的计算模型。

神经网络架构:是神经网络的具体设计,如卷积神经网络(CNN)或循环神经网络(RNN)。

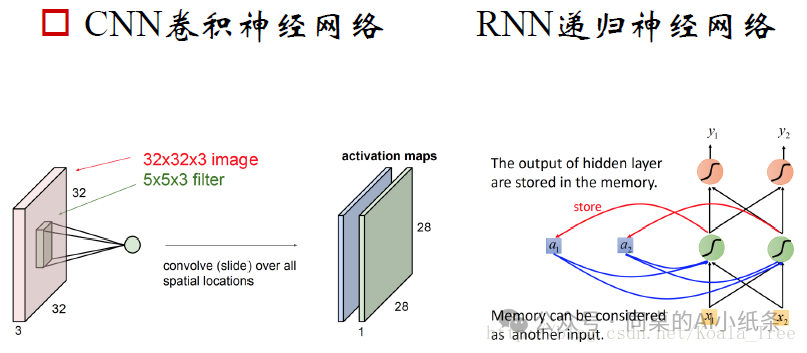

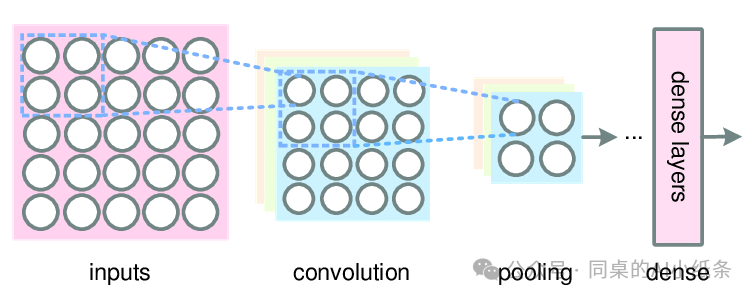

卷积神经网络(CNNs) vs. 循环神经网络(RNNs)

卷积神经网络(CNNs):主要用于处理图像数据,擅长捕捉图像中的空间信息和特征。通过卷积层和池化层来捕捉局部特征和图像的空间层次信息。

循环神经网络(RNNs) 主要用于处理序列数据(如时间序列、自然语言文本),通过循环结构来捕捉和存储序列中的时间依赖关系和上下文信息。尤其适用于处理时间序列数据或序列数据,例如语音识别和语言建模,擅长捕捉序列中数据的时间依赖性。

大语言模型(LLM)vs. 大模型

大语言模型专注于处理文本数据

大模型可以处理多种类型的任务,除了文本外还有图像识别和数据分析等。

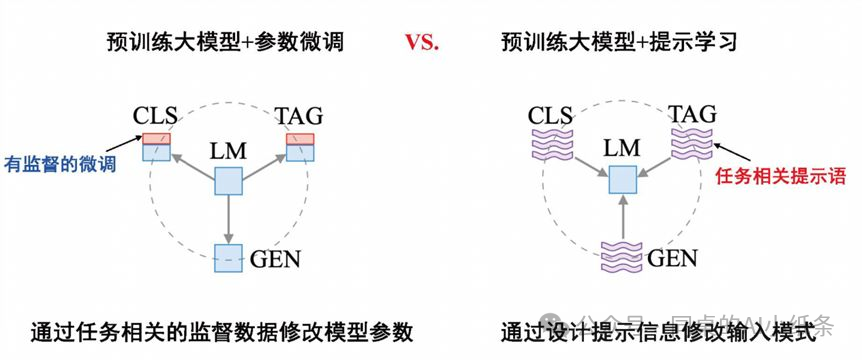

预训练 vs. 模型微调 vs. 提示学习:

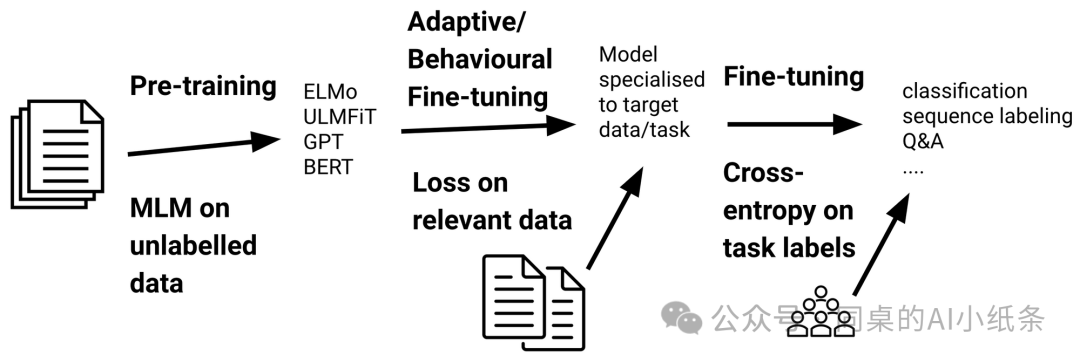

预训练:是在大规模数据集上训练一个通用模型,这个过程通常耗时较长且计算资源密集,以便为后续具体任务提供一个良好的初始状态,是在大量无标注数据上训练模型以捕捉语言的一般规律和结构。

模型微调:是在预训练模型的基础上,进一步针对具体任务和小规模数据集进行训练和调整,从而提高模型在特定任务上的性能。

提示学习:是通过给模型提供特定的引导信息(即提示词),来优化其在某个任务上的表现,无需对整个模型进行完全微调,从而更灵活高效地调整模型行为。

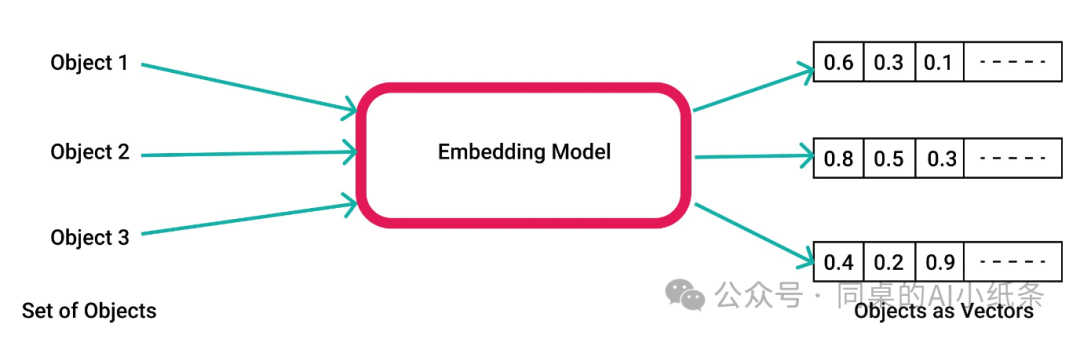

Embedding 是一种将离散的、高维的信息(如单词、图像)映射到连续的、低维的实数向量空间中的技术,以便于机器学习模型处理和理解。

向量模型 是一种将信息(如文档、单词、用户等)表示为向量以进行计算的数学模型,常用于检索、分类和聚类等任务,其中经典例子包括在文本领域提到的词向量模型Word2Vec。

简而言之,embedding是一种更广泛的概念,而词向量模型是实现embedding的一种具体方式。

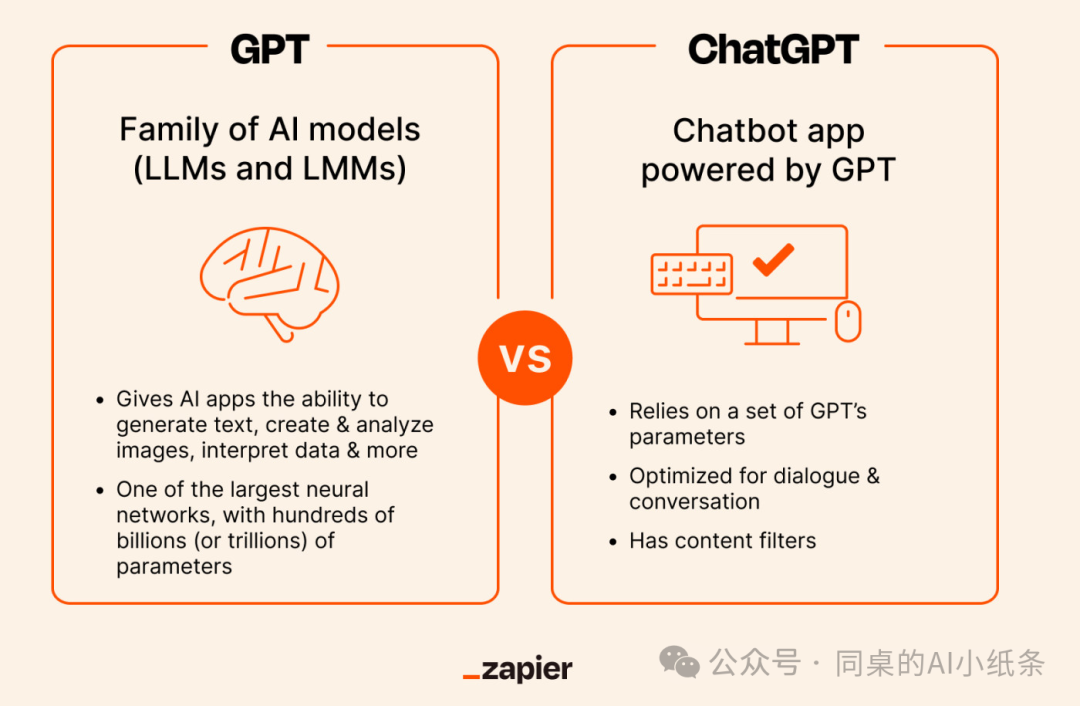

GPT vs. ChatGPT

GPT代表Generative Pre-trained Transformer,是一种模型架构

ChatGPT是基于GPT模型开发的特定产品,主要用于生成文本

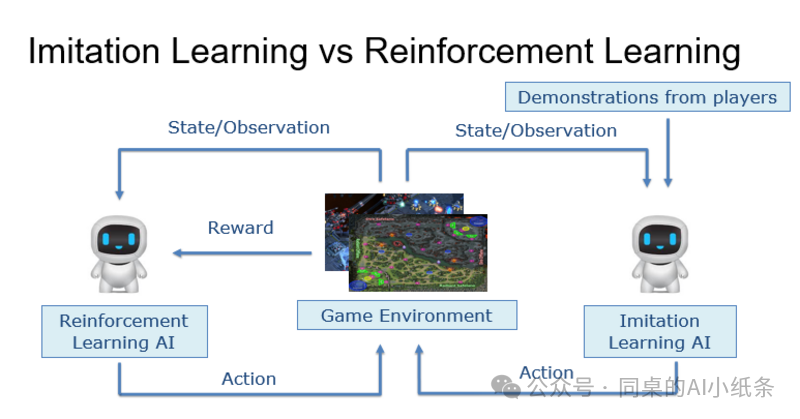

强化学习(Reinforcement Learning)vs.模仿学习(Imitation Learning):

强化学习是通过与环境的交互来学习最佳行为的模型,通常涉及奖励和惩罚。

模仿学习是一种学习方法,其中智能体通过观察专家的行为来学习任务。

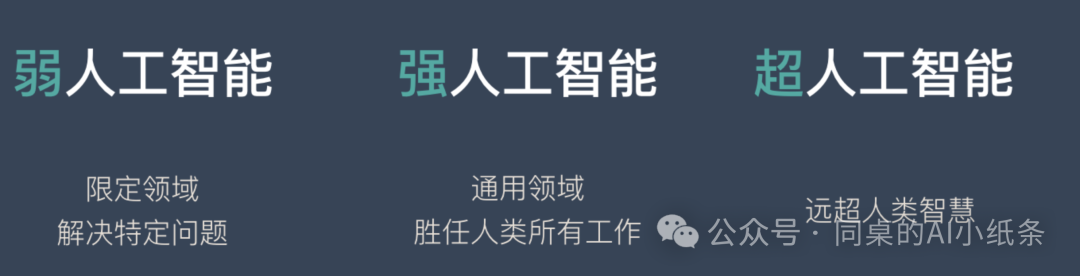

强AI vs. 弱AI

强AI(Artificial General Intelligence, AGI):假设计算机系统具有与人类相似的广泛认知能力,能够理解、学习和适应任何任务。

弱AI:专注于具体任务的系统,如图像识别、语言翻译,处理特定问题,而不是全方位认知。

模型训练类

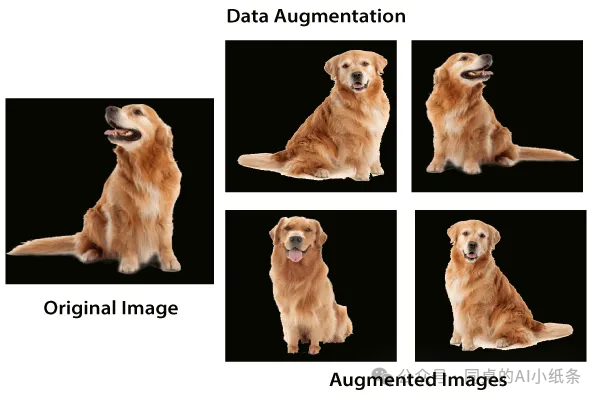

数据增强(Data Augmentation)vs.合成数据(Synthetic Data)

数据增强:通过变换现有数据来增加数据集多样性的技术。

合成数据:通过模拟或生成技术创建的数据,用于训练模型。

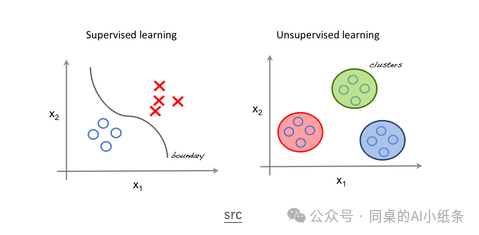

有监督学习 vs. 无监督学习

有监督学习:指通过具有已知标签的数据,也就是有标记的数据进行训练,模型学习从输入到输出的映射关系。简单说就是可以通过学习历史数据的的分类,给新的数据分类。

无监督学习:使用无标签的数据进行训练,模型发现数据中的结构和模式,常用于聚类和降维。简单说就是历史数据没规律,没分类,没达标,模型请你帮我找

算法(Algorithm)vs.模型(Model)

算法:解决问题或执行任务的一系列步骤。

模型:基于数据训练得到的算法的实例,用于进行预测或决策。

训练数据集 vs. 测试数据集

训练数据集:用于训练机器学习模型的数据,模型通过这些数据调整内部参数。

测试数据集:独立于训练数据集,用于评估模型性能的数据,确保模型能够推广到未见过的数据上。

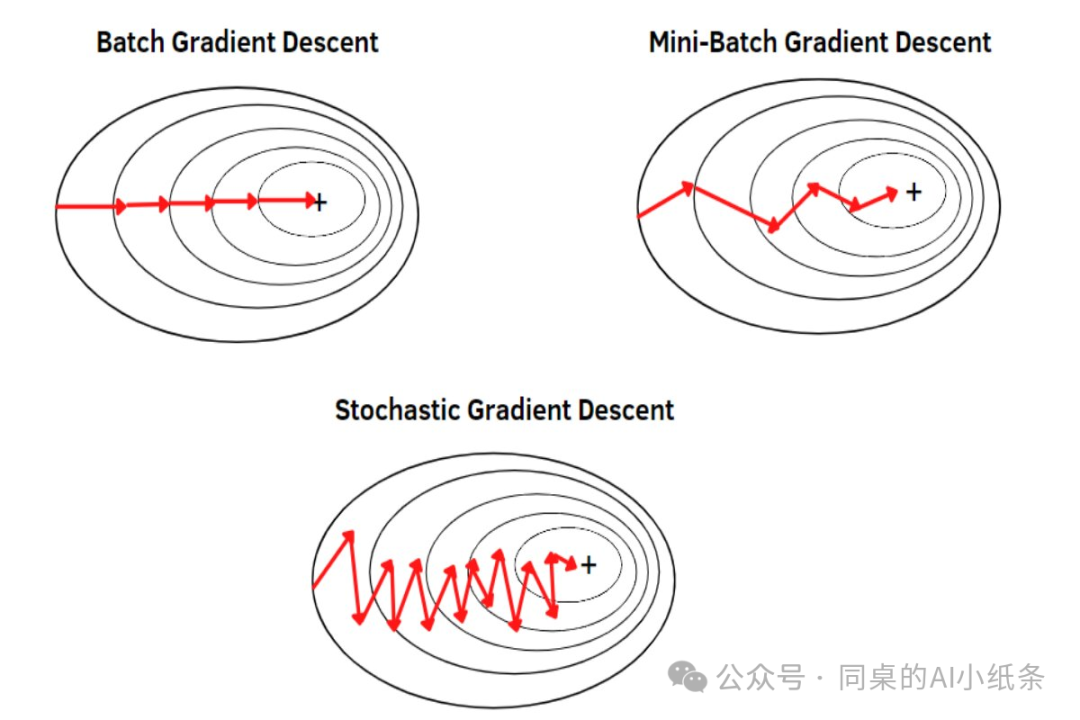

梯度下降 vs. 随机梯度下降 vs. 小批量梯度下降

梯度下降(Batch Gradient Descent):全量数据进行梯度计算和参数更新。

随机梯度下降(SGD, Stochastic Gradient Descent):每次只使用一个样本进行梯度计算和参数更新。

小批量梯度下降(Mini-batch Gradient Descent):每次使用一小批样本进行梯度计算和参数更新,兼具批处理和随机梯度下降的优点。

过采样 vs. 欠采样

过采样(Oversampling):在数据不平衡的情况下,通过增加少数类样本的数据量来平衡数据集。

欠采样(Undersampling):在数据不平衡的情况下,通过减少多数类样本的数据量来平衡数据集。

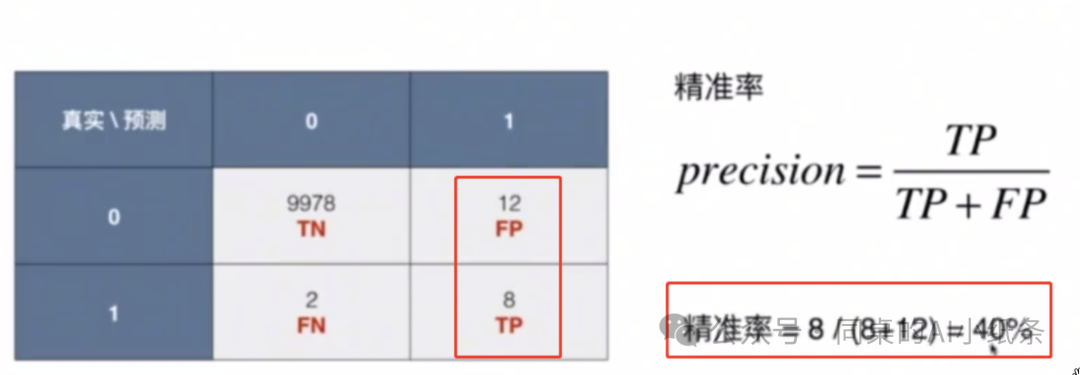

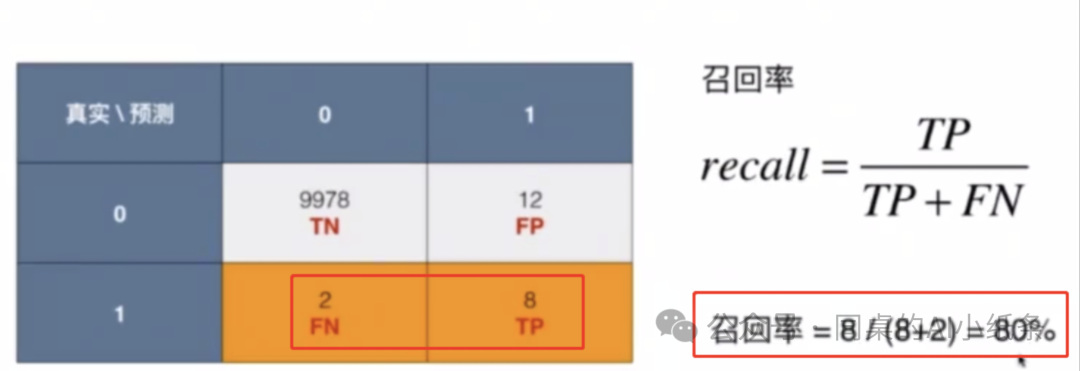

精确度(Precision)vs.召回率(Recall)

精确度(Precision):指模型正确预测为正的样本占所有预测为正的样本的比例。

召回率(Recall):是指模型正确预测为正的样本占所有实际为正的样本的比例。

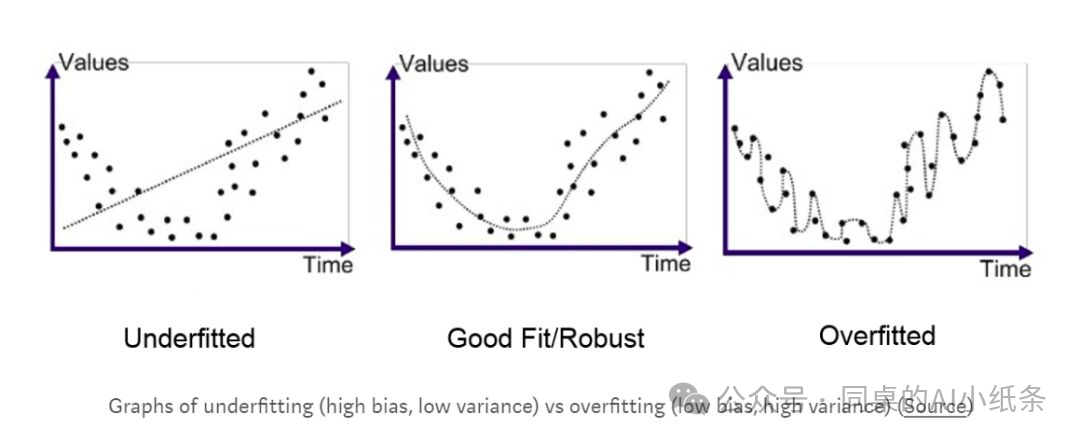

泛化 vs 过拟合 vs. 欠拟合

泛化:是指模型对新、未见过的数据做出准确预测的能力,说的是模型准不准。

过拟合:模型过度复杂,以至于在训练数据上表现很好,但在测试数据上表现较差。,因为模型学到了训练数据中的噪音和细节。

欠拟合:模型过于简单,模型未能捕捉数据的潜在模式,在训练数据和新数据上都表现不佳。

优化 vs. 正则化

优化:指找到模型参数,使得某个损失函数最小化的过程。常用的优化算法有梯度下降等。

正则化:是防止模型过拟合的一种技巧,通过在损失函数中加入惩罚项,限制模型对训练数据的过度拟合。常见的正则化技术有L1正则化和L2正则化。

特征(Feature)vs.特征工程(Feature Engineering)

特征:数据的一个可观测属性,用于进行分析或预测。

特征工程:选择、构建和优化特征的过程,以提高模型的性能。

数据挖掘(Data Mining)vs.数据科学(Data Science)

数据挖掘是从大量数据中通过算法发现模式的过程。

数据科学是一个更广泛的领域,包括数据挖掘、数据可视化、统计分析等。

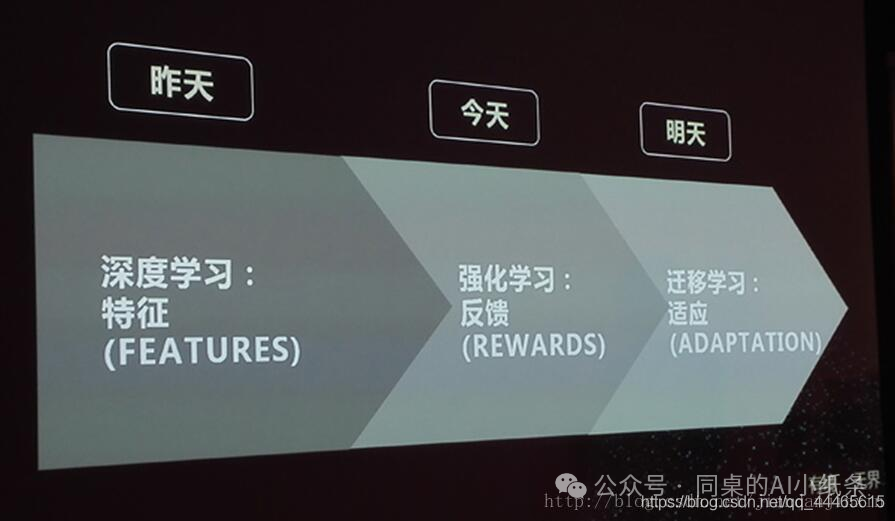

强化学习(Reinforcement Learning)vs.迁移学习(Transfer Learning)

强化学习是让智能体通过与环境的交互来学习最佳行为的算法。

迁移学习是将一个任务上学习到的知识应用到另一个相关任务上的方法。

计算机视觉(Computer Vision)vs.图像处理(Image Processing):

计算机视觉是使计算机能够从图像或多维数据中解释和理解视觉世界的研究领域。

图像处理是应用算法对图像进行修改或改进的技术。

自然语言处理(Natural Language Processing, NLP)vs.自然语言理解(Natural Language Understanding, NLU):

自然语言处理是计算机与人类语言交互的领域,包括语言翻译、语音识别等。

自然语言理解是NLP的一个子领域,专注于使计算机能够理解语言的含义。

端到端学习(End-to-End Learning)vs.管道式学习(Pipeline Learning):

端到端学习是指模型从输入直接学习到输出,无需手动设计特征。

管道式学习是指数据通过一系列预定义的步骤或模块进行处理,每个步骤专注于特定的任务。

知道就很厉害类

美女与野兽问题 vs. 蒙提霍尔问题

美女与野兽问题:描述了两个拉布拉多犬分别被评为美女与野兽的情况,探讨随机事件的概率。

蒙提霍尔问题:源于一个游戏节目,涉及在三个门中选择一个,并分析在更换选择后提高获胜概率的情况。

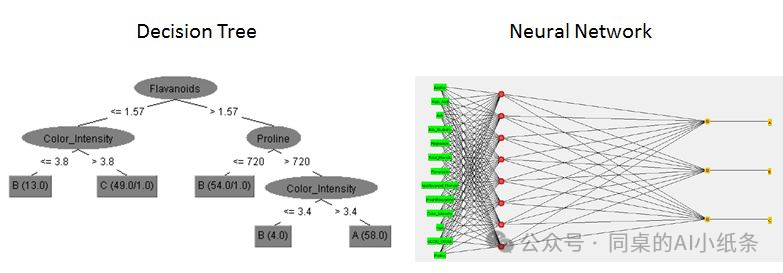

感知机(Perceptron)vs.决策树(Decision Tree)vs. 神经网络(Neural Network):

感知机(Perceptron)是一种简单的线性二分类模型,适用于线性可分数据,可以认为是神经网络的单层形式。

决策树(Decision Tree)是一种非线性模型,通过树状结构进行决策,用于分类和回归,利用树状结构进行递归分割,根据特征值进行分支,直至达到预设条件,适用于特征间具有明显逻辑关系的问题。

神经网络(Neural Network)是模拟人脑神经元工作原理的复杂模型,通过多层非线性变换,能够学习并解决包括非线性在内的多种复杂分类和回归任务。

卷积(Convolution)vs.池化(Pooling):

卷积操作在深度学习中用于提取图像特征,通过滤波器与输入数据进行卷积。

池化操作用于降低数据的空间维度,通常用于减少计算量和提取主要特征。

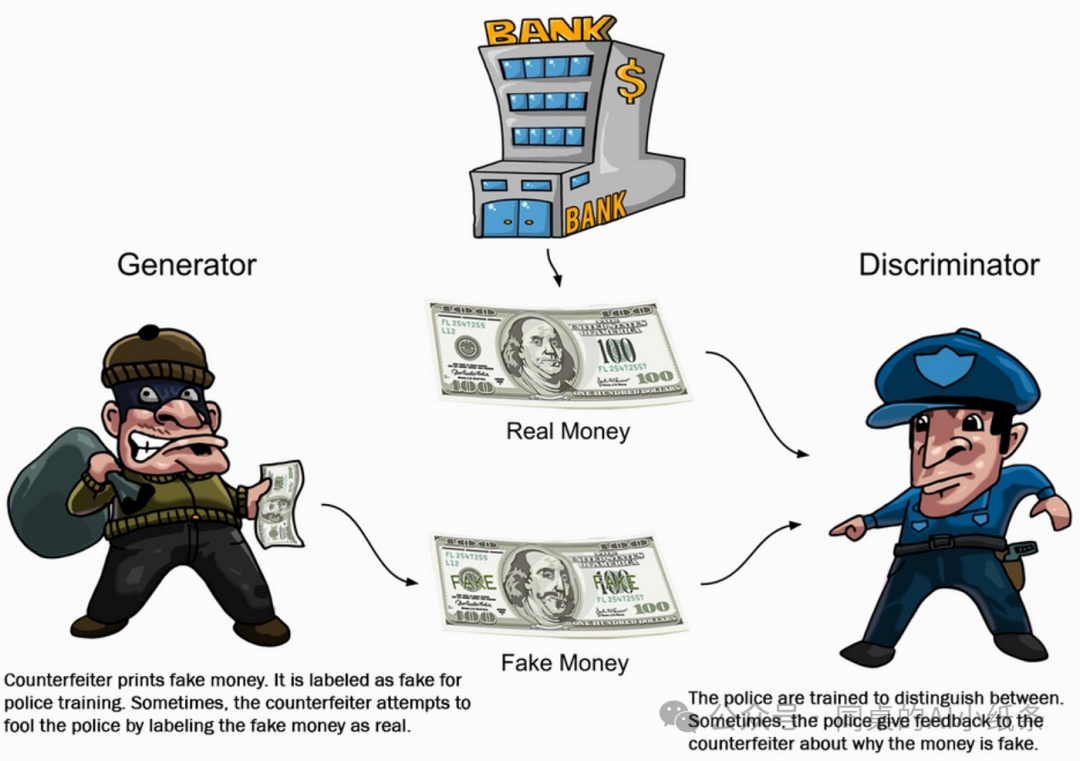

生成对抗网络(Generative Adversarial Networks, GANs)vs. 判别对抗网络(Discriminative Adversarial Networks):

生成对抗网络由生成器和判别器组成,用于生成新的数据实例。

判别对抗网络通常指的是GAN中的判别器部分,用于区分真实数据和生成数据。