一句看起来很正常的客服回复,最后让一家航空公司赔了钱。

这是真实在Air Canada发生过的事。

用户去问丧亲优惠机票怎么申请,聊天机器人给了一个听起来很不错的答案:

“先买全价票,之后 90 天内再补申请退款。”

用户照做了。

但航空公司拒绝退款。

最后,法院判Air Canada 赔偿。

这件事真正值得反复看的,不是“AI 又说错话了”,

而是:它是代表公司说错的。

所以在养龙虾的热潮中,我越来越确定一句话:

能力决定上限,边界决定能不能上生产。

很多 AI 项目不是死在“做不出来”,而是死在“做错了没人兜底”。

业务真正怕的,通常不是它不够聪明,而是这三件事:

-

会不会一本正经胡说 -

会不会越过本不该越过的边界 -

出了问题以后,责任到底算谁的

Air Canada 这个案例,把这件事说得很透。

真正的问题,不是它会不会回答,而是它回答错了之后谁负责

很多团队一聊 AI,先聊的是模型、速度、自动化比例。

但真到了业务里,最先卡住的往往不是这些。

真正卡住落地的,是:

-

哪些话它能说 -

哪些动作它不能自己做 -

哪些节点必须停下来等人确认 -

一旦出错,能不能回滚,能不能追责

这其实不是“能力问题”,而是“边界问题”。

为什么我现在更在意边界工程

如果你把 AI 当工具,你会一直追问:

它还能多做什么?

如果你把 AI 当数字员工系统,你先定义的是:

-

它该做什么 -

它不能做什么 -

哪些高风险动作必须人工确认 -

哪一步才算正式交付

这是两种完全不同的落地方向。

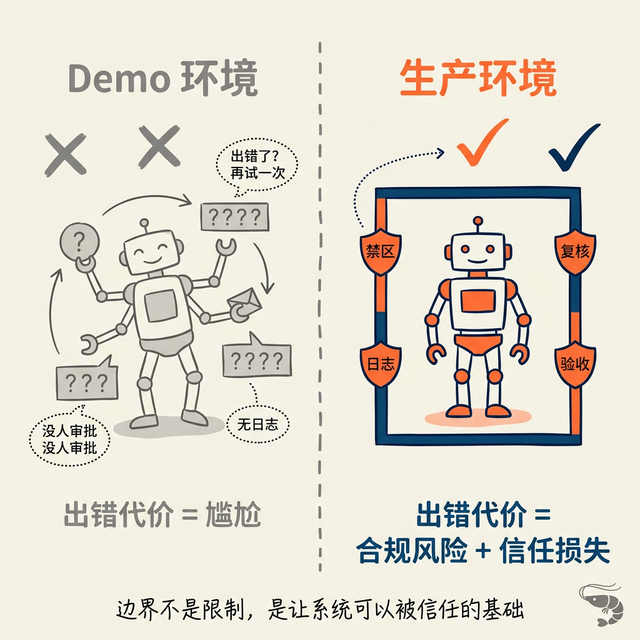

前者容易做出演示。

后者才更接近生产。

真正该先补的,不是更多能力,而是这四件事

-

禁区:外发、删改、付款这类动作,默认不能自动越过 -

复核:关键输出必须经过二次检查才能继续 -

日志:每一步都能回看、复盘、定位责任 -

验收:什么叫完成,要有明确标准,而不是“差不多就行”

很多项目缺的不是聪明,而是刹车。

最后一句

在问“哪个模型最强”前,先问一句更现实的话:

如果它今天说错一句话、做错一个动作,这套系统能不能稳稳兜住?

这个问题答不出来,再强也只是演示。

这个问题答得出来,AI 才真的开始接近生产力。

如果你身边也有人在做 Agent 落地,这篇也可以转给他看看。

很多时候,问题不是能力不够,而是边界、复核和责任链没先想清楚。