一、前言

随着大模型的广泛应用,作为人工智能三大支柱之一的AI算力,已经成为竞争的焦点。从模型训练到推理,算力存在于大模型生命周期的每一环,极大程度地影响着模型在实际业务场景的性能与效果。面对京东海量数据的各种场景,缺乏坚实的算力基础就犹如高楼大厦没有稳固的地基,上层的算法/数据无法发挥其作用。

而随着美国相继出台的高端AI芯片禁令,如何保障集团的算力安全成为一个我们无法回避的问题。2024年12月3日,中国半导体行业协会、中国汽车工业协会、中国互联网协会、中国通信企业协会集体发布声明,针对美国对华采取的出口限制表示坚决反对,认为美国相关芯片产品不再安全、不再可靠。四协会建议相关企业谨慎采购美国芯片,扩大与其他国家和地区芯片企业合作,积极使用内外资企业在华生产制造的芯片,呼吁中国政府支持可靠半导体产品供应商的稳定发展。

如何在京东业务场景让国产芯片可用、好用,是一个亟需解决的问题。然而,我们发现这并非易事,存在着以下挑战:

二、基于国产芯片的AI引擎技术

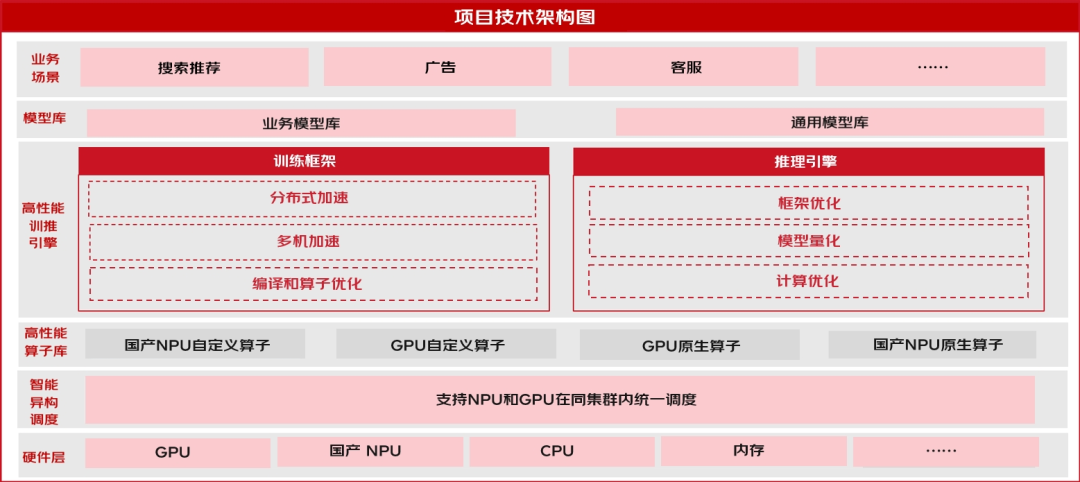

2.1 整体技术架构

2.2 GPU与NPU异构混合调度系统

-

NUMA感知和网络拓扑感知调度:识别CPU NUMA和网络拓扑,确保任务被分配到最优的计算和网络资源上,从而最大化任务的执行效率。 -

资源碎片最小化:采用了多种调度策略,如Gang、BinPack和节点资源预留,来减少资源的碎片化,提高集群的整体占用率。 -

可配置的优先级驱逐机制:该机制为用户提供了配额保障和抢占能力,确保重要任务能够及时执行。同时,它也支持根据任务的优先级队列来维护业务之间的公平性,提供更好的用户体验。

2.3 高性能训练引擎

| 模型 | 规模 | 离线训练 | 高效离线推理 | ||

| GPU | 国产NPU | GPU | 国产NPU | ||

| SR1.5 搜推电商领域大模型 | 3B/7B/15B | ✅ | ✅ | ✅ | ✅ |

| Qwen2.5 | 0.5B/1.5B/3B/7B/14B | ✅ | ✅ | ✅ | ✅ |

| Qwen2.5 | 34B/72B | ✅ | ✅ | ✅ | ✅ |

| ChatGLM2 | 6B | ✅ | ✅ | ✅ | ✅ |

| ChatGLM3 | 6B | ✅ | ✅ | ✅ | ✅ |

| GLM4 | 9B | ✅ | ✅ | ✅ | ✅ |

| Qwen | 1.8B/7B/14B | ✅ | ✅ | ✅ | ✅ |

| Qwen-1.5 | 0.5B/1.8B/4B/7B/14B | ✅ | ✅ | ✅ | ✅ |

| Qwen-1.5 | 32B/72B/110B | ✅ | ✅ | ✅ | ✅ |

| Qwen-2 | 0.5B/1.5B/7B | ✅ | ✅ | ✅ | ✅ |

| Qwen-2 | 72B | ✅ | ✅ | ✅ | ✅ |

| LLama2 | 7B/13B | ✅ | ✅ | ✅ | ✅ |

| LLama3 | 8B | ✅ | ✅ | ✅ | ✅ |

| LLama3 | 70B | ✅ | ✅ | ✅ | ✅ |

| LLama3.1 | 8B | ✅ | ✅ | ✅ | ✅ |

| LLama3.1 | 70B | ✅ | ✅ | ✅ | ✅ |

| YI | 6B/34B | ✅ | ✅ | ✅ | ✅ |

| YI-1.5 | 6B/9B | ✅ | ✅ | ✅ | ✅ |

| YI-1.5 | 34B | ✅ | ✅ | ✅ | ✅ |

| Baichuan2 | 7B/13B | ✅ | ✅ | ✅ | ✅ |

| Bloom-z | 7B | ✅ | ✅ | ✅ | ✅ |

| Gemma | 2B/7B | ✅ | ✅ | ✅ | ✅ |

2.4 高性能推理引擎

-

模型优化:计算方面通过GE图编译优化和ATB高性能算子技术对Paged Attention、Flash Attention、Sub_Mul_Concat等操作进行深度优化,实现整图下发能力,通过算子setup(workspace、tiling)、下发、计算实现流水线并行,有效隐藏了算子调度开销。同时支持W8A8 SmoothQuant量化、W4A16 AWQ量化技术,显著较少了计算量与访存密度。 -

框架优化:调度方面实现了Prefill/Decode分离技术,在部分场景下有效提高推理速度,通过KV cache、Prefix cache等缓存技术减少重复计算。

| 类别 | 当前支持模型 |

| LLM | Baichuan2-7B |

| Baichuan2-13B | |

| ChatGLM2-6B | |

| ChatGLM2-13B | |

| ChatGLM3-6B | |

| Qwen-1.8B | |

| Qwen-7B | |

| Qwen-14B | |

| Qwen-72B | |

| Qwen-VL | |

| Qwen1.5-1.8B | |

| Qwen1.5-7B | |

| Qwen1.5-14B | |

| Qwen1.5-72B | |

| Qwen2-7B | |

| Qwen2-72B | |

| Llama2-7B | |

| Llama2-13B | |

| Llama2-70B | |

| Llama3-8B | |

| BLOOM-7B | |

| Gemma-7B | |

| internlm | |

| 多模态 | SD1.5 |

| SDXL | |

| Mistral-7B |

三、落地场景

#Input_1青海省西宁市城北区三其村。可以发圆通吗 谢谢。#Output-NPU(国产NPU)青海省_1,西宁市_3A,城北区_3A,三其村_4B, _5A-1,可以发圆通吗 谢谢_UNK,#Output-GPU(GPU)青海省_1,西宁市_3A,城北区_3A,三其村_4B, _5A-1,可以发圆通吗 谢谢 _UNK•案例三、商家侧智能助手 基于大模型的客服Agent已成为电商领域的新趋势。其中,在商家侧智能助手的案例中,业务侧期望使用过往沉淀QA数据,基于Qwen1.5 7B进行微调,实现模型针对商家问题进行分析,并将任务分配给下游工具处理。 由于Qwen1.5系列开源模型暂未提供针对NPU的微调方案,该案例利用九数算法中台提供统一训练框架,基于框架底座开源模型进行微调。 通过测试对比,国产NPU微调的模型与基于GPU微调的模型分析结果相似,且96%问题分配下游工具相同。对比模型分配的工具(pred_tool)和人工标注的工具(tool_gt)并综合打分,二者得分相近。 #Input_1上架宝贝数怎么看?#Output-国产NPU{...'tool_name':' business_expert, 'query':'如何查看已上架的商品数量?'...}#Output-GPU{...'tool_name':' business_expert, 'query':'如何查看已上架的商品数量?'...}#Input_2为啥我不能提报活动了?#Output-国产NPU{...'tool_name':' business_expert, 'query':'为什么商家不能提报活动,以及如何解决提报问题?'...}#Output-GPU{...'tool_name':' business_expert, 'query':'商家无法提报活动的可能原因及解决方案是什么?'...}四、应用价值

目前,京东零售基于国产芯片的AI引擎技术已在十余个业务场景落地,为加速国产芯片破局、打造开放生态探寻新思路。 •核心技术自主且可控:通过使用国产算力芯片,有效降低了对海外芯片的依赖,确保了算法与算力方面的安全性。这一自主可控的技术体系涵盖底层硬件至上层应用,使京东零售在快速变化的国际环境中保持稳健和高效的运转。 •国产芯片应用性提升:国内电商领域业务的复杂性和多样性为国产算力的应用提供了广泛的实践机遇。当前的引擎能力已应用于搜索推荐、广告创意生成、智能客服和数据自动分析等多个场景。通过这些实践,不仅显著提升实际业务效能,也为国产算力在真实商业环境中的应用提供了宝贵的经验反馈,从而反哺国产算力技术生态发展、成熟、普惠。 五、行业影响力

在实现了基于国产算力的一系列技术突破后,我们将沉淀的技术经验进一步转化为在集团内外的影响力,彰显京东零售的技术领先性和行业责任感: •2024年,京东零售开始作为理事单位,与华为昇腾共建Openmind开源社区; •7月,在上海举办的昇腾人工智能产业高峰论坛上,京东作为华为昇腾邀请11家生态伙伴及客户中的一员,联合华为发布了基于昇腾大模型推理解决方案的五大场景优秀实践。 •7月,基于国产芯片的AI引擎技术项目荣获京东零售平台产品与研发中心618大促技术敢打奖。 •9月,在第九届华为全联接大会(HUAWEI CONNECT 2024)上,项目主力成员获得优秀昇腾原生开发者的奖项

24年7月,昇腾大模型推理解决方案正式发布暨五大场景优秀实践,图源昇腾官网新闻资讯:https://www.hiascend.com/activities/dynamic-news/451 六、未来规划

•万卡集群建设 随着业界主流模型体量不断扩大,百B甚至千B级模型的训推诉求愈发迫切。为了满足京东零售在大规模计算场景的诉求,集群将在25年实现万卡级别高性能网络及调度能力,助力大体量模型业务发展。同时,九数算法中台将持续扩充集群支持的芯片类型,允许GPU、国产NPU在集群内被混合调度。通过这样的集群生态建设,一方面能够让京东算法业务不依赖于单家厂商,保障了集团的算力安全和可持续发展;另一方面,也让算法业务在算力调度上有更加多元的选择。 除了进行集群的升级,九数算法中台还将进一步优化国产芯片的调度策略,通过应急资源池、资源智能预测、动态扩缩容等手段保障各业务都能够合理、高效地用上国产芯片,全面挖掘国产芯片算力性能。 •国产算力生态建设 京东零售将在2025年持续深入与国产头部芯片厂商的合作,共同助力京东零售AI数智化,作为华为昇腾AI解决方案竞争力和软件生态核心贡献者。 针对自研训练引擎在LLM场景的支持,九数算法中台将深入HCCL底层通信优化,建立融合算子库全面优化性能,达到百卡/千卡MFU可至60%。针对CTR训练场景,九数算法中台将建设业界首个同时支撑昇腾 NPU和GPU的性能领先的CTR大规模训练框架,并考虑建立开源生态,支持业务无感迁移,落地在主站推荐精排、主站搜索精排场景。 针对自研推理引擎在LLM场景的支持,九数算法中台将通过共建昇腾加速ATB算子库,扩展LLM前后处理能力及LVM等模型,性能能够达到业界SOTA;针对CTR推理场景,建设9N-Predictor NPU推理引擎,支持GPU/NPU异构推理,并通过共建GE自动融合优化引擎编译能力,最大程度发挥NPU在推荐场景的极致性能。 扫一扫,加入技术交流群