-

论文链接:https://arxiv.org/abs/2406.04151 -

AgentGym代码仓库:https://github.com/WooooDyy/AgentGym

-

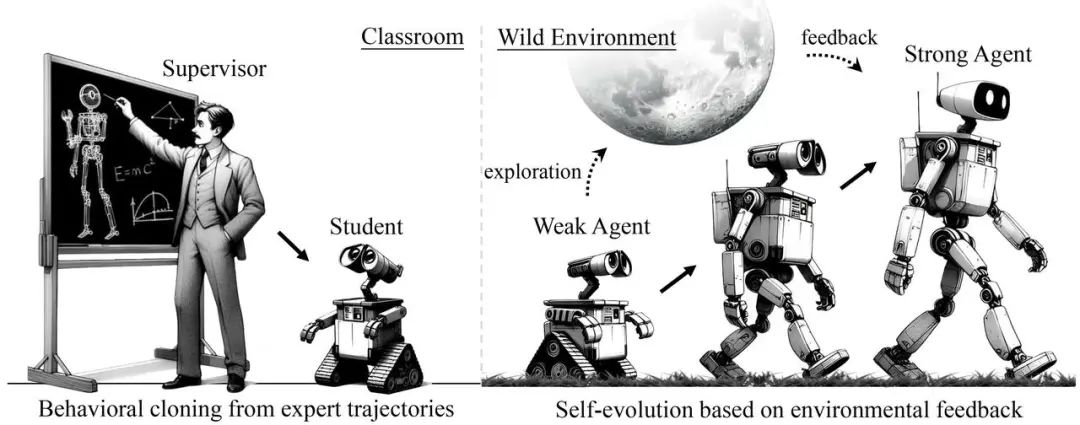

依赖于人类监督的行为克隆(Behavior Cloning)方法,需要智能体逐步模仿专家提供的轨迹数据。这种方法虽然有效,但由于标注资源的限制,难以扩展。对环境的探索也较为有限,容易遇到性能或泛化性的瓶颈。 -

允许智能体根据环境反馈,不断提高能力的自我改进(Self Improving)方法,减少了对人类监督的依赖,同时丰富对环境的探索深度。然而,它们通常在特定任务的孤立环境中进行训练,得到一批无法有效泛化的专家智能体。

-

多样化的环境和任务,允许智能体动态且全面地进行交互、训练,而不是被局限于某个孤立的环境。 -

一个适当大小的轨迹数据集,帮助智能体配备基本的指令遵循能力和基础任务知识。 -

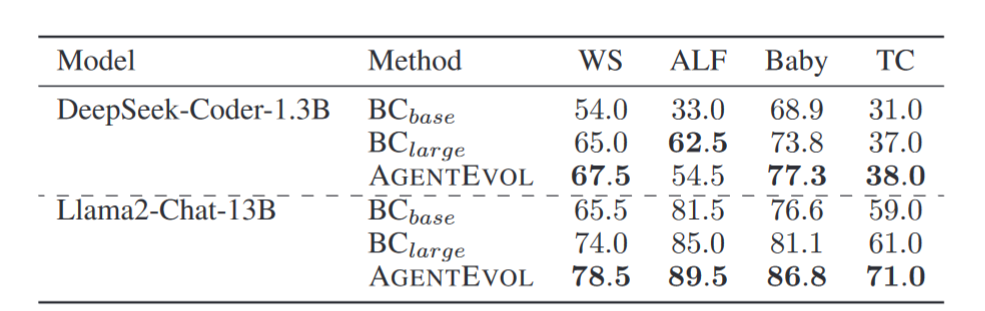

一种有效且可扩展的进化算法,激发智能体在不同难度环境中的泛化能力。

-

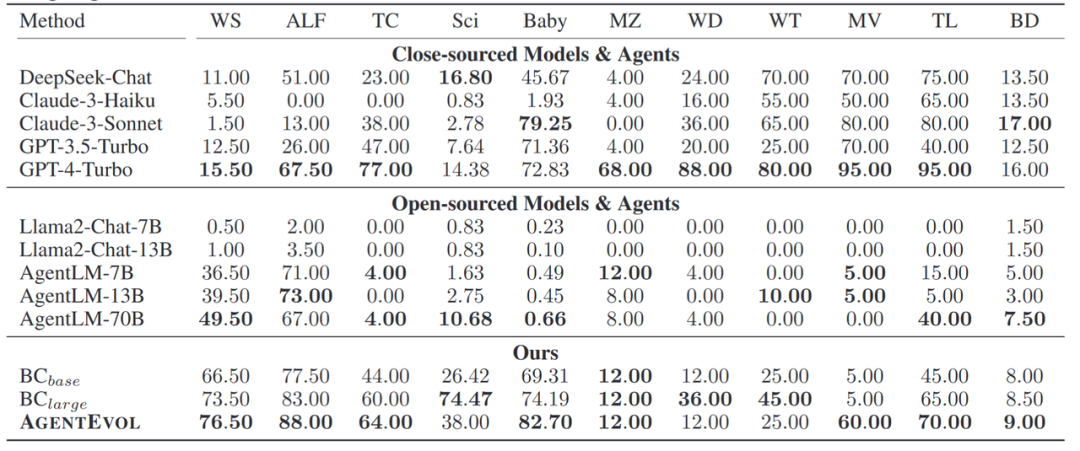

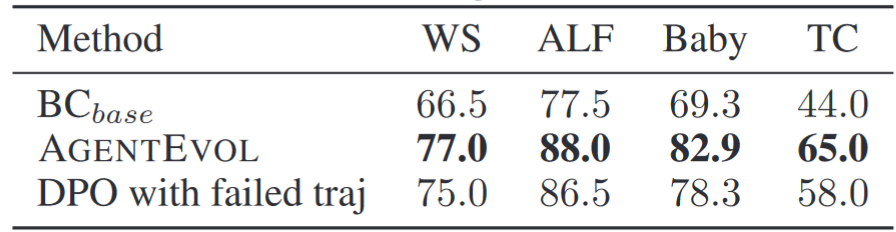

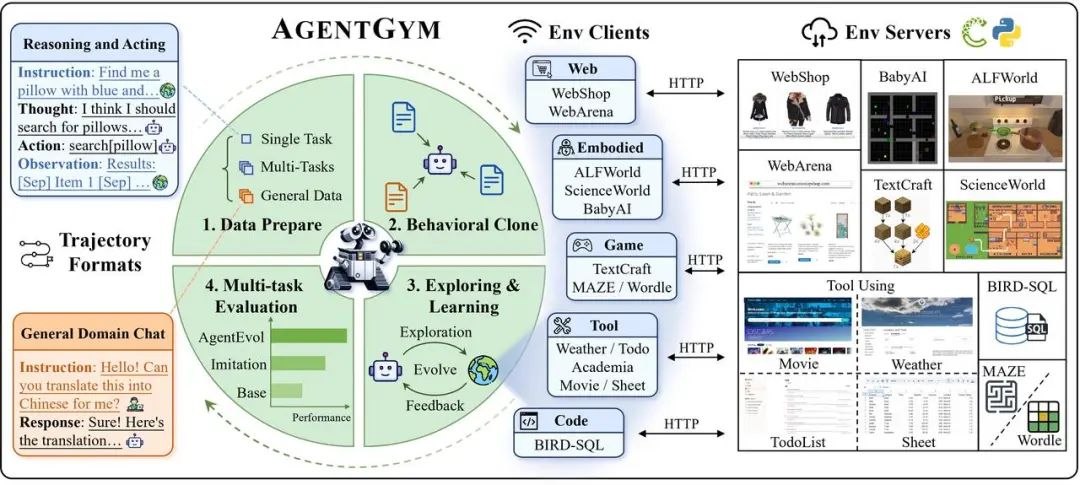

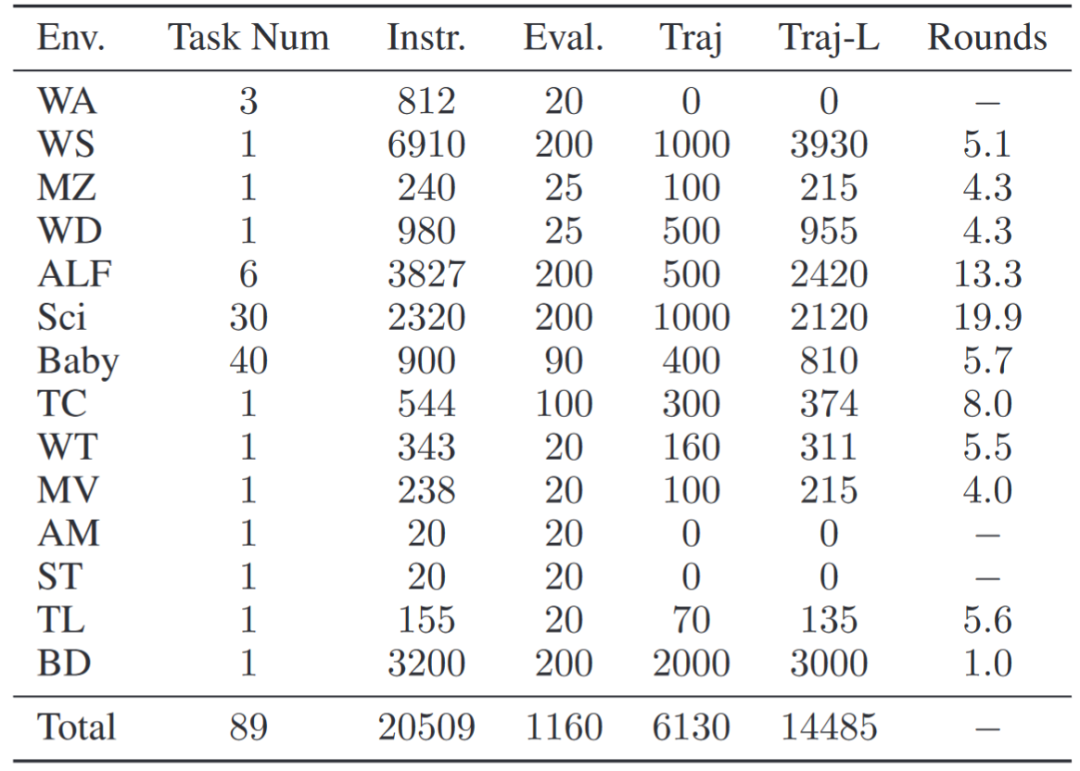

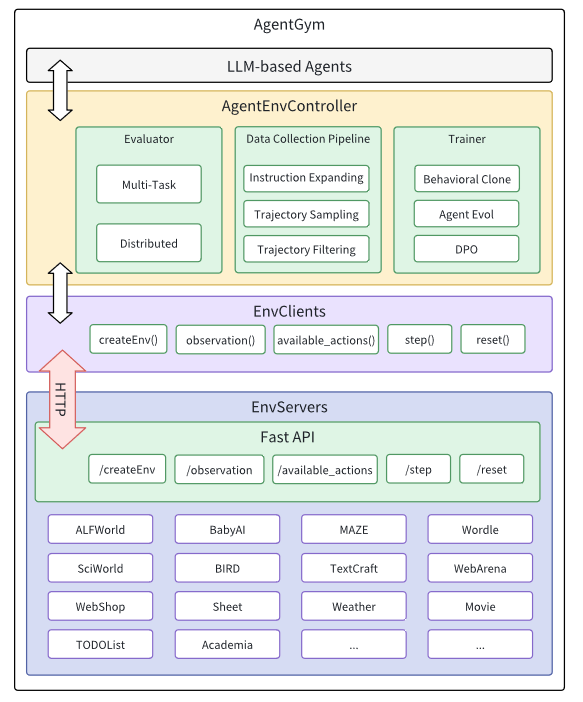

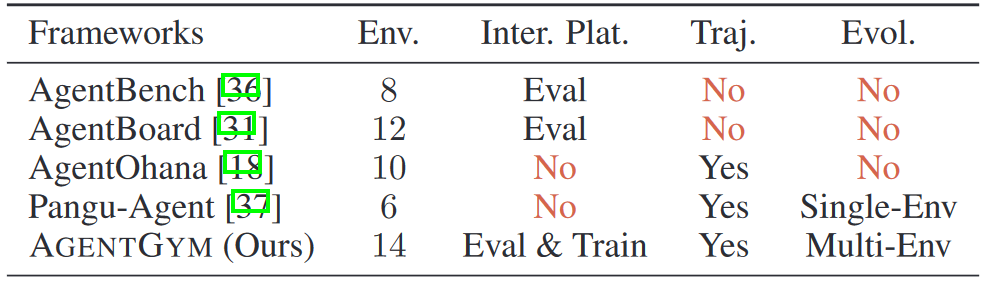

「AgentGym」,一个包含 14 种具体环境,89 种具体任务类型的交互平台(图2),为大语言模型智能体训练提供支持。该平台基于 HTTP 服务,为不同环境提供了一个统一的 API 接口,支持轨迹采样、多轮交互、在线评估和实时反馈。 -

「AgentEval」,一个具有挑战性的智能体测试基准。「AgentTraj」和「AgentTraj-L」,通过指令增强和众包 / SOTA 模型标注构建的专家轨迹数据集。经过格式统一和数据过滤,帮助智能体学习基本的复杂任务解决能力。 -

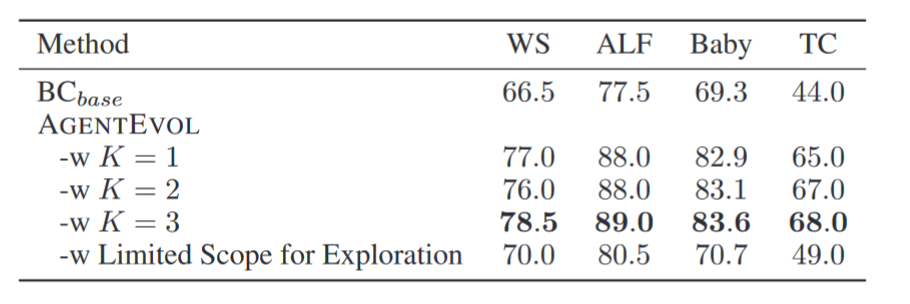

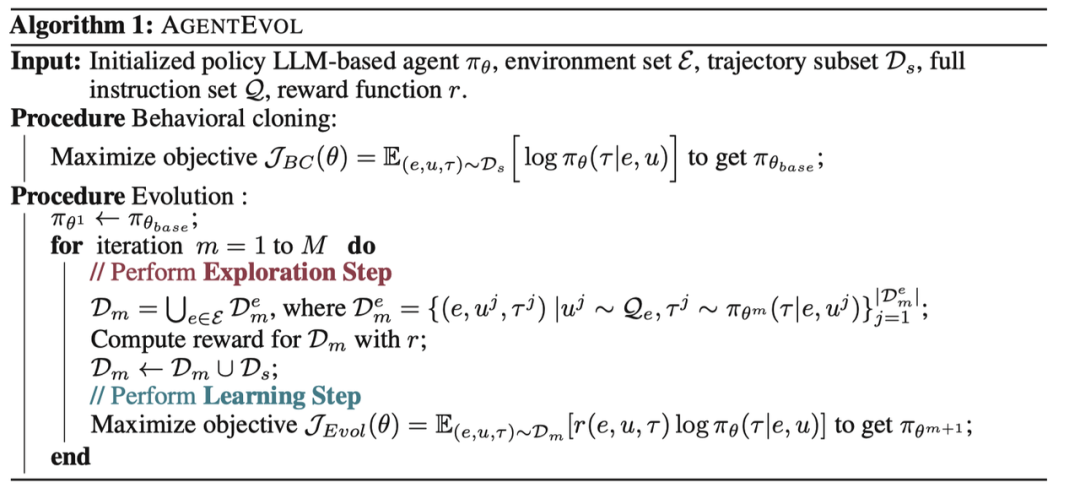

「AgentEvol」,一种激发智能体跨环境自我进化的全新算法。该算法的动机在于,期望智能体在面对先前未见的任务和指令时进行自主探索,从新的经验中进行学习与优化。

-

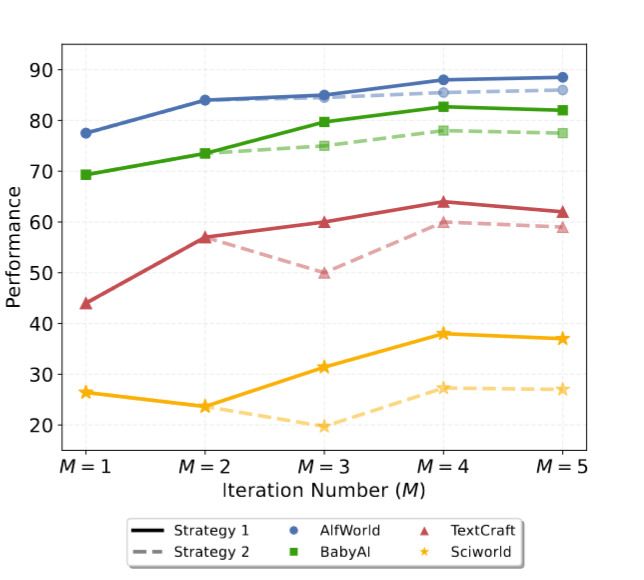

「探索步骤(Exploration Step)」:在这一步骤中,智能体在当前策略下与环境进行交互,生成新的轨迹并评估其奖励,形成一个估计的最优策略分布。具体而言,智能体与多个环境进行交互,生成一系列的行为轨迹。每条轨迹都是智能体根据当前策略与环境互动的产物,包括智能体的思考,智能体的行为,以及环境的观测。然后,环境端会根据轨迹与任务目标的匹配程度,为每条轨迹给出奖励信号。 -

「学习步骤(Learning Step)」:在这一步骤中,智能体根据估计的最优策略分布更新参数,使其更加接近于最优策略。具体而言,智能体利用在探索步骤中收集到的轨迹与奖励数据,通过一个基于轨迹奖励加权的优化目标函数来优化自己。注意,在学习步骤中,为了减少过拟合,作者优化的总是「基础通用智能体」,而不是上一轮优化得到的智能体。

展示了良好的基础交互能力。进一步,通过在更大的AgentTraj-L 数据集上实施行为克隆,智能体

展示了良好的基础交互能力。进一步,通过在更大的AgentTraj-L 数据集上实施行为克隆,智能体  实现了显著的性能提升。

实现了显著的性能提升。 和其他 SOTA 模型。

和其他 SOTA 模型。