Coze Studio是一站式 AI Agent 开发工具。提供各类最新大模型和工具、多种开发模式和框架,从开发到部署,为你提供最便捷的 AI Agent 开发环境。

-

提供 AI Agent 开发所需的全部核心技术:Prompt、RAG、Plugin、Workflow,使得开发者可以聚焦创造 AI 核心价值。 -

开箱即用,用最低的成本开发最专业的 AI Agent:Coze Studio 为开发者提供了健全的应用模板和编排框架,你可以基于它们快速构建各种 AI Agent ,将创意变为现实。

❝

引自:https://github.com/coze-dev/coze-studio/blob/main/README.zh_CN.md

项目部署

克隆代码

git clone https://github.com/coze-dev/coze-studio.git

配置大模型

cd coze-studio

ll backend/conf/model/template/

不同的大模型有不同的文件,我使用DeepSeek大模型,所以,复制一下model_template_deepseek.yaml文件

cp backend/conf/model/template/model_template_deepseek.yaml backend/conf/model/deepseek.yaml

❝

填写api_key、model即可。

启动项目

# Start the service

cd docker

cp .env.example .env

docker compose up -d

登录

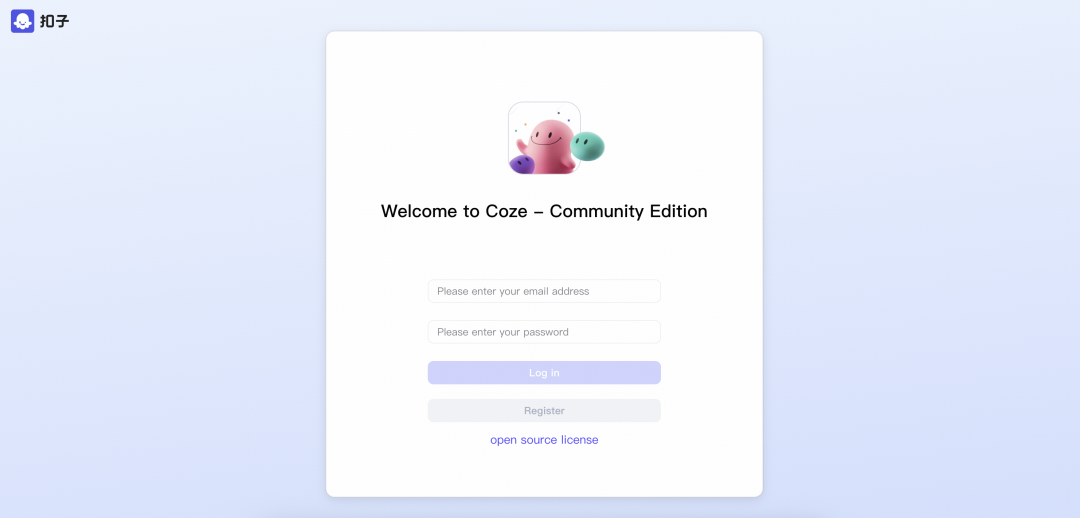

启动项目后,访问http://localhost:8888/,打开Coze Studio:

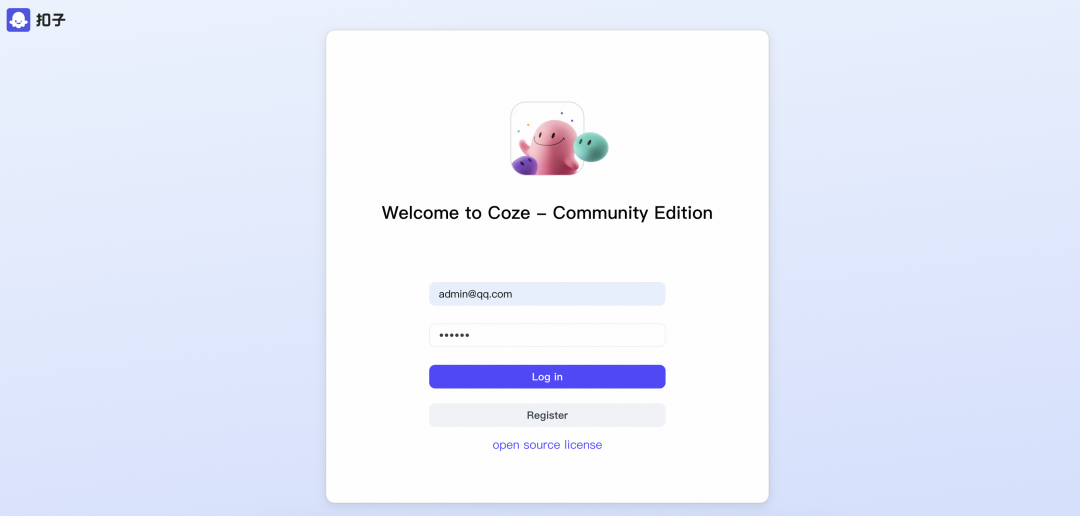

首次登录,填写一个用户和密码,点击注册:

首次登录,填写一个用户和密码,点击注册:

语言选择

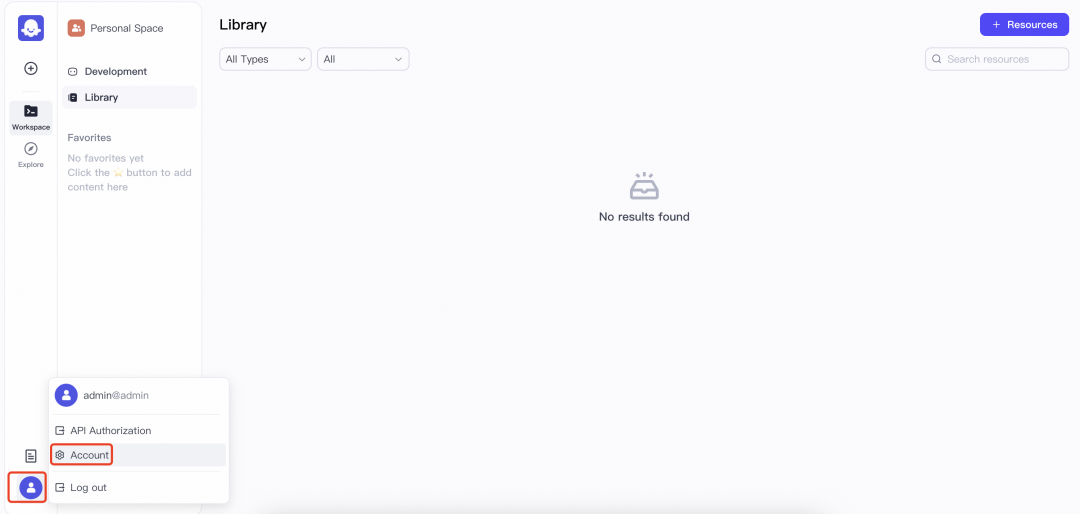

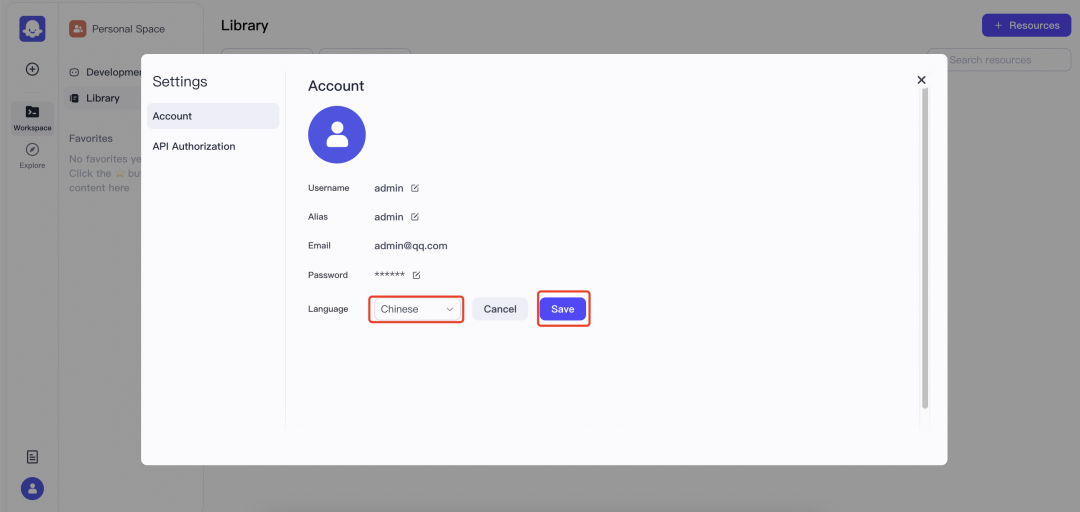

登录后,点击左下角用户图标—>“Account”: 将显示语言修改为中文:

将显示语言修改为中文:

知识库

嵌入模型

我使用的是豆包潜入模型,配置如下:

cd docker

vim .env

# ark embedding by volcengine / byteplus

export ARK_EMBEDDING_MODEL="doubao-embedding-text-240715" # (string, required) Ark embedding model

export ARK_EMBEDDING_API_KEY="da5b5229-4cef-44a5-935a-xxxxxxx" # (string, required) Ark embedding api_key

export ARK_EMBEDDING_DIMS="2048" # (int, required) Ark embedding dimensions

export ARK_EMBEDDING_BASE_URL="https://ark.cn-beijing.volces.com/api/v3/" # (string, required) Ark embedding base_url

export ARK_EMBEDDING_API_TYPE="" # (string, optional) Ark embedding api type, should be "text_api" / "multi_modal_api". Default "text_api".

❝

尝试用Ollama运行的嵌入模型,但总报错,放弃了。

配置好嵌入模型后,最好将全部容器重新删除后,重新运行一下,否则,可能存在嵌入模型无法使用的问题。

创建知识库

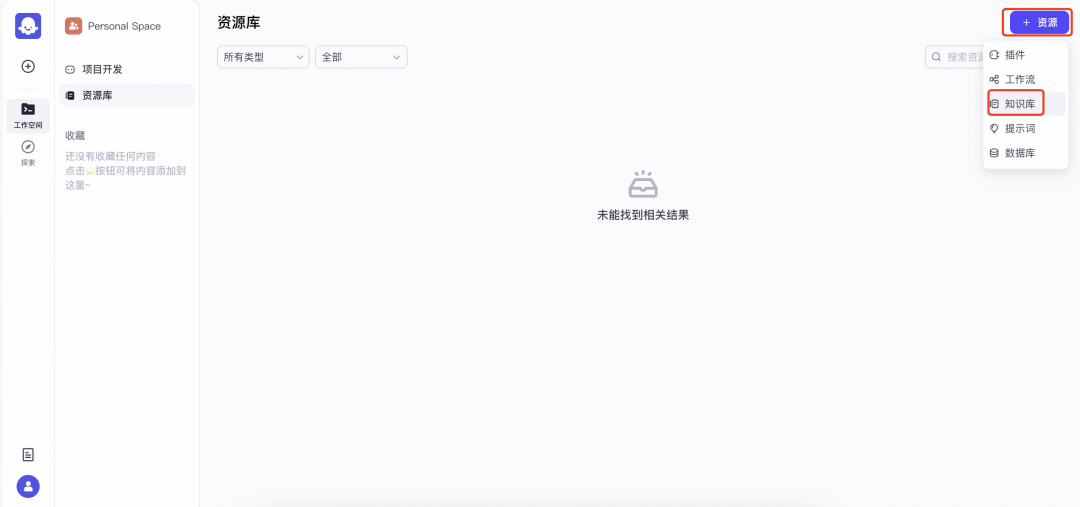

点击“资源库”—>“资源”—>“知识库”: 选择知识库类型,给知识库命名:

选择知识库类型,给知识库命名: 导入需要的文档

导入需要的文档 如果是纯文本,选择“快速解析”,速度会快一点:

如果是纯文本,选择“快速解析”,速度会快一点: 分片预览后点击“下一步”:

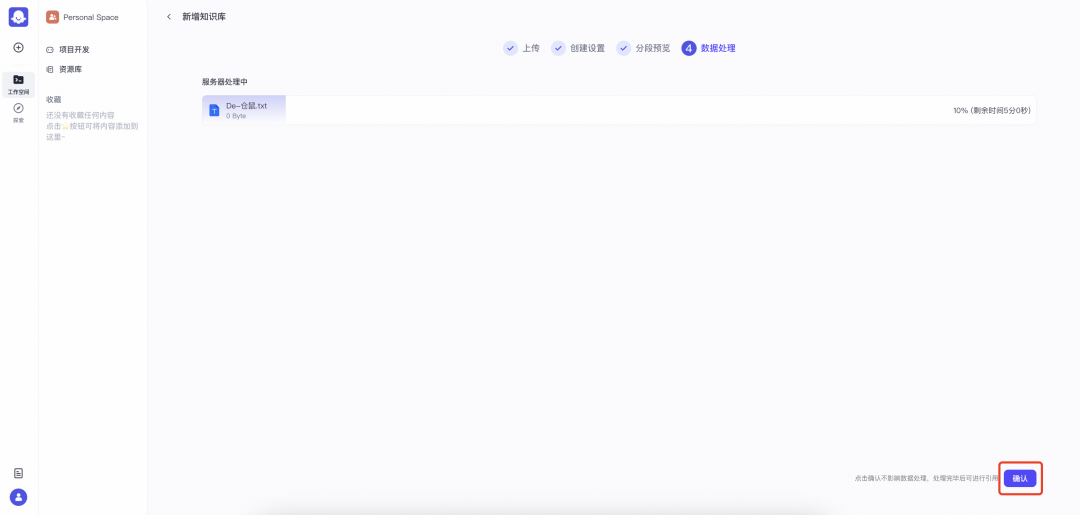

分片预览后点击“下一步”: 等待向量化处理:

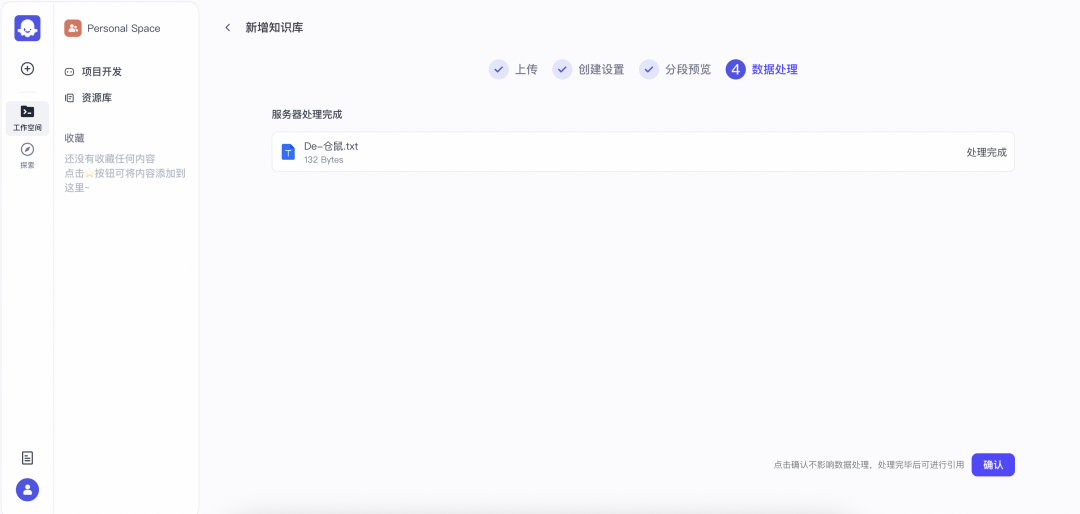

等待向量化处理: 处理完毕,点击“确认”:

处理完毕,点击“确认”:

使用知识库

创建智能体

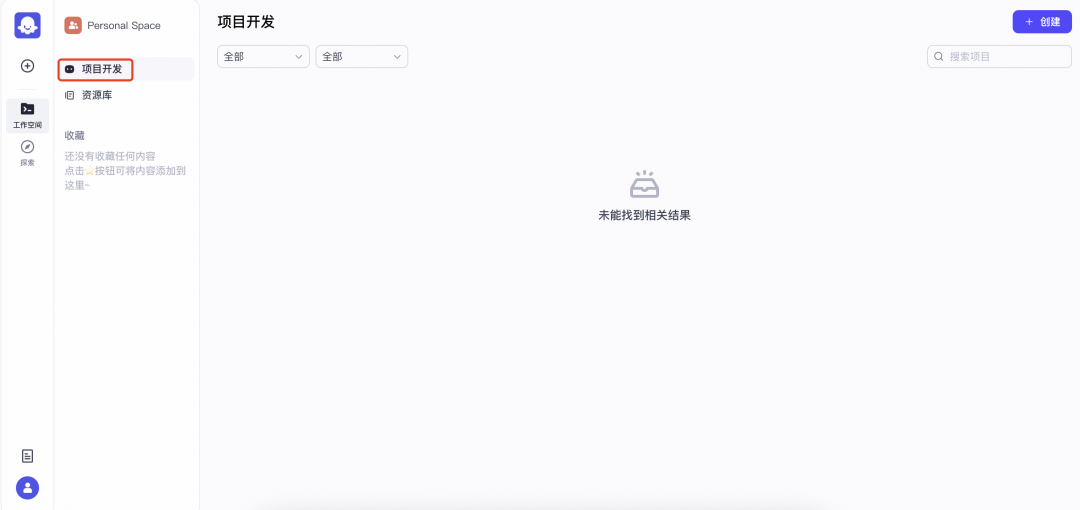

知识库创建完毕后,点击“项目开发”: 创建智能体:

创建智能体: 给智能体命名后点击“确认”:

给智能体命名后点击“确认”:

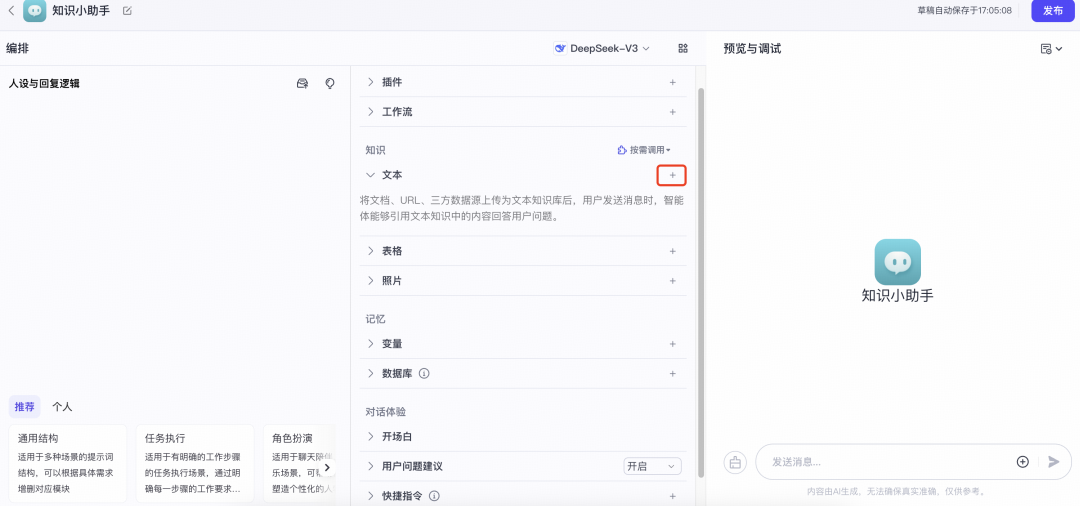

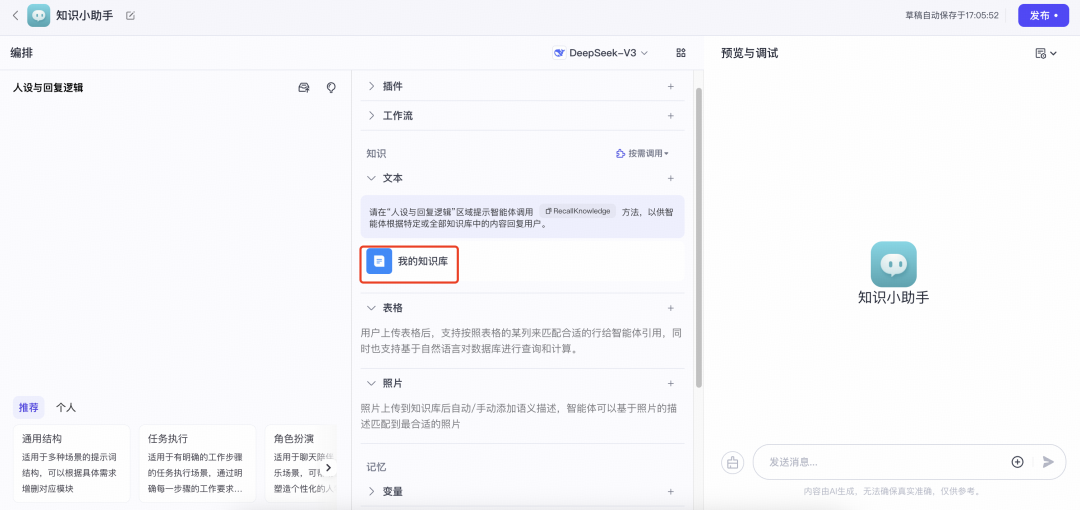

挂载知识库

点击“知识”—>“文本”边上的“+”,将知识库挂载到智能体: 知识库已经挂载完成:

知识库已经挂载完成:

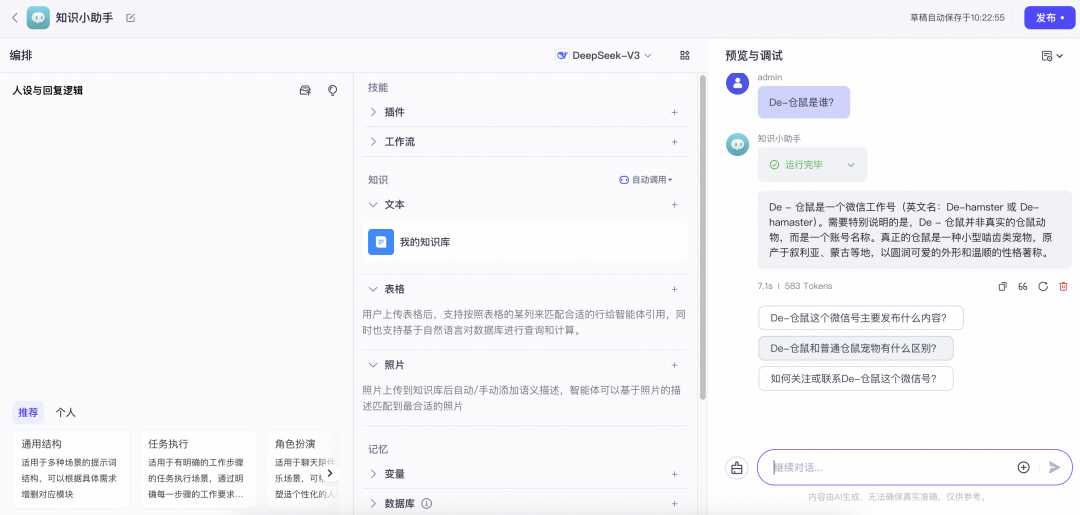

召回测试

测试前,将知识库的调用方式设置为“自动调用”: 测试回答效果:

测试回答效果:

感受

总体感觉还是不错,但是,某些地方还是待优化,比如:大模型配置应该在界面上进行,采用文件配置繁琐、易错。